近年来,人工智能技术特别是自然语言处理领域的发展日新月异,其中以GPT-2等大型预训练语言模型最为引人注目。传统的GPT-2模型由于体积庞大、计算复杂,通常依赖强大的服务器端计算资源,难以直接在客户端设备上运行。然而,一项突破性的技术创新——利用WebGL2图形着色器在浏览器中实现GPT-2模型的推理,正在逐渐改变这一局面。该技术不仅使得用户无须依赖服务器即可体验强大的语言生成能力,还为AI普及和前端应用带来了全新的可能性。首先,理解为何要在浏览器中实现GPT-2是关键。传统的AI模型多部署于后端服务器,用户通过API调用完成任务,存在网络延迟、隐私泄露以及高昂服务器成本等问题。

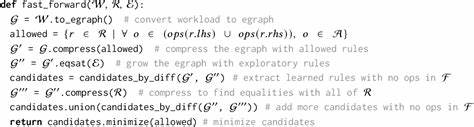

而将GPT-2模型部署到用户端浏览器中,可以实现离线运行,增强数据隐私保护,同时降低运营成本。考虑到浏览器环境的计算资源有限,开发者利用浏览器支持的WebGL2技术,将GPT-2推理的核心计算任务通过GPU加速并行处理。这一做法突破了CPU计算瓶颈,提高了模型推理的性能表现。WebGL是浏览器中专为图形渲染设计的API,WebGL2更进一步扩展了其功能,支持更多高级渲染特性及较大规模并行计算。通过将GPT-2的矩阵乘法、注意力机制等计算步骤转化为着色器程序,在GPU端高效执行任务,显著提升了模型速度。开发团队使用TypeScript和JavaScript开发前端框架,结合js-tiktoken实现文字的BPE分词(字节对编码)直接在浏览器中完成,进一步简化流程、提升响应体验。

在模型权重获取方面,团队设计了Python脚本通过HuggingFace的transformers库自动下载官方GPT-2预训练权重文件,并将其转化为适合WebGL加载的Float32Array格式。这种预处理确保了权重数据能被浏览器端快速读取和使用。为了实现完整的小型GPT-2(117M参数)前向推理,开发者将所有核心模块包括嵌入层、位置编码、变换层和输出层均用WebGL着色器实现。整个网络结构通过高度模块化设计,既方便维护,也促进后续功能扩展及模型升级。基于此架构,用户只需运行浏览器访问指定页面,就能现场体验GPT-2文本生成。Vite构建工具被用来进行项目打包和模块服务,支持ES模块和热模块替换,极大提升了前端开发效率。

实际体验显示,GPU加速使推断速度足以满足交互式应用需求,普通笔记本电脑即能流畅运行,无需依赖云端服务器。除了性能优势,该项目还十分注重代码开源和文档完善,MIT许可证授权使开发者可自由使用和二次开发。详细的README文件说明了安装、环境配置、权重下载及运行步骤,为新手入门提供全面支持。该技术的最大亮点在于创新性地将深度学习模型与Web图形渲染技术相结合,开启了AI模型无需服务器即可在广泛设备上运行的先河。未来,这种方式有望扩展至更大规模模型和多语种自然语言理解,为普及智能应用提供技术保障。尽管现阶段仍存在浏览器资源受限、模型精度与推理速度需权衡等挑战,但持续的优化和硬件升级将有效缓解这些问题。

研发人员不断推进对Transformer结构的优化,包括量化技术、剪枝算法以及更高效的注意力机制,以便在有限的GPU资源中提高模型表现。总体而言,GPT-2通过图形着色器实现的技术创新,不仅展示了前端AI推理的巨大潜力,还推动了AI无障碍化的进程。随着更多开发者和研究者关注和投入,这项技术必将在未来人工智能应用中发挥关键作用,催生更多创意应用场景,如离线智能助手、隐私保护文本生成工具以及跨平台自然语言交互界面等。展望未来,WebGL2及其继任技术的不断发展有望承载更复杂的AI工作负载,配合WebAssembly等技术,前端AI生态将更为丰富和多元,推动人机交互进入一个全新时代。