近年来,人工智能的飞速发展推动了许多前沿技术的革新,其中元启发式算法(Metaheuristics)与大型语言模型(Large Language Models,LLMs)的结合成为了学术界和工业界关注的热点。元启发式算法因其高效处理复杂组合优化问题的能力,在优化研究领域占据重要地位,而大型语言模型则凭借其强大的模式识别和数据理解能力,在自然语言处理及诸多智能辅助应用中大放异彩。将这两者结合起来,构筑一种具有协同效应的智能优化框架,为解决传统算法难以应对的复杂问题带来了新的契机。元启发式算法是一类基于启发式的近似算法,能够在庞大且复杂的搜索空间中迅速寻找可接受的优质解。它们广泛应用于物流调度、网络设计、图论问题及社会网络影响力最大化等领域。虽然元启发式算法普遍具备较强的适应性和效率,然而这类方法往往严重依赖问题领域的先验知识和经验启发,难以实现自动化的自适应优化。

同时,元启发式算法自身的随机性和局部陷入问题也制约了其性能的进一步提升。大型语言模型作为基于深度学习的生成式模型,最初应用于自然语言处理,凭借大规模参数和训练数据展现出令人瞩目的理解与推理能力。它们不仅能生成符合语法和语义的流畅文本,还能在模式识别、推理判断甚至代码生成等多种复杂任务中发挥重要作用。LLMs的这种强大智能特性为优化算法引入了新的辅助视角,即利用语言模型揭示潜在的结构性信息和隐藏模式。将LLMs引入元启发式算法的核心思路在于将大型语言模型视为强大的模式识别引擎,针对问题实例中的多维度特征提供深度解析和启发。通过精心设计的提示(prompt),LLMs能够分析问题图结构的节点信息,例如入度、出度、节点重要性指标等,并推导出各节点在最优解中出现的概率分布。

这种概率既是对节点重要性的量化判断,也成为引导元启发式算法搜索方向的关键参数。具体地,在社交网络中,“多跳影响力最大化”问题常被用作测试元启发式算法效能的典型实例。该问题涉及在一个有向图中选取有限节点,使得以这些节点为起点传播的影响覆盖尽可能多的目标节点。该问题属NP难问题,传统算法难以高效求解。通过利用LLMs分析节点的多种网络指标,计算综合权重与校正参数,可以准确地估计每个节点的价值,从而引导基于随机键遗传算法(BRKGA)等元启发式搜索策略专注于潜力更大的候选解。实验结果表明,结合LLMs策略的BRKGA,相较于纯粹的基于出度的启发式评分或深度学习辅助的GNN模型,在不同规模和复杂度的社交网络实例中均能显著提升求解质量和稳定性。

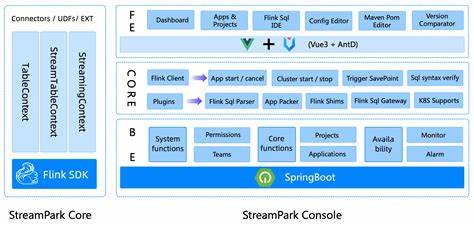

促使更多选择优化路径,使算法更具鲁棒性和泛化能力。此融合方法背后的关键技术之一就是提示工程。通过构造合理的示例图与评价图,结合带有清晰规则的提示段,LLMs能有效捕捉问题内在的结构特征和指标关联模式。此外,为了便于研究者使用和验证,该方法开发了开源工具OptiPattern,实现从问题实例自动生成提示、调用LLMs、解析输出概率再整合元启发式算法的闭环流程,大幅简化了技术门槛和复制难度。尽管融合取得了显著进展,仍面临一些挑战和未来方向值得关注。由于大型语言模型资源消耗巨大,目前处理大规模网络实例存在令牌数量限制和成本瓶颈,需要进一步研究更高效的提示压缩和关键节点筛选策略。

同时,LLMs生成结果偶发的“幻觉”现象要求谨慎设计容错机制,确保优化计算的可靠性。此外,如何将模式识别与搜索过程深度结合,将多种机器学习与进化算法框架有机融合,构建统一的智能优化平台,亦为未来科研重点。总的来说,元启发式算法与大型语言模型的融合展现出变革组合优化领域的强大潜能。它突破了传统启发式方法自适应能力的瓶颈,将语言模型深层理解抽象信息的优势有效导入优化推理过程,赋予了元启发式算法全新的智能支撑。未来,借助不断迭代更新的LLMs及硬件加速技术,结合多学科交叉理论,该融合框架有望在复杂网络优化、智能产业规划、自动化设计等应用领域释放更大价值。对于相关科研人员和工业实践者而言,关注和探索这种跨领域结合的技术趋势,将为战胜现实世界中海量且复杂的决策难题提供有力武器。

以上内容系统梳理了元启发式算法与大型语言模型结合的方法论、实践成效及未来展望,为加速智能优化技术迈向新阶段提供了全面指南。随着理论与实践的不断深入,相关技术必将成为优化领域与人工智能交汇处的重要里程碑。