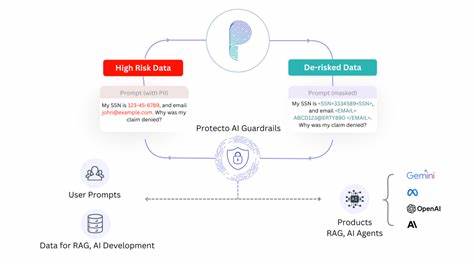

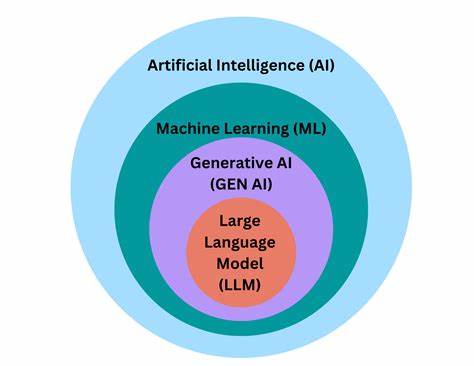

随着人工智能技术的迅猛发展及其应用领域的不断扩展,如何确保这些智能系统在复杂多变的现实环境中安全稳定地运行,已成为行业内外广泛关注的话题。人工智能系统由于自身设计的复杂性和不可预测性,易出现意料之外的行为,进而可能引发一系列安全和伦理风险。因此,构建可靠的设计框架以设立合理的安全防护措施,成为保障人工智能安全可控的关键手段。可靠设计理念主张在系统开发阶段,便将安全性、可控性与容错机制内置于系统架构之中,从源头上防止潜在风险的发生。对于不确定性高的智能系统而言,这种设计思路尤为重要。通过合理设置“护栏”,即设计各种约束和限制、建立多层安全监测机制,系统得以在出现异常时及时响应并采取纠正措施,从而避免危害扩大。

人工智能系统的复杂性和动态性决定了其行为难以完全预测,因此必须在系统设计中引入多种冗余机制和风险缓释方案,这样可以大幅度降低系统因单点故障或意外输入造成的失控几率。科研和工业界正积极探索多元化的可靠设计策略,包括强化学习算法的鲁棒性提升、模型解释性增强、输入数据的严格校验与过滤、多样化测试手段的运用等,这一系列举措旨在提升系统面对未知环境和异常数据时的自适应能力。与此同时,渐进式部署和实时监控成为确保人工智能守护功能有效性的必备条件。通过持续监测其运行状态和输出结果,及时发现问题隐患,是实现场景下安全运营的重要保障。监管机构与企业合作推动相关标准体系建设亦不可或缺,有助于规范研发流程和系统评估方法,建立行业内认可的安全防护基线。除了技术层面,可靠设计还应关注伦理和法律责任的界定,确保系统透明度和用户信任。

人工智能的决策过程应具备一定的可解释性,让使用者能够理解系统行为背后的逻辑,避免黑箱效应导致的盲目信赖和潜在风险。结合用户反馈进行迭代优化,推动技术与应用的良性循环,形成更加完善的安全保障生态。总的来看,构建为不可预测系统设计的安全防护措施,是实现人工智能长远可持续发展的重要基石。通过贯彻可靠设计理念,将安全与功能紧密结合,预防与应对潜在风险,将有力促进智能技术在医疗、金融、交通等关键领域的广泛应用和信赖度提升。未来,随着技术的不断进步,设计理念和防护策略也将持续迭代升级,打造更智能、更可靠、更人性化的智能系统环境。