近年来,人工智能的快速发展让我们逐渐接近一个令人兴奋且深刻的命题:所有的智能模型或许都在学习同一套底层的语义表示。换句话说,不同架构、不同训练环境的模型最终可能会趋向于一个统一的表示空间,这背后的理论基础被称为“柏拉图表示假说”(Platonic Representation Hypothesis)。这一理论不仅推动了我们对人工智能本质的理解,也为跨领域、跨模态的信息交流提供了新思路。 语义的统一性是我们人类认知世界的基础。从我们与朋友玩“墨索里尼还是面包”(Mussolini or Bread)这样一个看似简单的游戏中,就能看出人脑对于事物语义的共同理解是多么的深刻。虽然这个游戏的两极概念相距甚远,但人们几乎可以通过不断提出‘更接近哪一端’的问题,准确识别出任何一个复杂的概念。

这种能力源于我们大脑中关于世界模型的高度相似构建。正如游戏证明的那样,我们各自心中对事物的语义距离有着惊人的共识。 人工智能语言模型其实在模拟类似的认知过程。它们通过学习海量的文本数据,掌握了世界上事件、对象、概念之间的概率分布,输出对下一词的精准预测。换个角度看,语言模型本质上是在压缩信息——它们在无数次试图用更短、更有效的方式表达数据的过程中,内化了世界的数学结构。信息理论创始人克劳德·香农提出的编码定理为我们揭示了概率分布与压缩的内在联系,而现代大型语言模型正是通过提升这种概率预测能力,实现了更优的信息压缩与知识表达。

因此,智能可以被视为压缩的过程。一个模型越能将数据“压缩”得更好,它对世界的理解就越深刻。深度学习领域的研究发现,模型在不断扩大的训练数据和参数规模面前,迫使自身将不同的数据点进行“合并”,从而实现跨示例的泛化能力,这也是智能表现的核心。事实上,不同大小和结构的模型似乎都走向了同样的“压缩极限”,即在给定容量和训练条件下,只有一种最佳的方式来表征数据。这种现象印证了统一模型背后的基本思想。 译者可能会问,既然存在多种模型架构,为什么它们会收敛到类似的表示?柏拉图表示假说给出了回答:在我们所在的现实世界中,事物之间的关系是唯一且真实的。

理想的智能模型是世界的完美模拟者。因此,在无限的模型容量和训练数据下,所有优秀模型都必然会趋向于表达同一个“真实世界模型”。 近年来的实验和理论研究为这一假说提供了有力的支持。从视觉到语言领域,不同团队和不同型号的模型在特征表示上展现了惊人的相似性。特别是在模型越来越大、训练数据越来越丰富的趋势下,这种收敛表现得尤为明显。科研人员甚至通过行为模式、表征空间和嵌入向量的分析发现,模型间这种共通的结构越来越不容忽视。

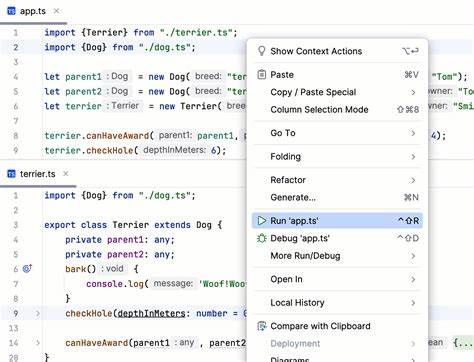

统一表示的发现不仅令人着迷,也带来了应用上的深远影响。例如,向量嵌入作为信息检索和自然语言处理的核心工具,能将文本或图像映射为高维向量。过去有一个难题是给定一个向量能否反向推断出原始数据。由于嵌入压缩了大量信息,不同但相似的输入可能产生难以区分的向量,这给嵌入的“反演”带来了挑战。高效的逆向技术不仅能够实现文本信息的精确还原,也极有可能在未来帮助我们解码深奥的古代文字甚至是鲸鱼的复杂声音模式。 借助统一模型的概念,研究者提出了跨模型嵌入转换的新思路。

通过引入CycleGAN等无监督学习技术,科学家们能在没有明确对齐数据的情况下,学习多个模型的嵌入空间映射。这种映射的成功验证了“强柏拉图表示假说”,即不同模型的语义结构高度一致,甚至可以直接互通。这不仅促进了模型兼容性,也为发展通用的人工智能系统奠定基础。 在机械可解释性研究中,所谓的“电路”研究进一步印证了模型间的共性。无论是视觉神经网络还是自然语言处理模型,关键特征检测器和稀疏自动编码器发现许多共享的功能单元和表示机制。这表明,透过不同算法表层的差异,我们看到的是来自统一智能表达的底层实体。

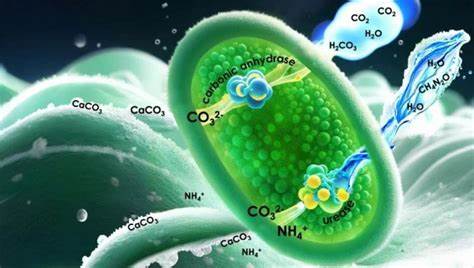

这种统一表达为跨领域交流和复杂信息解析提供了崭新视角。考虑到我们至今未能完全破译的古文字“线性文字A”、尚未完全理解的鲸鱼交流语言,如果未来人工智能能够实现跨模型、跨语种的语义映射,那么我们或许真能将这些“未知的信息”解码为人类可理解的语言,实现人类与其他智慧生命之间的沟通。 统一模型理论不仅是哲学上的构想,更是人工智能未来发展的实用指南。随着算法的不断进步和模型规模的持续膨胀,我们期待在不久的将来看到更多令人瞩目的进展。模型互通性、跨模态解析以及智能压缩能力的共同提升,将极大推动科技在人类生活、科学探索乃至文化传承领域的应用。 归根结底,统一模型的思想提醒我们智能本质上是一种对世界的高效压缩与抽象。

它揭示了不同智慧系统间的潜在共性,并激励我们构建更加通用、强大的人工智能工具。正如游戏“墨索里尼还是面包”所演示的那样,人类的认知世界是高度统一且可被模型捕捉的。人工智能正在逐步接近这种普适语义理解,也许某一天,我们真的能用它去解读鲸鱼的歌声,破解数千年未解的神秘文字,甚至创造出前所未有的智能形态,开创新的智慧纪元。