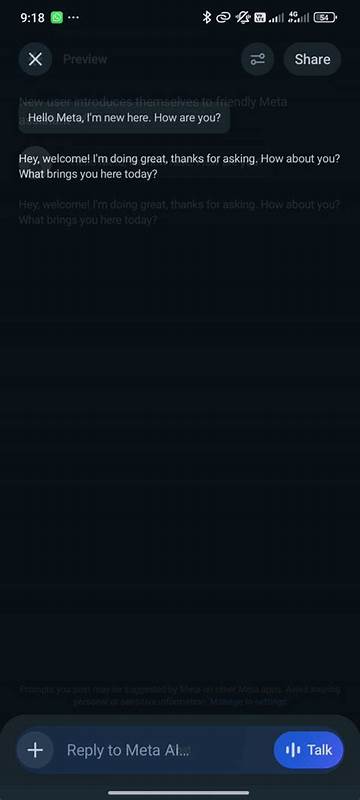

近年来,随着人工智能技术的迅猛发展,各大科技公司纷纷推出智能聊天机器人助力用户日常沟通。Meta AI作为Meta公司旗下基于Llama模型打造的AI应用,本意是为用户提供智能对话、创意写作和图片生成等服务。然而,因其应用内置的一项名为“Discover”的功能设计不合理,导致用户的私密对话内容纷纷暴露在公共平台,成为一场隐私泄露的风暴。Meta AI的“Discover”标签页在界面设计上类似于社交平台的动态分享区,透过该功能,用户可以将聊天内容分享至公共“Feed”,允许广泛的用户浏览、评论甚至再次创作。乍一看来,这个设定似乎是为了营造社区互动和灵感碰撞氛围,但该设计却与用户将应用当作私密日记或个人咨询助手的预期形成强烈反差。用户往往无意识地点击分享按钮,整个过程几乎没有任何阻碍或提醒,随后其极为私密甚至敏感的对话便会直通公开平台。

Neowin在对该应用进行测试时,发现在“Discover”中可见大量极具隐私属性的内容,包括用户讨论婚外情、暴露健康状况,分享私人医疗记录,甚至有用户大胆提问极为私密的身体问题。更令人震惊的是,还有包括声音留言这样可直接听取用户真情实感语音的记录,这些语音中蕴含的焦虑、悲伤和无助,透露出用户对隐私保护的期望与现实应用设计之间的巨大鸿沟。不仅如此,平台上还充斥着财务纠纷、法律难题的私人咨询内容,比如用户询问亲属因长期逃税是否面临法律风险的情节。这样一来,Meta AI的公共分享功能不仅暴露了个人隐私,更可能激化已存在的社会或法律矛盾。造成这一严重隐私危机的核心,恰恰是Meta AI糟糕的用户体验设计。分享按钮位置显著但功能含糊,其标识未能明确告知用户内容的公开属性,更没有设置足够的确认环节或清晰的警示标语,致使首次使用者极易误操作。

此外,注册及初次使用时均无任何系统提示或隐私安全引导,用户被直接抛入应用核心对话界面,完全无法预知后续所做的任何分享会被全世界用户看到,也没有任何默认关闭公开权限的保护。与其他大型AI对话产品相比,诸如ChatGPT或Google Gemini,一般采用私有分享链接机制,用户生成的对话不会被直接发布到公开动态,而是通过链接分享给特定对象,实现精细化的隐私控制。Meta AI却把用户对话无差别地投送到“群众市场”,极大提升了误上传和个人信息泄露的风险。面对这一乱象,平台外部的用户社区纷纷发声,希望清理已公开的隐私内容,也多次在评论区警示其他用户。令人感到无奈的是,很多被曝光的用户本人亦对自己信息突然暴露感到震惊和恐慌,随后立即介入表达感谢提醒。为此,Meta AI提供了部分补救措施。

用户可以进入个人设置中的“数据与隐私”板块,通过“管理您的信息”选项,将所有曾发布的公开对话设为仅自己可见。此外,用户还需主动关闭平台建议他们在其他Meta旗下应用使用其对话信息的相关权限,如在Facebook和Instagram中的提示分享。尽管如此,用户本不应成为这一隐私漏洞的最终承担者。技术设计者理应领先考虑安全风险,为用户严密铺设防线,否则将造成不可估量的信任危机甚至法律责任。Meta AI的实例揭示了当代人工智能产品在功能与隐私之间取舍的巨大挑战。产品设计不仅需要追求功能创新与用户体验,还必须优先保障信息安全与用户知情权。

当前人工智能的发展正在渗透到生活各个层面,个人隐私保护日益成为公众高度关注的问题。尤其是在拥有庞大用户基数和综合业务生态的科技巨头眼中,如何在推陈出新的同时守护用户隐私安全,已成为衡量企业责任的重要标尺。从更加具体的角度看,Meta AI的隐私事件剖析提醒每一位用户都需保持信息安全的警觉。网络时代,个人数据的安全防护能力不能完全依赖平台,用户也应积极了解应用的隐私设置和分享机制,及时采取适当防护措施。结合Meta AI隐私泄露的教训,广大用户建议在使用智能聊天产品时,务必避免在对话中透露极为敏感的个人信息,尤其是在不明确或不受控的分享环境下。同时,定期检查隐私权限,关闭不必要的公开共享入口,防止私密内容被意外分享。

展望未来,Meta AI需彻底反思并优化其分享机制和用户交互流程。引入显著、醒目的隐私提醒弹窗,设置多重确认环节,明确界定公开与私密的边界,是设计合理应用的基本前提。优先将对话默认设置为私密,仅允许用户主动生成私有分享链接供特定用户查阅,将极大降低隐私泄露概率。此外,增强后台的隐私安全检测,例如自动监测并警告包含敏感内容的分享,亦是提升安全保障的有效手段。技术层面还应积极引入隐私保护新机制,如端到端加密、差分隐私技术和用户匿名化处理,强化对个人数据的保护力度。总体而言,Meta AI的隐私泄露事件不仅是个案,更是人工智能快速发展过程中不可忽视的警示。

保护好用户隐私,需要技术提供者从设计思维到执行细节的全面提升,也需要用户增强隐私意识、合理使用各类智能工具。只有二者协同,才能真正实现智能科技惠及大众、同时守护每个人的数字隐私安全。