扩散概率模型(Diffusion Probabilistic Models,简称DDPM)在近年来成为生成模型领域的研究热点,因其在图像生成、数据建模等方面表现出的卓越能力,吸引了大量学术和工业界关注。最简约扩散概率模型(Minimal DDPM)作为该领域的一种轻量级实现,旨在通过简化模型结构和关键步骤,以提高效率和易用性,同时保有扩散模型核心的强大生成能力。理解Minimal DDPM的运行机制,不仅有助于深入掌握扩散模型的基本思想,还能为实际应用提供切实可行的工具。扩散概率模型的基本思想源自于逐步向数据中加入噪声,并训练模型反向去噪的过程。该过程包括正向扩散和逆向生成两个阶段。在正向扩散中,真实数据逐步添加高斯噪声,直到最终变成近似纯噪声的状态;而逆向过程则从噪声开始,通过学习的去噪网络逐步恢复数据的分布。

Minimal DDPM保留了这一核心思想,但在算法框架和网络设计上进行了精简。首先,Minimal DDPM通过减少扩散步骤的数量和优化噪声调度策略,使模型在保持生成质量的前提下显著提升效率。噪声调度的合理设计对于生成结果的质量和训练速度有着关键影响。通过采用线性或余弦等简单的噪声预设曲线,Minimal DDPM能够稳定训练,同时避免过度复杂的参数调优。此外,Minimal DDPM简化了去噪网络的架构,大多采用轻量级卷积神经网络(CNN)或变换器(Transformer)变体,减少模型参数和计算资源消耗。这些改进不仅降低了模型训练和推理的门槛,也方便研究者和工程师快速上手和部署。

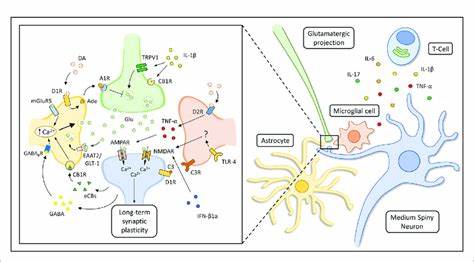

在训练过程中,Minimal DDPM利用标准的均方误差(MSE)作为损失函数,通过对噪声分布的拟合,使网络具备从任意加噪图像中准确恢复清晰图像的能力。该过程利用了马尔可夫链的性质,保证了从纯噪声到目标数据的生成路径的连贯性和稳定性。最简约的设计使得Minimal DDPM广泛适用于多种场景,包括但不限于图像生成、数据增强、图像修复以及医疗影像合成。在图像生成方面,Minimal DDPM能够生成高质量且风格多样的图像,有效替代传统GAN模型面临的训练不稳定或模式崩溃问题。在医学领域,利用Minimal DDPM合成的医学影像不仅帮助提升诊断模型的训练数据质量,也兼顾了患者隐私保护的问题。此外,Minimal DDPM在生成模型应用中展现出不错的可扩展性,适用于针对不同数据集的调优。

通过结合条件信息,如类别标签、文本描述或结构化先验,模型能够实现有针对性的样本生成,满足多样化需求。值得注意的是,Minimal DDPM相较于更复杂的大规模扩散模型如DDPM、DDIM等,在生成速度和计算资源使用上更具优势,适合资源有限的场景;同时其简化结构为新手研究和教学提供了极佳范例,促进扩散模型知识的普及。未来,随着深度学习模型和硬件计算能力的不断进步,Minimal DDPM有望通过结合神经架构搜索、多尺度建模及自监督学习等新技术,进一步提升生成质量与效率。此外,跨模态扩散模型、多任务学习等方向也为Minimal DDPM的研究开辟了广阔空间。总结来看,最简约扩散概率模型Minimal DDPM以其轻量高效的特点,成为扩散生成模型领域不可忽视的力量。其通过对核心机制的把控和简化,实现了理论与实际应用间的良好平衡,为生成模型研究和应用提供了重要起点。

借助Minimal DDPM,相关领域的开发者和研究者能够以更低的资源门槛探索扩散模型的潜力,推动AI生成技术的普及与进步。