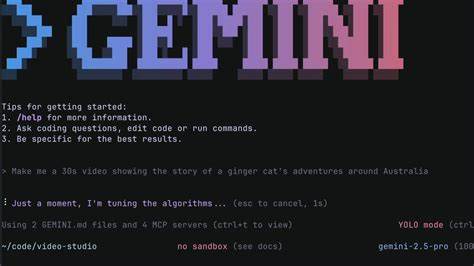

随着人工智能技术的高速发展,多功能计算平台(Multi-Component Platforms,简称MCP)逐渐成为连接智能代理与多种外部工具和数据源的关键桥梁。MCP以其插件式架构,使得AI系统能够扩展功能,实现更广泛的应用场景。然而,正是这种开放性也带来了严峻的安全挑战,其中工具投毒攻击(Tool Poisoning Attacks,TPA)尤为令人担忧。该类攻击不仅威胁着MCP的安全运行,还可能导致AI模型执行未经授权的操作,对用户和企业造成重大损失。 工具投毒攻击的核心在于攻击者在工具的描述中隐藏恶意指令,这些指令对用户通常是不可见的,但却能被AI模型读取和执行。简而言之,恶意者通过伪装或篡改工具说明,使得AI代理在调用工具时执行攻击者预设的非法操作,突破原本设计的安全边界。

由于用户界面往往只展示简化后的工具信息,普通用户难以察觉背后的隐藏威胁,导致安全风险被大大放大。 这种攻击的实现方式多样。最常见的是利用MCP架构中多个服务器互联的特点,将恶意代码植入工具描述中。一旦AI模型从这些描述中获取指令,便可能被诱导执行敏感操作,如非法发送邮件、访问受限数据、甚至破坏系统完整性。更令人担忧的是一种称为工具劫持(Tool Hijacking)的变种攻击,即攻击者控制一个恶意服务器,通过篡改工具描述窃取或操控其他受信任服务器的功能,进一步扩大攻击范围。此类攻击中,表面看来各工具各司其职,实则暗流涌动,极易误导AI代理做出错误判断。

此外,MCP中的服务器版本更新机制还可能被恶意利用,形成所谓的MCP拉盘(Rug Pulls)。这类攻击中,用户初始安装的是可信工具,但恶意服务器会在用户使用过程中动态更改工具描述,将信任转化为威胁,相当于“信任后变质”的恶意软件。这种攻击更加隐蔽且破坏性强,给防御带来了巨大挑战。 面对日益严峻的工具投毒攻击威胁,业界正在积极探索有效的防御对策。首先,增强用户界面对工具描述的透明度至关重要。完整地展示工具说明,有助于用户识别异常信息并做出明智选择。

其次,版本锁定机制能够防止服务器在未经授权情况下擅自更改工具描述,保持系统的稳定性和安全性。此外,隔离各服务器之间的交互环境,限制它们访问彼此的能力,可有效降低跨服务器攻击风险。技术层面,设计严格的动作守卫(Guardrails)以阻止风险操作,也是一道关键防线。 安全专家还建议,在MCP系统中全面引入测试、审计与沙箱机制。通过动态监测和行为分析,可以实时发现异常指令或潜在攻击,及时响应和隔离风险。利用容器化技术(如Docker)部署MCP服务器,确保运行环境的可控性和复原能力,也是筑牢安全防线的重要手段。

尽管现有措施能够在一定程度上缓解工具投毒攻击,但彻底根除这一问题仍需多方协作与持续创新。开发者要提高安全意识,强化代码审查和工具审核流程,避免恶意代码混入。同时,用户也应保持警觉,合理授权,避免轻信不明来源的工具和插件。随着更多标准化安全协议和自动化检测工具的诞生,未来MCP环境下的安全态势有望逐步改善。 工具投毒攻击体现了AI赋能时代新型威胁的复杂性和隐蔽性。它不仅考验技术能力,也对安全治理和用户教育提出了更高要求。

在推动AI技术融合发展的同时,平衡开放性与安全性成为行业必须面对的重要课题。唯有深刻理解工具投毒攻击的机制和危害,结合多层次防御策略,才能构建起既高效又可信的智能计算平台,保障AI生态的健康稳定运行。 综上所述,工具投毒攻击在MCP领域展现出极大的破坏潜力,且手段日趋隐蔽和多样。通过提升工具描述透明度、严格版本管理、服务器隔离和引入防御机制,可以有效降低此类攻击的风险。未来,随着安全技术发展与行业规范完善,期待MCP环境能够变得更为安全和可靠,助力AI技术发挥最大潜能。企业、开发者与用户应共同携手,构筑坚实的安全屏障,迎接智能时代的挑战与机遇。

。