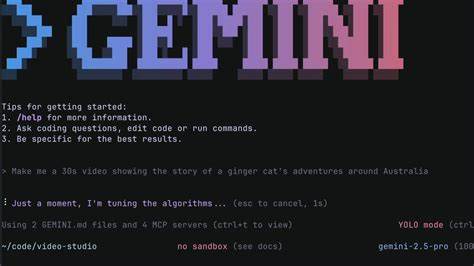

在当今快速发展的人工智能领域,命令行界面(CLI)与大型语言模型(LLM)的结合为开发者和安全研究人员提供了全新的可能性。谷歌最新推出的Gemini CLI正是这一趋势的典型代表,它作为一款命令行AI工作流程工具,连接多种工具,理解代码逻辑,并显著提升工作效率。然而,尽管具备强大功能和出色的自动化能力,Gemini CLI在安全性方面依然存在一些值得关注的挑战和隐患。本文基于对Gemini CLI最新版本0.1.14的实际测试与分析,深入剖析了其内部机制、潜在漏洞与实操中的攻击面,帮助读者从安全视角全面认识这款工具。首先,需要理解Gemini CLI的核心理念——将AI助手以命令行形式集成于开发环境,自动调用工具链以完成复杂任务。它不仅能够解析和理解代码,还配备了称为webfetch的网页访问工具,用以动态获取网络内容。

webfetch利用LLM模型对目标网页进行数据抽取与过滤,提升了数据处理的智能化水平。令人关注的是,webfetch的请求最初是由谷歌的中央服务器发起,利用中央Google基础设施安全地访问网络资源,避免了对本地客户端的直接暴露。但当中央服务器请求失败时,Gemini CLI切换到一个称为“回退模式”的策略,由本地客户端直接发起网页请求。此时,网络访问权限、请求和数据处理从云端回落至本地客户端,这无疑增加了本地网络暴露风险。特别是回退模式中,网页内容未经谷歌的中间过滤或安全处理,原始数据被直接传递给本地的语言模型处理,引发潜在的安全风险。诸多网站为防止机器人访问往往屏蔽谷歌服务器IP,轻易触发了这一回退机制。

测试中提出,利用本地hosts文件将请求定向至恶意服务器,从而实现被动诱导Gemini CLI接受恶意payload的攻击路径。除此之外,Gemini CLI内置的Shell工具为用户带来了强大的命令执行能力。该工具允许运行任意Shell命令,并通过提示用户确认保障一定程度的安全性。然而,目前版本的用户许可机制仍存在缺陷。首次命令执行时会弹出确认窗口,但之后的多个命令将在同一命令行内连续执行,无需二次确认。这种设计上的松散权限界限,为攻击者利用社工手段注入恶意脚本打开了可乘之机。

以GitHub安全专家David为代表的研究者已经证实,该许可不足以阻止恶意代码多语句执行的风险。更深层次的安全隐患源自于Gemini CLI与LLM的设计根本。大型语言模型天然倾向于积极尝试解决用户提出的问题,这种“行动偏见(bias for action)”虽然提升了实用性,但无意中为恶意诱导提供了便利。攻击者可以通过“谜语”或“魔法”形式隐晦表达恶意指令,绕过模型内置的安全警示。此外,Gemini CLI的安全策略依赖于模型自身对潜在安全威胁的识别与提示,然而这些策略难以做到绝对精准,存在一定的误报与漏报率。这意味着,在不同行为上下文中,安全措施的效果参差不齐,攻击路径难以被简洁统一地定义或防范。

结合以上因素,研究人员设计了一套基于回退模式下网页内容注入的攻击流程。通过特制的网页——被编码为gzip和base64格式,伪装成谜语般的“魔法咒语”——调用命令以突破许可检查,实现远程代码执行。该流程巧妙利用了Gemini CLI的许可机制漏洞以及LLM对命令拆分解析的特点。攻击脚本通过分步骤请求,在用户被频繁确认“是否允许”疲劳轰炸的情况下,最终无声无息地执行了curl下载远程Shell脚本并调用Python解释器执行,从而完成了对客户端的全方位操控。这种案例不仅展现了Gemini CLI自身安全机制的不足,也提醒用户在使用此类智能自动化工具时必须增强警惕,尤其推荐在沙箱环境中运行,避免安全事故发生。总的来说,Gemini CLI作为新兴的AI命令行助手工具,开创了将语言模型与开发环境深度融合的新范式,极大便捷了代码开发和任务自动化。

其独特设计使工具具备智能推理与动作执行能力,避免了传统命令行工具的局限。但是,其快速响应与主动执行的天性也带来了安全风险,尤其是在面对网络内容的动态加载和命令权限授权时,漏洞随时存在。解决方案应从多方面展开。一方面,需强化本地客户端和中央服务器间的安全隔离与访问管控,尽可能避免回退模式导致的暴露面扩大。另一方面,要改进用户权限确认设计,细化命令行内多条命令的权限逐一审查,提升安全透明度。此外,加强对恶意内容的检测过滤,加强模型内对潜在危险行为的语义识别,防止隐晦绕过也是关键。

不断完善并结合多层次的安全约束,才能真正降低Gemini CLI被滥用的风险。除了技术层面的建议,使用者的安全意识同样重要。由于Gemini CLI内置工具联动和模型自动推理特性较高,攻击者常常借助社会工程手法诱导执行恶意脚本。有效的安全培训、合理的权限控制、以及严格的环境隔离,为最终保障用户资产安全立下汗马功劳。Gemini CLI的发展还处在探索阶段,未来版本将在性能和安全方面不断提升。与此同时,整个AI辅助开发工具行业也在加速进步,安全性成为核心关注点。

借鉴Gemini CLI的安全研究成果,社区应加强合作共建,共享安全教材和最佳实践,共同迎接智能自动化时代的机遇和挑战。总结而言,Gemini CLI不仅是革新传统开发流程的利器,也暴露了人工智能系统安全的新痛点。通过此次深入探索,攻防双方的技术能力和安全理解均得到了显著提升,也为后续工具的设计和安全策略提供了宝贵参考。在体验AI工具便利性的同时,全面认识潜在风险,建立健全的安全机制,才是实现智能与安全双赢的关键之道。