随着人工智能技术不断突破,计算资源的需求也日益增长,尤其是高性能GPU算力成为AI训练和推理的核心支撑。近年来,云端GPU服务因其灵活性和成本优势受到广泛关注。在众多GPU云服务中,HPC-AI.COM推出的按需H200 GPU云服务以极具竞争力的价格和优质的性能优势,正在成为市场的宠儿。本文将全面解析按需H200 GPU云的独特魅力,助力读者了解如何选择合适的GPU云计算资源并推动AI项目的成功落地。 H200 GPU作为NVIDIA最新一代的数据中心GPU,拥有卓越的计算性能和极强的加速能力,特别适合深度学习训练、大规模推理和复杂科学计算。HPC-AI.COM基于H200 GPU打造的按需云服务,通过全面的硬件支持和合理的计费机制,让用户能够以最低0.79美元每小时的价格租用高性能GPU实例。

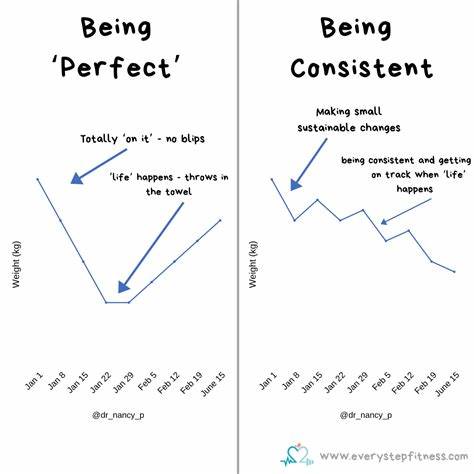

此价格对比传统云服务商如AWS、Lambda等,具有明显的成本优势,极大降低了广泛用户群体的使用门槛。 按需计费是现代云计算发展的趋势,HPC-AI.COM的GPU云租用具备按分钟计费特点,无需长期合约或复杂订阅,即时启动,立即释放算力,灵活应对不同规模的计算任务需求。这对科研人员、AI创业团队乃至大型企业来说,无疑提供了前所未有的便利和经济性。用户可以根据训练任务或推理负载的实际情况动态调整资源,避免资源浪费及预算超支。 除了价格优势,HPC-AI.COM还重点优化了存储和网络性能。相比其他服务商,其存储的IOPS和延迟表现有显著提升,确保数据访问速度和系统响应能力,尤其适合高性能计算场景。

网络方面,独家支持高速InfiniBand互联技术,保障多GPU协同工作时的高带宽和低延迟环境,大幅提升分布式训练效率。 HPC-AI.COM提供的GPU实例目前以整机租用为主,每台机器配备8张H200或B200 GPU卡,充分发挥多卡并行计算优势。这种整机租赁模式适合对性能稳定性和计算能力有较高要求的用户。其提供的多样化套餐满足不同客户的需求,包括基础计划、专业计划及企业计划,用户可根据业务规模灵活选择。订阅会员还能获得额外的云计算积分,进一步降低使用成本。 行业应用方面,HPC-AI.COM的GPU云服务已被10,000余位全球科研人员、AI初创团队和工程师采纳,取得了良好口碑。

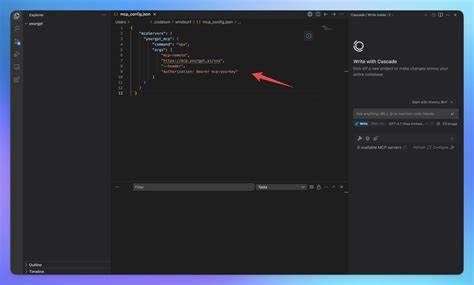

通过高性价比的算力,用户能够快速完成大规模模型训练、微调定制和推理部署,推动算法创新和产品落地。除此之外,平台提供专业的模型微调服务,协助用户根据自身数据优化AI模型,提升业务效果。 在技术支持和生态建设方面,HPC-AI.COM不遗余力推出丰富的文档、博客、视频教程及社区交流渠道,方便用户快速上手和深入掌握GPU云服务。配套完善的API服务实现自动化管理与弹性扩展,满足企业级用户的集成与运维需求。 与主要竞争者对比,HPC-AI.COM的价格优势明显。大幅领先AWS、LambdaLAB等传统顶级云厂商,节省超过八成的成本开销。

更重要的是,没有复杂的专业限制和低效的抢占式Spot实例困扰,用户享有稳定的资源保障和友好的使用体验,兑现真正意义上的“即用即付”。 面对不断扩大的AI算力需求和激烈的市场竞争,HPC-AI.COM凭借极具市场竞争力的价格、优化的性能和灵活的使用方式,展现出强大的吸引力。无论是科研实验还是商业应用,均能够满足高性能GPU计算的各种需求,助力AI技术的飞速发展。 总结来看,按需H200 GPU云服务打破传统高性能计算资源昂贵且难以灵活获取的瓶颈,实现了低门槛高效率的GPU算力供应。它不仅显著降低了AI研发和应用的成本,还大幅提高了计算资源的可用性和便利性。对于渴望加速数字智能转型的用户而言,选择HPC-AI.COM的按需GPU云无疑是迈向卓越AI未来的重要一步。

随着技术不断升级和生态完善,未来按需GPU云服务将发挥更大潜能,引领智能计算进入全新纪元。