近年来,人工智能(AI)的快速发展引发了广泛关注,尤其是大型语言模型(LLM)在自然语言处理领域的突破性进展,使人们对通用人工智能(AGI)的实现充满期待。然而,Dwarkesh Patel在其播客中表达了一种相对谨慎且更为延长的发展时间线观念,强调了持续学习对AI系统的重要性以及当前技术的局限性。本文将深入解析Dwarkesh对AI发展路径的看法,探讨持续学习为何成为瓶颈,以及这一特性对未来白领工作自动化和智能代理技术的深远影响。 Dwarkesh的观点核心在于,尽管当前的LLM在完成诸如重写自动生成的转录文本、摘选精彩片段或协同撰写文章等语言任务时表现出一定的能力,但其表现仍远非完美,约为中等水平。更关键的是,现有模型缺乏持续学习的能力,也就是说,它们无法像人类一样随着时间积累经验、自我纠错和持续改进。在播客后期,Dwarkesh详细描述了自己的实践经历,尝试用LLM辅助音频后期制作,尽管任务相对明确且短期,但模型依旧不能稳定地达到理想效果。

此现象揭示了当前AI系统在应用层面对复杂、连续任务适应能力的不足。 为什么持续学习如此重要?人类劳动者之所以卓越,主要在于他们能够在长期实践中不断积累上下文信息,深入反思失败原因,并改进工作流程,这样才能实现效率提升与能力增长。Dwarkesh用教导孩子吹奏萨克斯风的例子形象地说明了这一点:孩子通过实际反复尝试,听声音并加以调整,才能逐步跻身高手行列。相比之下,如果仅仅通过纸面指令进行教学,则难以达到有效教学效果。相似地,LLM目前只能通过设计精细的提示词(prompting)指导来“教学”,缺乏互动反馈和自我调整机制,导致学习能力受限。 虽然强化学习(RL)和微调技术在一定程度上能够提升模型能力,但Dwarkesh认为这些技术还远未能实现人类那种有意识的、适应性的学习过程。

他设想,未来或许可以出现智能模型自主搭建训练环境、提出可验证练习题目并通过自我反馈进行反复优化,但这种环境构建和反馈机制的复杂性令其难以在短期内实现。这种观点使得他对于近期实现全面白领岗位自动化持较为保守的态度,认为若人工智能发展停滞,25%以下的白领工作可能被取代,而剩余任务则需人类持续干预和监督。 在智能代理(computer use agents)方面,Dwarkesh同样表达了谨慎观点。尽管Anthropic等研究机构预测2026年底前AI能够胜任复杂的计算机操作——比如自动处理报税、整理发票、与多方沟通等任务,但他认为完成此类长时间、多步骤任务尚需克服长时间回报稀疏、模态转换困难及训练数据匮乏等挑战。通过观察当前技术如GPT-4到GPT-5的演进,他指出计算机操作任务的难度远超文本生成任务,需要突破的数据规模和训练方法还未成熟。 然而,Dwarkesh对AI的推理能力持乐观态度。

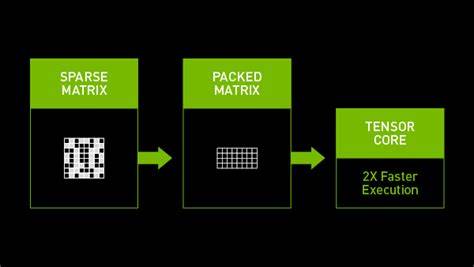

他提到,高阶模型如Claude Code和Gemini 2.5能够展现真正的推理过程,具备内省和自我纠错能力,不再只是简单输出结果,而是执行复杂的思维链条,体现了接近人类智能的雏形。这一点鼓舞了许多研究人员与应用开发者,表明我们正处于从工具型AI向智能体AI转变的早期阶段。 对于未来预测,Dwarkesh坦言自己的时间判断分布较宽,但对以下几个里程碑抱有50%的信心:到2028年,AI能够胜任小型企业税务的端到端处理工作;到2032年,人工智能将具备类似人类员工的“在职学习”能力,能快速获得深入的情境理解并持续优化表现。这一预测比一些嘉宾更加保守,主要基于他对持续学习技术成熟度的怀疑以及计算资源、数据瓶颈等现实限制。按照他的观察,当前AI进展依然高度依赖训练计算规模的扩增,而这种扩张难以长期维持,未来的突破更多将依赖基础算法和架构的创新。 一个值得关注的问题是持续学习与强化学习的关系。

部分专家认为强化学习实际上能够模拟人类学习过程的部分特性,包括基于反馈的策略优化和自主探索。然而,Dwarkesh认为当前强化学习方法在采样效率和自我检验能力上仍不及人类,由此其学习效率和稳定性受到限制。也就是说,要达到人类级别的智能,模型不仅需要接受更多反馈,更需要能有效地判别反馈质量与优化路径。 此外,Dwarkesh指出,人工智能系统未来的一个巨大优势是集体学习能力。不同于人类个体只能通过个人经验成长,AI系统可以通过复制、整合多份学习成果,迅速实现跨任务和跨领域的知识迁移。一旦突破持续学习障碍,这种“群体智能”有可能引发爆炸式的智能跃升,极大改变经济结构和社会运作模式。

这也强调了我们未来需要高度关注AI安全、伦理与监管问题,确保技术发展不仅高效,更加稳健可靠。 虽然Dwarkesh对近期AI技术突破持谨慎态度,他依然对长远发展抱有乐观。智能体从当前的“GPT-2时代”向真正具备广泛适应能力和自主学习能力的未来进化,是一个必然趋势。正如他引用的谚语“事情发生总是比你想象的要久,但一旦发生,却比你想象的要快”,人工智能领域也是如此。技术积累的过程可能漫长而曲折,但一旦关键瓶颈被攻克,变革将迅速且深远。 总结而言,Dwarkesh的观点为我们提供了一幅既务实又充满希望的人工智能发展图景。

持续学习作为人类智能的核心优势,也是AI亟需攻破的技术难关。当前模型虽已具备强大语言理解和基本推理能力,却尚未真正实现自主的“在职学习”。这一缺陷限制了AI在复杂白领工作、智能代理等领域的广泛应用。展望未来,持续学习技术的突破可能带来智力爆炸式增长,结合集体学习的优势,AI有望在2030年代迎来质的飞跃。与此同时,社会各界需提前准备应对可能带来的经济结构变动和伦理挑战,共同推动AI健康发展。