随着科技的飞速发展,尤其是人工智能和无人驾驶汽车的兴起,人类对“人类”身份的认知也发生了微妙的变化。看似冰冷机械的自主系统正以意想不到的方式引发我们重新思考人与机器、人与非人之间的界限。2014年关于无人驾驶汽车和军事机器人研究的成果,深刻揭示了人们在与自主技术互动时,无意识中对其赋予的“人性化”特质,如何影响我们的情感、判断及社会行为。 在伊拉克战争期间,美军士兵为执行排雷任务的机器人举行“葬礼”这一新闻,引发了社会广泛关注。华盛顿大学的朱莉·卡彭特教授通过实地调研发现,长期与机器人共事的士兵们逐渐将这些机器拟人化,赋予其人格特质,甚至认为它们具备情感和意识。在战场的混乱与孤独中,机器人成为士兵们难得的“伙伴”,缓解了战争带来的压力与恐惧。

这一现象与士兵们对敌人极度去人性化的态度形成鲜明对比。前线战士为了面对残酷的战斗,常常把敌人称作“炸薯条”(Crispies)等侮辱性称谓,从而实现心理上的麻木与割裂。这种在人的心目中将非人类极度人格化,而同时剥夺真正人类的个体尊严的对立,展示了“人性认知”并非一种简单的二元划分,而是具有极强流动性和情境依赖性的复杂心理现象。 技术的快速发展,尤其是在自动驾驶领域,也将这一现象推向了新的高度。心理学家亚当·韦茨等人通过实验发现,赋予无人驾驶汽车一个名字、声音甚至性别,能够显著增强人们对其智能的认可与信任。例如,将车命名为“Iris”,并配以女性化的声音提示,使得参加实验的司机们对车辆的操控更具信心,驾驶体验也更加愉悦。

与之相反,仅具备纯粹自动驾驶功能但缺乏人性化特征的车辆,司机则更容易对事故的发生追究其责任和缺陷。 在实验中,无论汽车驾驶模式如何,参与者均经历了模拟的交通事故。当被询问事故责任归属时,有人更愿意责怪非人性化的机器和制造者,而在汽车具备人性特征时,责任感则会有所减轻。这种心理模式与我们面对可信赖人类驾驶员时的反应颇为相似:假如一位熟悉且可靠的驾驶者遭遇不测,旁人往往会体谅其不可控的因素,减少责备。 这一信任的增强不仅仅停留在认知层面,生理指标的监测也显示,驾驶带有人性化特征汽车时,参与者的心率和惊吓反应明显降低,显示出更高的心理舒适度。这些发现提醒我们,人类对外界的信任和责任分配,往往建立在情感化和人格化的基础上,而非纯粹理性计算。

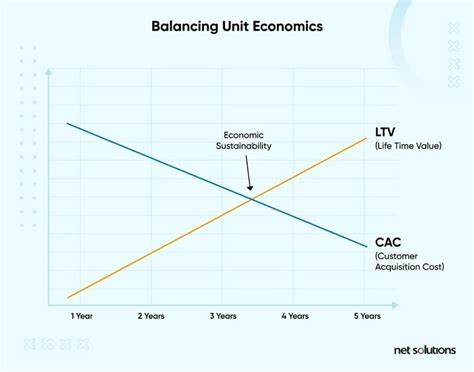

伦理学家罗恩·阿尔金在军事机器人领域提出的“责任归属问题”,同样适用于无人驾驶汽车的广泛应用。他指出,当无人自治武器或智能车辆出现失误甚至致命事故时,传统的责任追究模式面临巨大挑战:事故究竟该归咎于机器本身、设计者、制造商,还是使用者?现有法律和道德框架尚未能完全涵盖这些新兴情况,迫切需要社会各界的深入探讨和制度创新。 回顾“人性”的认知模式,此前学术界对去人性化的研究颇多,强调在人际交往中忽视或贬低对方的意识、情感和理性能力,可能导致歧视、暴力甚至社会冲突。无人驾驶汽车和机器人拟人化的现象,反映出人类在赋予非人实体“人性”时的天生倾向。这不仅仅是技术的冷冰冰功能展现,更涉及深层的心理需求,如归属感、信任与责任感的建构。 随着技术进一步渗透日常生活,我们身边的机器变得越来越“懂人懂心”,这一趋势有望引导更多的积极社会互动,促进人机和谐共存。

然而,技术也可能因过度拟人化引发误导,使人们在法律和道德层面不能完全厘清权责。此外,若人们忽视现实中的他人个体差异,选择性剥夺周围人的人性设施,也可能加剧社会冷漠和矛盾。 从马克思开始,许多技术批评者担忧自动化与机器智能的发展可能削弱人际间直接互动,进而推动“去人性化”进程,使社会更加机械和冷漠。然而,来自现代心理学和科技发展的观察则显示,恰恰是这些技术的展现,激发了人们对“人性”认知的多样性和灵活性。通过恰当的设计和互动,我们既可以提升对机器的信赖感和接受度,也能在反观中明晰人与人之间不可替代的独特性。 未来,随着无人驾驶汽车、军事机器人等高智能技术逐步普及,社会各方面将面临巨大挑战:如何建立合理的责任追究机制,如何防止去人性化的社会风气蔓延,以及如何利用好拟人化技术促进人类福祉。

对此,跨学科合作尤为关键,结合心理学、伦理学、法律与工程技术的视角,形成既具利他精神又科学严谨的应对策略。 技术的进步不是单向的替代,而是一面镜子,映照出我们对“人性”的理解和期待。看见机器人和汽车中的“人类”,既是对技术的赋予与信任,也是对自身社会心理的深刻反思。未来社会如何定义“人”,又将如何平衡人与非人的边界,这些问题正等待人类共同书写新篇章。