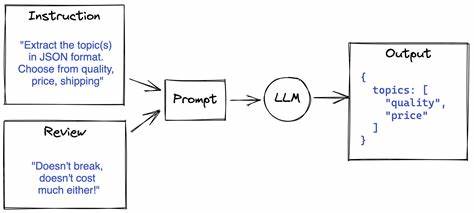

近年来,人工智能技术的迅猛发展为各行各业带来了前所未有的便利,同时也被一些国家和组织利用于网络隐秘行动和信息战。OpenAI作为领先的人工智能研发机构,最近公布了关于其AI工具被滥用以进行秘密影响操作的最新调查报告,揭示了多起与中国相关的复杂且跨平台的影响行动。这些行动不仅针对国际社会意见,还涉及社会工程、监视以及伪装成合法身份展开的情报收集。OpenAI的报告强调,中国的这些隐秘操作正利用其生成式人工智能技术,在多个社交媒体平台上制造有针对性的帖子和评论,以达到操纵舆论和宣传的目的。具体来说,被命名为“Sneer Review”的行动广泛使用ChatGPT生成简短的评论或回复,这些内容多语言发布,涵盖英语、中文和乌尔都语,活跃于TikTok、X(原Twitter)、Reddit、Facebook等多种平台。通过制造发帖与评论的互动错觉,企图营造自然用户参与的假象,误导普通用户对话题的真实态度判断。

令人关注的是,这些操作不仅限于公开发表内容,还直接利用人工智能协助编写内部报告和绩效评估,系统化地总结和规划其网络活动的具体步骤。这体现了人工智能技术在实际网络战术中的深度嵌入与应用。除了影响舆论外,另一中国关联行动伪装成记者和地缘政治分析师身份,利用AI生成文章、账户简介,并翻译及分析邮件和信息,涉及内容甚至包括针对美国政府官员的通信。此类行动明显表现为情报收集与间谍活动的现代演变,通过数字化和自动化极大提高了其隐秘性和效率。OpenAI报告还指出,中国的一些监视行动专门关注西方抗议活动,将实时数据上报中国安全部门。此类监测工具在后台也借助AI来调试代码,并设计推销文案,展示出人工智能既支持技术开发,也在情报输出环节起关键作用。

除了中国之外,OpenAI这次调查还涉及俄罗斯、伊朗、菲律宾、柬埔寨和朝鲜等国家的类似影响行动,包括虚假广告推广、招募诈骗及信息垃圾邮件活动,显示了网络影响战的国际化和多样化趋势。报告总结,虽然这些利用AI的行动手段愈发复杂且跨平台操作,但大多在早期被阻断,未造成广泛公开影响。人工智能虽赋予攻击者更强的内容生成能力,却不一定能直接转化为更大范围的舆论操控成功。OpenAI在保护其技术免遭滥用方面采取了果断措施,通过识别异常行为和账户封禁,有效遏制了这些恶意影响行动的扩散。这一做法也凸显了人工智能企业在维护数字空间安全和公正扮演的重要角色。此次事件暴露出随着AI技术渗透到国际信息战场,国家间博弈的形态和手段正在发生深刻变化。

利用先进工具实施隐蔽而广泛的影响活动,构成了新型信息安全挑战,也对全球网络监管和跨国合作提出更高要求。各国应增强人工智能技术的透明度,建立健全法律法规和多方监督机制,防止技术被用于操纵公众舆论、侵害隐私或破坏民主进程。同时,公众对信息来源的辨识能力也亟需提升,以应对由AI自动生成内容带来的真假难辨困境。总体来看,OpenAI今次披露的中国关联影响行动案例,既展示了人工智能技术在信息战中的双刃剑效应,也呼吁国际社会警惕并积极应对数字治理的新形势。未来,只有加强技术伦理建设、推动国际合作以及提升公众媒体素养,才能有效抵御信息操控的风险,维护开放透明的数字生态环境。