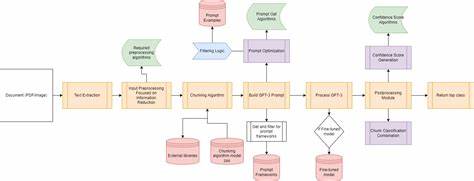

随着人工智能和深度伪造技术的迅速发展,虚假信息和篡改视频的传播成为社会重要的挑战。为此,越来越多的科技公司及相关机构提出了所谓“内容认证技术”,旨在通过技术手段鉴别媒体内容的真伪,防止伪造信息对公众产生误导。然而,这类技术的实施不仅并不一定能够有效解决深度造假的根本问题,更可能带来严重的隐私侵犯和言论自由的隐患。 内容认证技术主要基于数字签名和加密技术,通过设备制造商或软件开发商在图像或视频文件上嵌入加密签名,以确认内容未经篡改或经过合法编辑。理论上,如果一段视频或照片文件附有可信的数字签名,任何修改都会使签名失效,从而证明内容的真实性。许多支持者认为,将数字签名保存在如区块链这类不可篡改的公共数据库中,能够为普通用户提供验证媒体真实性的手段。

然而,这种技术架构存在诸多理想与现实的脱节。首先,将“可信”的认证权限集中于少数设备制造商和知名软件厂商手中,容易形成技术门槛和市场垄断。从审查角度看,这等同于设立了一个少数“权威”机构判断信息可信度的机制,极大限制信息创作者的自由。普通用户或小型创作者如果没有能力使用经过严格认证的设备和软件,上传的内容可能被自动标记为“不可信”,导致言论被边缘化和审查。对于新闻自由和民间监督权利,此类技术无疑带来严重挑战。 更为严重的是,内容认证技术不可避免地将创作者的信息隐私暴露于设备制造商和软件平台。

因为数字签名的生成往往绑定于设备硬件和软件环境,任何编辑操作和内容上传都需经过具备签名权限的系统,平台商则拥有对内容的访问权。这就带来了用户数据在后端被监控和泄漏的风险,尤其是在涉及敏感视频资料如警方执法记录时,创作者可能因隐私被侵犯或遭到权力部门施压而不敢公开揭露真相。 从技术层面来看,即使是严格的内容认证机制也难以完全防止伪造技术的突破。攻击者可能通过多种方式绕过认证体系,比如伪造GPS定位让摄像头记录错误的拍摄地点;从设备中窃取数字签名密钥进行假冒签名;利用云服务漏洞让编辑工具“误签”非法篡改内容;甚至通过模拟屏幕播放伪造视频并用认证摄像机再拍摄,借助“模拟”环节掩盖造假痕迹。整体而言,技术陷入了一种“攻防竞赛”的状态,难以实现完全安全的认证效果。 此外,另一类被提倡的方案是将非真实内容甚至人工智能生成的图像和视频强制水印或签名,标明其“非原创”身份。

该方案不仅难以全覆盖所有AI生成内容,也存在水印可被去除或篡改的技术难题。同时,强制注册与标记的机制,还可能成为监控和审查的工具,进一步伤害数字自由与隐私安全。 深究内容认证技术无法解决的根源,是“真假内容”的社会认知问题。无论技术多么先进,数字媒体的真实性最终还是依赖于人们对信息来源的判断、对发布主体的信任及多方面的社会环境。在全社会中建立有效的新闻素养、媒体识别能力和信息公开透明机制,才是遏制虚假信息最根本的途径。技术无法替代人们对信息的思辨与批判,这种能力的培养需要教育和公共政策的持续投入,而非一味寄希望于技术奇迹。

同时,内容认证技术带来的潜在隐私侵犯和言论监控风险,若未加以规范,极易被滥用成为威权控制和信息操纵的工具。对于尤其是处于发展中国家或弱势群体的普通民众而言,缺乏认证设备或合规渠道将导致他们的声音被忽视或压制,加剧信息鸿沟和社会不公。技术应当服务于公共利益与社会正义,而非强化权力垄断和监控手段。 总之,内容认证技术尽管在防范部分虚假内容上具有一定的潜力,但其技术和制度上的缺陷,使其不仅难以成为万能钥匙,反而可能对言论自由、隐私权和多元表达形成损害。我们需要对其广泛推广持谨慎态度,并更多关注加深公众信息素养、推动开放透明的信息环境和完善法律保障。只有建立起一个多维度、协同发展的生态,才能真正有效应对虚假信息挑战,维护数字时代的自由与正义。

。