近年来,生成式人工智能模型取得了令人瞩目的成就,促使许多人相信通用人工智能(AGI)即将实现。表面上看,这些模型似乎捕捉到了人类智能的本质,具备语言理解、视觉感知等多种能力,甚至在某些任务上接近或超越人类表现。然而,深入分析后我们发现,这些多模态模型背后的机制远非简单的智能体现,而是基于现有硬件扩展的规模化运算结果。更重要的是,这种依赖规模的策略被误解成了通往AGI的捷径,但现实远比这复杂得多。多模态——即将不同感知和认知模式如语言、视觉、行动等整合在一起——的方法存在先天的局限,短期内难以实现真正的人类水平AGI,尤其在诸如传感运动推理、动作规划与社会协调等关键智能领域。推动AGI的发展,需要重新思考智能的本质,把“身体性”和与环境的交互作为核心,视多模态处理为由此自然涌现的副产品。

首先,定义通用人工智能时不能忽视它必须解决源自物理现实世界的实际问题。比如修理汽车、解开绳结、烹饪食物等活动,都是纯粹符号处理方式无法胜任的。实现这些任务,需要AGI具备深入的物理世界模型和感知能力。这样的智能系统应该不仅仅依赖符号,而是内嵌对真实世界因果关系、动力学和物理规律的直接理解。从这个角度看,目前大型语言模型(LLM)和多模态模型在模拟世界认知时其实只是表面功夫:它们并非真正理解世界,而是通过海量文本数据中符号的统计关联做出下一步预测。这种“世界模型”只是符号层面的抽象,很难支撑实际物理交互和复杂环境适应性。

支持大型语言模型拥有隐式“世界模型”的证据,比如在围棋或奥赛罗游戏中的表现,常被引用来证明它们能够内建物理世界认知。论文展示了模型隐藏层能预测游戏局面状态,但这种推理难以迁移到自然语言或日常生活的物理世界。游戏的规则完全是符号逻辑的产物,能用完全确定的符号序列描述,而人类日常行为和物理环境中充满连续性、不确定性和非显式规律,仅靠符号描述无法构建完全的理解。 更有甚者,研究揭示生成模型可能仅仅学习了一套复杂的启发式规则,来应付训练数据中的序列预测,而不是真正“知道”背后的因果机制。就拿先前提到的奥赛罗模型来说,其中部分预测规则并不适用于所有游戏情况,显示其学习到的仅是针对训练数据的局部模式而非通用的世界规律。换句话说,追求下一个符号预测的训练目标并不促使模型构建全面的世界认知,它更倾向于记忆抽象语法规则,而非深入理解语义与语境,这种表面上的流畅令人误认其具备真正智能。

从语言学角度分析,更能揭示大型语言模型的局限。语言学将语言能力划分为语法(句子结构)、语义(句子含义)和语用学(语境与交互)。人类能够组合出语法正确但毫无意义的句子,也可理解语法和语义都接受但在社交语境下不合理的话语,这说明三者各自独立但又紧密交织,共同构成人类复杂的语言理解。当前的语言模型在很大程度上只掌握了符号层面的语法规则,通过大量数据训练出来的统计规律,使得它们能够生成语法无误的句子,却缺乏对语义和语用的深刻把握,特别是缺乏与真实世界知识的有机结合。 如果没有直接的感知和行动经验,模型也许会尝试通过语法类别创新来绕过对世界的理解,比如为“冰箱”和“苹果”创造新的语法类别,以限定某些句子构成,从而避免明显的语义悖论。然而,这种做法不过是在语法层面对语义错误做出补丁,依赖海量自然语言数据中隐含的模式,并不能解答对世界本身的理解需求。

这种现象在认知科学中尤为重要。很多人以语言能力作为判断智能的标尺,却忽视了语言能力可能来自与认知智能本质不同的机制。人类语言能力背后是基于丰富世界经验、身体感知和社交互动的理解力,而大型语言模型不过是运用了符号操作和概率分布的高级变体。在这种意义上,语言模型可能更像是高度发达的“语法引擎”,而非拥有通用智能的主体。 斯顿(Rich Sutton)提出的“苦涩教训”(Bitter Lesson)为人工智能的结构设计指明了方向。他强调,规模化的计算资源常常胜过人为设计的先验结构,因为系统可以通过大量数据自主发现复杂规律。

然而,这一观点并非简单否定所有结构假设,而是提醒我们合理利用人类直觉和经验,以指导模型设计。卷积神经网络、注意力机制等架构正是建立在人类理解的基础上,因此尽管结构限制了某些适用场景,却大幅提升了模型表现。 在AGI领域,规模主义者希望凭借巨量数据和算力,通过构建多模态模型将语言、视觉、行动等不同模块拼接起来,构建整体智能。但这种做法忽视了各模态间的深度联系和交互本质。多模态整合往往是先对各个模态独立训练,然后将输出映射到统一的潜在空间,意图实现概念共享。但现实中,模态与模态之间存在多对多关系,例如一张图像可以有多重抽象层次的描述,同一命令也可以用不同动作完成,这使得简单的潜在空间映射难以捕捉复杂的跨模态语义。

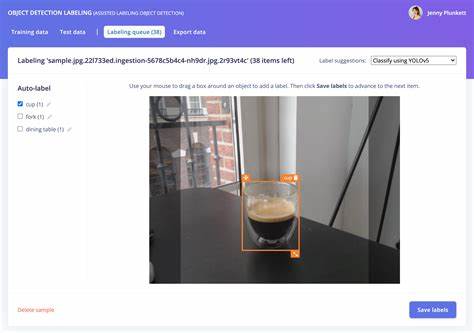

更核心的问题在于,目前对“模态”的划分本身可能并不适合构建真正智能的系统。人类的视觉、语言、行动虽是不同的表现,但在认知结构中高度融合,相互影响。将感知分割成图像和文本两条信息流,并分别处理,再在高层融合,存在割裂感,阻碍了智能的整体生成。如果我们想开发能真正理解和操作环境的AGI,或许应该试图模糊、甚至消除这些人为的模态边界,让系统在统一的认知框架上处理所有输入输出——无论是识别街头标志、理解人类语言,还是规划物理动作。 当前的多模态模型依赖于海量文本与视觉数据的结合,却缺少与物理世界直接交互的数据,这造成了数据资源的严重缺口。与儿童通过触觉、运动、社会学习不断建立世界认知不同,现有人工智能训练数据几乎都是人工筛选和标注的知识终端产品。

这种训练方式极大限制了模型灵活形成新概念和常识推理的能力。人类能够通过少量示例掌握全新概念,进行类比思考,而现有模型受限于训练语料,对未知领域表现出明显乏力。 因此,追求规模和多模态的极致拼接,虽在特定任务中可取代传统方法,但难以成就一个具备真正通用能力的智能体。未来的AGI路线应更加注重身体性与交互性,设计能够自然融合和生成多种感知与行动能力的模型体系。在这一过程中,如何科学配置和统一数据表示,如何让模型在物理世界中试错与学习,将成为关键课题。 回顾人工智能发展史,数学上的通用函数逼近理论已为智能函数的构建提供基础。

难点不在于数学构建,而在于如何合理安排和设计这些函数,以适应真实世界的复杂性。AGI的真正挑战是一系列概念性问题,包括知识表示、感知融合、动作生成以及持续学习等,而非单纯的算法规模或硬件算力问题。 展望未来,AGI研究者需要放下传统多模态模型对模块割裂的依赖,转向以环境互动和身体行为为核心的设计哲学。通过引入真实世界感知、物理交互与社交协作,使智能体能在复杂动态环境中自主形成和调整概念结构,展现多模态认知的自然融合,从而真正迈向具有普适能力和适应性的通用人工智能。 总结来看,单纯的多模态模型拼凑无法实现真正意义上的AGI。真正的通用人工智能必须以身体性和环境交互作为根基,模态之间的边界应当自然模糊甚至消失,实现认知能力的有机统一。

唯有如此,人工智能才能跳脱符号操作与统计学习的框架,达到人类智能那样丰富且灵活的认知高度。实现这一目标不仅是技术挑战,更是认知科学、哲学与工程的跨学科融合创新。未来的AGI时代,理应由更深刻理解智能本质的设计者来开拓新路。