随着人工智能技术的飞速发展,越来越多的活动和组织开始尝试借助AI工具优化传统繁琐的工作流程。2025年将在西雅图举办的世界科幻大会(Worldcon)也首次透露,筹备团队在筛选节目参与者的过程中,使用了大型语言模型(LLM)技术辅助在线资料的搜索和信息聚合。大会主席凯西·邦德于2025年4月30日发布了相关声明,正式回应社区对该做法可能带来的隐私、安全及伦理问题的关切。此举虽意在提高效率并减轻志愿者的负担,然而却在科幻作家和爱好者中引发了大量的质疑和激烈争论。大会声明明确指出,在使用LLM模型时,仅将申请者的姓名作为输入数据,目的在于自动化并汇总传统搜索过程中的信息,随后这些AI产出的结果都经过了多轮人工复核,确保准确无误。大会方面强调,没有任何申请者因仅凭AI搜索结果被拒绝参会,且该技术未被用于大会的其他环节。

然而,社区的反响显示,对于此举的担忧和不满远未平息。许多申请者表示不知情,甚至直言若提前得知将使用AI辅助审核,可能不会提交申请。部分作者严肃表达了对AI工具未经授权使用其文学作品进行训练的强烈反感,认为这是对创作者权益的侵害和对知识产权的挑战。同时,也有声音质疑LLM的搜索与判别能力,指出AI在处理同名异人、信息准确性以及潜在的算法偏见方面存在固有缺陷,可能导致错误审批和不公正对待。此外,AI运行所消耗的巨大计算资源与环境影响也成为批评焦点,特别是对于以未来科技和环保理念为主题的世界科幻大会而言,这样的选择显得格外矛盾和敏感。围绕此次事件,社区成员在公开评论中展开了丰富的讨论。

一部分支持者认为,合理、受控地使用LLM可以有效减少人力负担,集中人力在核心决策和复核环节,从而提升整体工作效率。但反对者则认为,这种“智能辅助”实质上是偷懒的表现,缺乏透明度和充分的事前沟通,且会加剧行业内部的信任危机。许多资深创作者呼吁大会重审此决定,甚至提出彻底废除AI参与审核的流程,转而依靠更传统且由社区成员直接参与的评价机制。另一焦点是数据隐私和法律合规性。有观点质疑单凭姓名输入而进行网络信息检索,可能涉及个人隐私泄露及GDPR等数据保护法规的潜在违规。更有人担心,AI所依据的训练数据来源于未经许可的网络爬取,涉及版权纠纷和伦理困境。

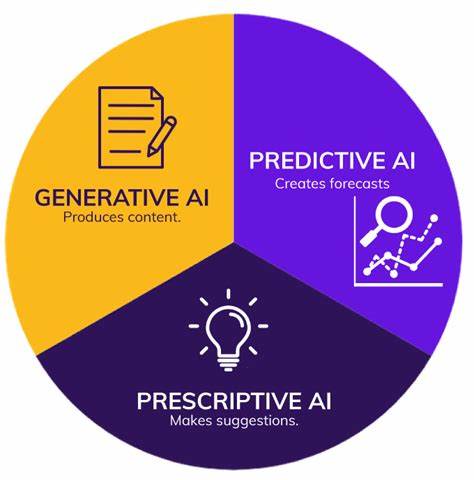

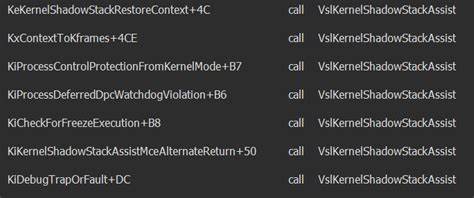

对此,大会声明称已有AI技术专家参与流程设计,确保隐私保护,但显然并未能消除公众疑虑。在技术层面,LLM本身的“幻觉”现象——即 AI 生成的虚假信息也引发担忧。尽管设有人工复核环节,但对成千上万的申请者进行细致审查需耗费大量时间和人力。社区普遍认为,若审核至少需要复核AI结果,便难以证明AI显著节省了时间,甚至可能带来效率低下的副作用。业内人士建议,科学地对比使用传统搜索与AI辅助方法的效果差异、准确率和资源消耗,做到充分验证后再决定采用。展望未来,世界科幻大会此次使用AI技术掀起的争议,为整个文艺界乃至更广泛的社会提供了关于人工智能合理应用的警钟和反思。

权衡技术创新与伦理保护,保障创作者权益和信息准确性,是任何组织在拥抱新工具时不可逾越的责任。同时,这也强调了技术透明度的重要性,特别是在涉及个人数据和职业认定的关键环节。网络时代的信息检索与人类判断两者之间,需要建立起更加协同与信任的关系,而非单纯依赖高科技“黑箱”判定。总而言之,2025年世界科幻大会因应用大型语言模型辅助节目参与者审核而引发的事件,是人工智能深度渗透社会活动的缩影。无论未来科技发展如何,重新审视人与机器的协作方式,尊重和回应社区诉求,将成为确保大型活动顺利且公正运行的核心课题。希望此次风波能促使相关组织吸取经验,改进流程,平衡效率与公平,为科幻文化的传承和发展铺设更稳固的人文基础。

。