随着人工智能技术的迅猛发展,如何实现高效、持久且去中心化的记忆存储成为业界关注的焦点。传统的AI系统依赖庞大的模型和海量的计算资源,而对记忆的管理和交换往往缺乏灵活性和效率。MemoryCore Lite作为一款开源的符号化点对点记忆系统,正是在此趋势下脱颖而出,成为轻量级AI记忆压缩与协同的创新尝试。MemoryCore Lite的核心优势在于其符号记忆压缩引擎。该引擎采用自定义的轻量级标记器,将文本数据高效编码为紧凑的符号字节码,显著缩减存储空间。这种压缩不仅保持了原始文本的语义完整性,而且支持完全可逆的解码过程,可将符号化记忆准确还原为可读文本。

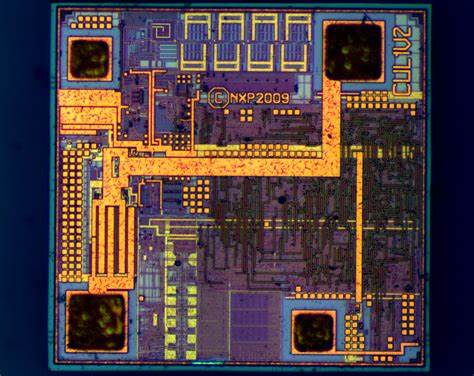

区别于传统的嵌入式向量表示,MemoryCore Lite保留了文本的符号结构,使得记忆的合并、去重和同步在多节点间具有天然的优势。其采用了预训练的SentencePiece模型,利用64k的词汇表实现了词汇级别的高效编码。该设计赋予MemoryCore极高的灵活性,能够适配从个人电脑、平板到嵌入式设备的多样硬件环境。MemoryCore Lite定位为辅助人工智能系统的记忆模块,支持离线知识存储和点对点网络同步。通过将知识以压缩的符号形式在节点间传播,极大降低了通信和存储的负担,使得即使在受限资源的边缘设备,如物联网终端、小型机器人或无人机上,也能实现持久且高效的记忆存储。此外,MemoryCore的设计理念契合未来去中心化AI生态的发展方向。

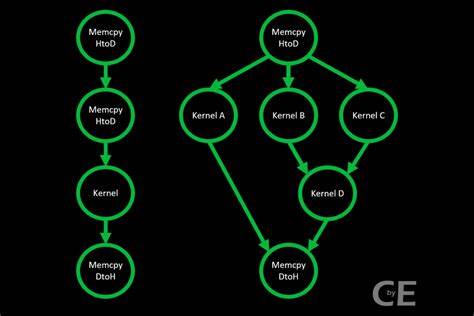

借助符号记忆的标准化和模块化,多个分布式智能体能够在无中心服务器的环境下共享和更新记忆,实现协同学习与认知。这不仅为构建智能体“蜂巢思维”奠定了基础,也推动了神经链(Neurochains)等分布式符号网络的探索。该项目以Apache 2.0开源许可发布,鼓励社区的贡献与创新。尽管当前代码库较为精简,仍包含核心的符号压缩算法、简化标记器、测试脚本及配套配置文件,便于开发者快速上手和二次开发。MemoryCore的出现为传统中心化、高资源需求的AI模型提供了新的思路。它不仅改善了AI系统的可扩展性和可携带性,也极大增强了对数据隐私和安全的保护能力,这对于依赖分布式计算和通信的未来智能网络尤为重要。

随着边缘计算和物联网设备数量的激增,MemoryCore的轻量级设计能有效缓解因数据量剧增带来的存储及带宽压力,为智能终端的自主学习和长期知识积累提供有力支持。同时,通过纯文本与符号字节码之间的无损转换,MemoryCore也兼具人类可读性,这为调试、审计和知识管理提供了便利。展望未来,MemoryCore有望结合更多先进的符号推理、知识图谱和联邦学习技术,构建更智能、更开放、更协作的人工智能记忆体系。人们可以设想分布在全球各地的AI设备,彼此协同共享复杂的符号化经验,实现超越单机算力限制的大规模智能整合。综上所述,MemoryCore Lite不仅是技术实现上的创新,更是人工智能记忆体系架构重塑的开端。其符号化的记忆压缩和点对点同步机制为轻量型设备带来了真正可行的认知存储方案。

随着开发者社区的不断参与和完善,MemoryCore有潜力引领去中心化AI系统走向成熟,真正实现人类与机器之间知识的无缝连接与共享。它标志着人工智能记忆的新时代,让我们期待在不远的将来,智能体能够通过轻盈且高效的符号记忆,共同构建开放、自主且智能的数字认知网络。