人工智能视觉技术在过去十年取得了令人瞩目的进展,特别是在图像分类和识别领域,卷积神经网络(CNN)成为主流。然而,尽管CNN在准确率上表现优异,其内部结构和工作机理却与人类视觉有着本质的不同。CNN通过权重共享机制,在整个空间中复制相同的特征检测器,这种工程上的“捷径”有效提升了学习效率,但也导致其缺乏生物大脑那种独特的空间组织和人类般的视觉偏好。近年来,德国奥斯纳布吕克认知科学研究所的Tim Kietzmann教授团队提出了一种创新的神经网络架构——全拓扑神经网络(All-Topographic Neural Networks,简称All-TNN),旨在让人工智能的视觉识别更接近人类的认知和感知方式。与传统的CNN不同,All-TNN取消了权重共享的设计,为网络中的每个空间位置分配独立的可学习参数。同时,为避免网络参数杂乱无章,研究团队引入了“平滑性约束”,促使相邻神经元学会相似但非完全相同的特征。

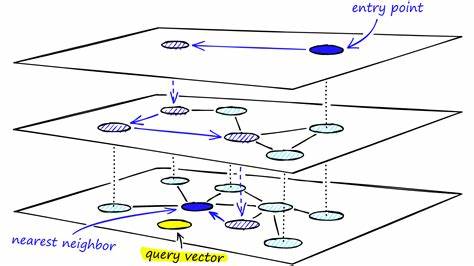

这一创新使得网络内部呈现出一种类似地形图的结构,神经元根据空间关系聚类排列,形态光滑且连续,恰似微观世界中的微生物群落。All-TNN的设计灵感来自于人脑的认知结构。人类视觉系统对空间信息敏感,具备明确的位置预期:例如飞机通常出现在画面的上方,鞋子则多位于下方地面。这种空间偏好被All-TNN成功捕捉,并在实验中表现出强烈的与人类视觉相似的识别行为。研究人员通过让30名参与者识别不同位置迅速闪现的物体,发现All-TNN在模拟人类空间识别偏好上,比CNN的相关度高出三倍,显示了其在接近人类视觉机制方面的显著优势。虽然All-TNN在图像分类的准确率上略逊于CNN,表现为34.5%至36%的识别率,对比CNN的43.2%,但其在能效性上则实现了巨大飞跃。

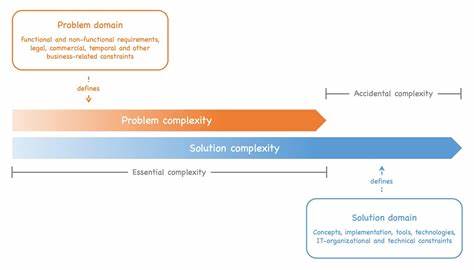

尽管参数规模是CNN的13倍,达到大约1.07亿个参数,All-TNN的能耗却远远低于CNN——后者运行时消耗的能源是前者的十倍以上。All-TNN的能效优势主要得益于其高效的空间聚焦机制,网络内部虽然拥有大量神经元,但只有其中一小部分会在特定任务中激活,从而避免了对整幅图像的均匀处理,极大降低了不必要的计算负担。这种结构不仅提供了更符合人脑处理逻辑的视觉模式,也为低功耗设备上的机器视觉应用带来了新的可能性。在移动设备、无人机和嵌入式视觉系统等对能源要求极为严格的场景中,All-TNN的高效能计算有望成为技术突破的关键。然而,研究团队更加看重的并非只是能效或分类准确率的提升,而是All-TNN为理解智能本质打开了新的视角。当前大规模深度学习模型往往通过增加参数数量和训练数据量来提升性能,这种“规模化”思路固然有效,但与人脑利用有限数据和极低能耗实现复杂认知的方式相去甚远。

Kietzmann教授指出,All-TNN所代表的基于人脑结构启发的新型网络架构,为人工智能提供了一种探索认知本质的替代路径,有望推动未来AI系统在效率和智能表现上的根本性变革。这也引发了学术界对智能起源的深入思考:是单纯通过盲目扩展模型规模获得能力,还是借鉴生物大脑的组织规律塑造更高效、更自然的智能?拓扑神经网络的研究成果无疑在此问题上给出了有力的证据。展望未来,拓扑神经网络不仅可以优化现有的机器视觉系统,还可能为多领域跨模态学习提供新的理论基础。例如,机器人感知环境时需要整合空间、形状和语义信息,All-TNN的空间组织优势有望提升机器人对复杂环境的理解与适应能力。医学影像分析领域同样可受益于此网络架构,提升疾病筛查的准确度和效率。总之,拓扑神经网络的出现,正引领人工智能视觉技术迈向更加人性化和高效化的方向。

凭借其独特的结构设计与训练机制,这种网络不仅打破了传统卷积神经网络的限制,还为理解和模拟人类视觉认知提供了崭新的思路。随着相关技术的不断完善和应用拓展,基于拓扑神经网络的智能系统有望成为未来人工智能发展的重要里程碑,推动智能机器更好地“看见”并理解这个复杂而丰富的世界。