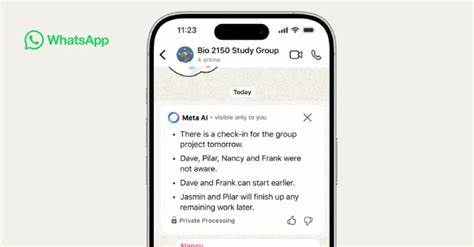

近年来,人工智能技术在各行各业的进步带来了前所未有的便利,特别是在社交和约会平台领域。Bumble,作为全球知名的交友软件,2023年12月引入了“AI开场白”(AI Icebreakers)功能,借助OpenAI的ChatGPT技术,为用户自动生成对话开场消息,旨在帮助用户更轻松地打破僵局,开启聊天。然而,这一看似便捷的功能却因其数据处理方式遭到了欧洲数据保护组织的严厉质疑,并被指出涉嫌违反欧盟通用数据保护条例(GDPR),引发广泛关注和法律争议。Bumble AI开场白功能如何成为争议焦点?核心问题在于该功能在未经用户明确同意的情况下,收集和传输其个人资料数据给OpenAI进行加工处理。根据相关报道,Bumble对用户展示了一个带有“接受”按钮的弹窗,表面上似乎是在征询同意,但实际上这一设计更像是对用户的“默许”引导,弹窗会不断出现,直到用户被迫点击“同意”为止。法律界专家和隐私权倡导者指出,这种“诱导同意”的行为本质上是误导性的,未能真正履行GDPR规定的自由、明确和知情同意的标准。

欧洲GDPR中的合法基础与同意问题《通用数据保护条例》作为全球最严格和影响力最大的隐私法规,明确规定了个人数据处理必须依赖合法基础。其中,用户的明确同意是最被重视的一种合法基础。企业若不能获得清晰且自愿的用户同意,则需证明其“合法利益”(legitimate interest)覆盖了数据处理活动。然而,Bumble选择以“合法利益”作为其处理AI开场白相关数据的法律依据,遭到了法律专家的反对。因为“合法利益”的合法性取决于是否能够保证数据主体的权利不被侵害。鉴于该功能涉及敏感数据,例如涉及性取向等隐私信息,该类数据根据GDPR第9条必须获得明确的同意才能处理。

Bumble没有取得此类明示同意,便将用户数据传递给第三方OpenAI,显然存在合规风险。 数据透明度不足与用户访问权利受阻 GDPR强调数据控制者在处理个人信息时的透明义务,用户享有访问、更正及删除个人数据的权利。根据投诉方的信息,Bumble未能充分向用户披露其数据处理具体内容,尤其是未明确告知传输给OpenAI这一重要步骤。且在用户依据GDPR第15条提出数据访问申请时,Bumble的回应内容不完整,未能完整提供相关处理的全部信息。此举不仅违反了欧盟法规中的透明原则,也限制了用户行使自身合法权益的可能。 隐私权的侵害与用户信任危机 AI技术在提升用户体验的同时,也伴随着对隐私保护的重大挑战。

Bumble强制推送AI开场白功能,缺乏选择权和充分告知,令用户陷入真正的“假同意”陷阱,感受到自身数据权利被轻视。专家Lisa Steinfeld强调,Bumble为了追逐AI技术的热潮,忽视了用户最基本的隐私权利,导致用户信任度下降,这对于依赖用户关系的社交平台来说无疑是致命的伤害。 监管行动与后续可能发展 目前,欧洲知名隐私组织noyb已向奥地利数据保护局(DSB)正式提交投诉,请求监管部门介入调查Bumble的违法行为,要求其停止未经合法法律依据的数据处理行为,完善用户同意程序,并对违规行为予以行政罚款。此案例预示着欧盟对人工智能与数据保护交汇点监管的严格态度,未来类似互联网企业在部署AI功能时,必须更加谨慎地遵守数据保护法规,尊重用户隐私权利。与此同时,随着大众和监管层对AI风险的关注日益提升,相关法律环境也将不断完善,促使技术创新与法律规范达到更好平衡。 结语:技术创新必须建立在尊重法律与用户权益基础之上Bumble AI开场白的争议凸显出当前互联网企业在追求技术创新的道路上容易忽视法律合规和用户隐私保护的普遍问题。

虽然AI技术能够极大提高服务效率与用户体验,但在数据处理过程中绝不可忽视用户的知情权和选择权。欧盟GDPR作为保护公民数据隐私的典范法规,在AI时代的执行力度必将持续加强。Bumble事件不仅是对单一企业的警示,更是对整个社交平台行业的提醒。只有尊重法律和用户权益,企业才能在激烈的市场竞争中赢得用户信任,实现可持续发展。未来,用户应更加关注自己在数字服务中的数据权利,监管机构和行业组织也需加强对AI应用的监督,确保技术创新与隐私保护同步推进,朝着更加安全、公平和透明的互联网环境迈进。