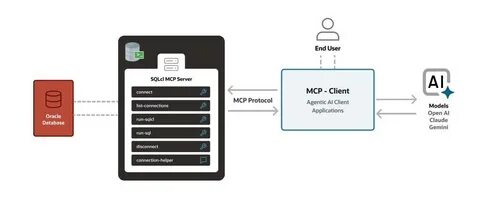

近年来,人工智能技术,尤其是大语言模型(LLMs)的迅猛发展,极大地改变了软件开发、数据处理和人机交互的格局。随着越来越多的厂商提供API接口与服务,基于LLM构建的软件即服务(SaaS)平台大量涌现,形成了用户通过SaaS访问LLM的典型架构。这种模式允许开发者快速集成先进的AI能力,简化了智能应用的开发流程,提升了用户体验。然而,随着市场的不断成熟和竞争的加剧,单纯依赖云端LLM的服务模式暴露出一些弊端,比如数据隐私安全、响应时效以及个性化定制的局限。正是在这样的背景下,订阅制的多方计算平台(MCP)服务器开始引起业界的热烈讨论和关注。MCP服务器本质上是一种能够在多方之间安全共享计算资源和数据的平台,结合了区块链、密码学和人工智能的先进技术,实现了在保证数据隐私的同时,充分发挥AI模型的计算与学习能力。

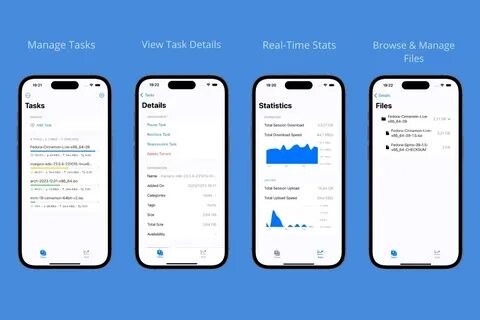

最近,有开发者推出了面向开发者的基于订阅的上下文即服务(CaaS)MCP服务器,每月收费约15美元,这不仅降低了使用门槛,也为广大开发者提供了个性化、细粒度的计算与数据管理能力。此类服务的出现促使人们重新审视软件服务的架构,从传统的“用户- SaaS- LLM”模型逐步过渡到“用户- LLM- CaaS”的新范式。这一变化意味着用户的请求首先由大型语言模型处理,然后再通过上下文即服务平台进行二次加工、定制和交互,极大拓展了AI应用的灵活性和深度。当前市场上已出现一些成功的CaaS提供商,他们的产品以高效、安全和极具针对性的上下文管理能力为卖点,满足了诸如软件开发辅助、智能客服定制、内容生成优化等多样化需求。从更广泛的角度看,MCP服务器的核心价值在于帮助用户与AI代理通过更安全可靠的通道进行互动。通过订阅模式,用户可以享受到不断更新、更加符合自身需求的智能服务,而服务提供商也能通过持续迭代和优化,形成良性循环和稳定收入来源。

这种双赢模式为整个AI生态注入了新活力。关于MCP服务器未来的发展,存在很多值得探讨的方向。首先,随着大模型功能的逐渐丰富,垂直领域和个性化服务将成为重点突破口。像Nia这样聚焦于软件开发者的上下文管理平台,如果其独特技术能有效提升代码生成、调试和协同效率,很可能被大型AI厂商纳入其智能助手产品线,形成更紧密的生态体系。其次,结合私有数据源的MCP服务展现出良好的中长期商业可持续性。企业在保证数据安全合规的前提下,利用定制的上下文平台辅助决策和创新,能明显提升核心竞争力。

此外,MCP服务器在教育领域的潜力同样巨大。通过整合间隔重复系统(SRS)与语言沉浸式学习,智能代理能根据学习者的实际掌握情况,动态调整教学内容的难度与方式,提供个性化且高效的语言学习体验。这种将人工智能与传统教学工具融合的尝试,标志着智能教育进入了一个新的阶段。尽管如此,订阅制MCP服务器模式也面临一些挑战,例如技术实现的复杂性、隐私保护的持续压力以及如何构建用户信任和生态系统。尤其是在处理敏感数据和跨域计算时,相关的法规和标准还在不断完善中,服务提供商需要保持高度的敏感性和适应能力。同时,市场竞争日益激烈,如何在功能及服务质量上实现差异化,赢得用户忠诚,是所有参与者必须认真考虑的问题。

总而言之,订阅制MCP服务器作为链接用户与AI智能代理的重要桥梁,正在逐渐成为人工智能产业链中的关键环节。它带来的架构创新和商业模式变革,有望让更多的开发者和用户享受到更安全、灵活且高效的智能化体验。随着技术的不断成熟和应用场景的拓展,未来的MCP服务器不仅将在软件开发、个性化学习、智能对话等领域发挥重要作用,还将推动AI生态迈向更加开放、互联和智能的新时代。