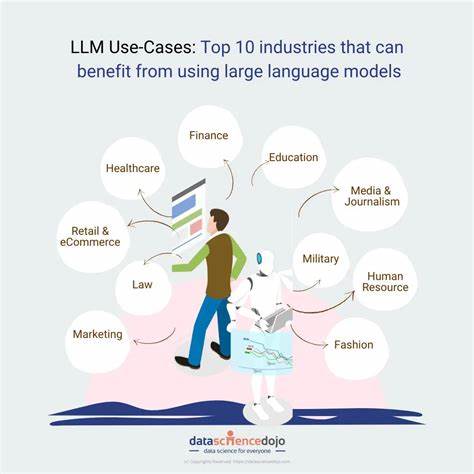

随着人工智能技术的迅速发展,大型语言模型(Large Language Models,简称LLM)在我们的日常生活中扮演着越来越重要的角色。这些模型不仅能够生成流畅自然的文本,还能够在无数应用场景中理解和回应用户的需求。然而,围绕着LLM与用户数据的关系,隐私保护、用户行为分析以及安全风险的讨论也日益激烈。本文将从多个角度解析大型语言模型对于其用户所“知道”的内容,揭示其中的信息机制以及潜在影响。 大型语言模型通过训练海量文本数据,学习语言结构和语义关系,从而具备生成和理解文本的能力。当用户与LLM进行交互时,模型通过输入的文本捕捉用户表达的意图、情感甚至偏好。

虽然模型并不具备传统意义上的意识,但其算法设计让它在处理大量上下文信息时能够“推断”用户的需求和背景信息,这种能力使得交互更加贴近人类自然沟通模式。 在实际应用中,LLM会根据用户输入的内容快速形成响应策略。比如在客户服务中,模型可以分析用户的语言风格以及历史对话内容,预测用户的需求并提供相关建议;在创意写作中,模型能理解用户所给出的题材和主题,并生成符合期待的文本。正是因为能够在对话中积累上下文信息,语言模型看似“理解”了用户的身份特征、兴趣偏好乃至可能的行为习惯。 不过,值得警惕的是,LLM对用户数据的处理并非完全透明。许多模型在用户交互过程中会临时暂存对话信息,用于生成更连贯的回答,这就意味着部分敏感信息可能会在算法内被运算和存储。

如果模型或使用平台未采取严格的数据保护措施,用户隐私面临泄露风险。此外,根据Bruce Schneier等安全专家的研究,LLM驱动的应用存在“Time-of-Check to Time-of-Use (TOCTOU)”漏洞,这类漏洞能被恶意利用改变输入数据与实际使用数据之间的状态,带来潜在安全隐患。 此外,间接的数据收集功能也让LLM有能力从用户交互的字里行间提取更多信息。例如语言习惯、关键词频率、表达情绪等,都可能成为模型评估用户画像的依据。当LLM整合到更复杂的系统中,如智能助理或推荐算法,其“对用户的认知”得以深化,从而影响内容推送、广告定制甚至决策支持。这意味着,用户的一言一行都可能被算法模型纳入评估范畴,从数据隐私角度看,这种情况催生了更为严峻的伦理与监管挑战。

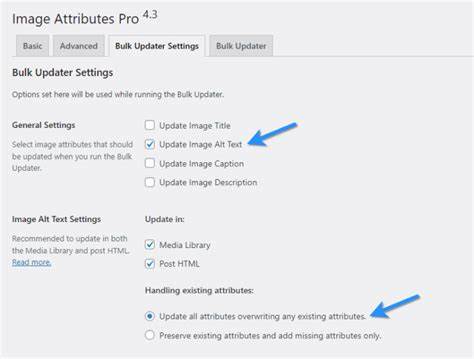

围绕用户数据的保护,业界不断推进技术创新和安全规范制定。例如,采用差分隐私技术保护用户输入数据、通过端对端加密保障数据传输安全、引入严格访问控制机制限制数据调用等,这些措施极大提升了数据安全的水准。此外,研究人员还在探索更加透明和可解释的模型设计,使得用户能够更清晰地了解其数据如何被使用,同时有权选择参与程度。 大型语言模型渗透至个人和商业领域的同时时代背景下,用户认知也逐渐觉醒。公众正日益关注自身数据在AI系统中被采集和分析的方式,要求企业与研究机构贯彻开放透明的原则。许多国家和地区纷纷出台相应的数据保护法律,如欧盟的《通用数据保护条例》(GDPR) 和中国的《个人信息保护法》(PIPL),以保障个人信息安全权利。

这些法律不仅为LLM应用指明了合规路径,也促使开发者在设计系统时更加重视用户隐私。 从技术层面看,提升LLM对用户信息管理能力的关键在于优化数据处理架构。一方面需要确保模型训练和推理过程对敏感信息的隔离,防止模型无意间记忆或泄露私人数据;另一方面,增强模型对输入信息的动态权重分配能力,使其能更精准地判断哪些信息是关键并加以保护。此外,结合多模态数据分析,未来的LLM不仅能理解文本,还可融合图像、语音等多源信息,形成更全面的用户画像,同时挑战也随之加大,例如如何保障多模态数据中的跨类型隐私安全。 值得注意的是,LLM的持续学习和自我优化往往依赖于高质量的数据反馈,这也为数据收集机制提出了更严格的要求。合理设计反馈环节,确保数据在采集、传输、存储和使用各环节符合隐私和合规标准,已成为构建可信赖AI系统的前提。

未来,依托联邦学习等新兴技术,模型能够在本地处理用户数据,仅上传经过加密和脱敏处理的参数,从根源上降低隐私泄露风险。 无论是技术研发者、产品设计者,还是终端用户,都面临如何平衡数据价值和隐私保护的共同课题。对于用户而言,增强对LLM应用场景的认知和掌控权,有助于合理使用相关服务,避免不必要的信息暴露;而对于企业和机构,建立以用户为中心的数据伦理观念,积极响应政策法规,采取有效的安全防护措施,是赢得用户信任和支持的关键。 综合来看,大型语言模型在“了解”用户方面展现出强大能力,但这一能力的发挥既带来了便利与创新,也引发重大安全和伦理问题。技术层面的进步必须与法律和社会规范紧密结合,才能最大限度保障用户数据安全,推动技术健康发展。同时,用户自身也应不断提升信息安全意识,理性评估并选择合适的智能产品与服务,共同营造安全可控的数字生态环境。

未来,随着人工智能技术的日益成熟,LLM对用户的理解将进一步深化,如何在尊重隐私与释放数据潜力间取得平衡,仍是业界和社会必须长期探讨的核心议题。