近年来,人工智能在各个领域的深度应用成为科技发展的重要方向,尤其是在可穿戴设备领域,智能眼镜的崛起引发了行业内外的广泛关注。Brilliant Labs作为开源智能穿戴设备的先驱,与Liquid AI这家诞生于麻省理工学院的高效基础模型领导者展开深度合作,共同将视觉和语言结合的先进技术注入智能眼镜产品,推动智能计算从设备端实现更快、更可靠及更私密的用户体验。此次合作的核心在于Liquid AI独创的轻量级视觉语言基础模型(Liquid Foundation Models,简称LFM),这套模型充分体现了高性能与低能耗的完美平衡,使得强大的AI智能能够实时运行于资源有限的硬件平台。作为这次技术革新的重点,Brilliant Labs即将推出的Halo系列AI智能眼镜,成为融合Liquid AI技术的首批产品,具备强大的场景认知和环境理解能力。通过集成Liquid的LFM2-VL-450M视觉语言模型,Halo眼镜能够高精度、即时地对摄像头捕捉的图像进行分析,生成详细且富有创意的图文描述,从而支持实时对话与交互,极大提升用户在日常生活与工作中的智能体验。Liquid AI的联合创始人兼CEO Ramin Hasani指出,他们致力于在有限计算资源下构建高效、可靠且隐私保护的生成式人工智能技术,令用户能够在任何设备上实现前所未有的智能应用。

他对智能眼镜作为未来人机交互重要形式充满信心,认为其将引领超个性化的智能交互新时代。Brilliant Labs的CEO Bobak Tavangar则强调,未来的计算必须遵循开放、私密及个性化的原则,这也是他们选择与Liquid AI合作的重要原因。Halo眼镜的设计不仅重视功能的先进性,更是全开放源代码平台,鼓励全球开发者和创新者基于这一平台深入探索AI智能在现实应用中的无限可能。Halo智能眼镜具备多项首创功能,包括AI记忆、实时对话AI以及独特的Vibe模式,这些功能均基于Liquid AI的视觉语言基础模型实现,赋予设备强大且灵活的智能能力。特别是在图像与文本的多模态处理方面,LFM2-VL系列模型支持多种分辨率输入,且仅包含8600万个参数,是业内极其轻量且高效的模型之一。其350百万参数的基模型为基础,确保了模型的分析能力与响应速度,并实现了在CPU及GPU上的毫秒级延迟表现,充分满足智能眼镜的实时性能需求。

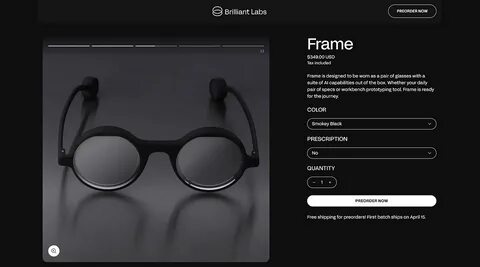

随着Halo系列智能眼镜进入预售阶段,售价定为299美元,预计将在今年第四季度开始发货。市场对于集成先进视觉语言技术的智能眼镜期待值甚高,这不仅体现了用户对便捷智能生活的追求,也显示了人工智能技术与硬件深度融合的发展趋势。波及的应用场景涵盖了助力残疾人士视力辅助、户外导航、企业远程协作、健康监测乃至娱乐互动等多方面,让智能眼镜成为真正意义上的"眼见为智"的智慧终端设备。未来,随着Brilliant Labs与Liquid AI进一步深化合作,视觉语言基础模型的迭代升级将带来更多创新功能,使智能眼镜在用户体验上实现更大突破。同时,这种开放且注重个人隐私的架构设计,有助于保障用户数据安全,消除使用人工智能设备时的顾虑。智能眼镜的崛起标志着人工智能从传统的桌面及移动端应用,正逐步向更接近人体感知的场景渗透。

Brilliant Labs与Liquid AI的联合创新,是可穿戴AI设备发展史上的重要里程碑,为行业树立了融合高效AI模型与硬件的典范。展望未来,随着基础模型技术的不断成熟和成本优化,更多消费者将享受到智能眼镜带来的便利和智慧生活。科技与人类的互动界面将更加自然、顺畅,人与AI的边界将日益模糊,开创极致个性化、无缝连接的智能时代。在这一趋势之下,Brilliant Labs凭借其开放源代码及社区驱动模式,正成为全球开发者推进智能眼镜创新的核心平台。Liquid AI的高性能基础模型则为其注入强大动力,推动硬件与人工智能深度集成,解决了计算资源受限与隐私保护的双重难题。总结来看,Brilliant Labs与Liquid AI的合作不仅是一场技术层面的突破,更是智能穿戴设备向更人性化、更智能、更安全方向发展的关键节点。

随着智能眼镜功能的不断丰富和应用生态的完善,未来的智能眼镜将真正成为个人信息处理与环境感知的超级助手,改变人们的工作、学习与生活方式,引领智能科技进入更加广阔的应用蓝海。 。