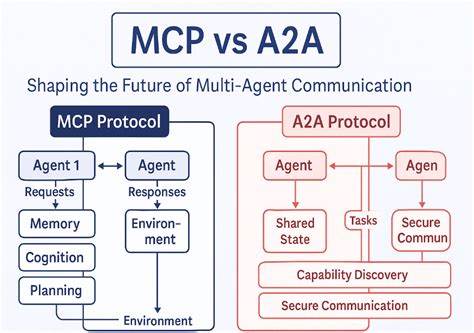

随着人工智能技术的迅猛发展,模型上下文协议(Model Context Protocols,简称MCP)应运而生,成为连接大型语言模型(LLM)与各种实时工具的重要桥梁。MCP让LLM不仅能进行文本生成和理解,更能直接调用外部系统,实现数据查询、任务执行等多样功能。然而,尽管MCP的愿景宏大且吸引了众多开发者投入试水,现实中的MCP代理应用往往表现平平,难以达到预期效果。究其原因,本文将深度探讨MCP智能代理的常见短板,分析失败模式,并借鉴行业内成功经验,为构建高质量、高回报率的MCP整合方案提供切实可行的指导。 首先,MCP代理的核心挑战来源于对“连接”与“智能”概念的错解。很多早期实现仅仅是把庞大的API目录直接输入模型上下文窗口,试图让模型借助原始数据实现各种操作,但事实表明这远远不够。

简单的接口连接并不等同于真正的智能协作,缺乏有效规划和上下文管理的代理往往导致迟滞、冗长且易出错。例如,将完整的50条工单列表通过接口一次性调用,不仅消耗巨量的token,还极易造成模型因上下文过载而失去准确性。这种模式显然忽视了对信息规模和复杂度的控制。 进一步分析,MCP代理的设计缺陷主要体现在几个方面。首先是过度传输导致的“token爆炸”,即将大量冗余信息无选择地塞入模型上下文,令其处理负担剧增。接着是多次重复调用接口且拼凑数据时造成的上下文混乱与信息碎片化,使模型难以形成完整、连贯的推理路径。

此外,许多代理将原本可在本地处理的数据格式转换任务强行交给模型执行,反而加剧了上下文复杂度和计算资源浪费。著名云服务商Google官方教程也特别强调,必须仅传递必要的上下文信息,避免信息冗余。 针对上述问题,行业内积累了丰富且切实可行的解决方案。首先,强制设定每次调用的token限制,合理缩减单次请求带回的信息量,使模型能在有限上下文内高效决策。第二,在模型调用接口前,引入token预估机制,允许智能代理预先对单次请求代价进行评估,从而动态调整调用策略与数据规整方式。第三,将需要反复访问的大批量数据统一缓存在服务器端,仅暴露压缩和结构化后的关键信息,避免频繁请求完整数据。

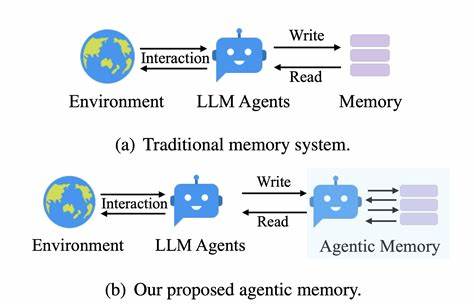

第四,合理利用本地代码执行环境(例如Python中的Pandas库)完成数据转换和复杂计算,腾出模型上下文资源专注于推理和高级决策。 真正走出困境的MCP设计理念,是从单纯的“接口调用”转向“智能规划者”模式。意思是,代理不仅是信息的搬运工,更是高阶的“数据筛选者”和“任务规划者”。通过分层设计,优先检索和加工高价值信息,同时在上下文中保持表征简洁且富含意义的变量,将为模型推理提供极大便利。AutonomyAI作为业界先锋,提出了创新性的TripleR框架,涵盖数据检索(Retrieval)、信息表征(Representation)及输出复用(Reuse)三大核心原则。该框架强调从源头抓取合适数据,转换成模型容易理解且精炼的形式,并确保模型面对重复请求时保持响应一致性,显著提升了代理的稳定性与效率。

具体来说,Retrieval阶段着眼于精准拉取真正相关且必要的数据,避免海量无关信息泛滥;Representation阶段将复杂的原始数据压缩成可操作的小而美格式,比如采用紧凑的ID映射或CSV结构代替原始JSON,以显著减少上下文占用;Reuse阶段强调缓存和结果验证,让模型能够利用历史输入和输出组合避免重复无效推理,减少延迟与成本。通过这三步循环,MCP代理能够不仅解决上下文爆炸和接口碎片化,更强化了长期记忆与多轮交互能力,以适配复杂业务场景需求。 除此之外,API调用逻辑的本地化和上下文持久化也是提升代理性能的关键。将数据处理迁移到本地环境,减少模型大量扫描和重组数据的负担,能够大幅降低token消耗和响应延迟。同时上下文持久化技术保障多轮问答中信息的有效继承,避免每次交互都重新调用所有接口,从而提升整体对话质量和用户体验。简言之,高级MCP代理应在“智能做减法”和“合理分工”上下功夫,从根本上设计以终端用户需求和性能目标驱动的定制策略,而非盲目追求“完整暴露所有工具”。

展望未来,MCP作为新一代AI工具集成的技术框架,其潜力依然巨大。关键是在于放弃早期简单粗暴的一体化思维,转向模块化、可控性强且具备规划智能的设计路径。只有将模型视为协作的“核心大脑”,配合精心设计的数据获取层和本地执行层,才能真正释放LLM在复杂环境中持续、准确决策的能力。此外,随着行业对token预算、调用延迟、响应稳定性等指标要求越来越高,采用科学的监控和调优机制亦成为成功的前提。 总结来看,当前MCP智能代理表现平庸的主要原因在于缺乏有效的上下文管理和智能规划,过度依赖庞大且碎片化的API信息,导致性能低下和体验欠佳。关键的改进方向包括控制token预算、实现接口调用预估、优化数据格式和传输、推动本地数据处理、强化上下文持久化及多轮交互管理。

通过这些方法,结合AutonomyAI的TripleR框架核心思想,可以打造真正具备“智能代理”特质的MCP系统,实现工具与LLM的无缝协同,广泛应用于客户服务、项目管理、内容创作等多样场景,显著提升效率与ROI。对于希望借助AI赋能业务自动化的企业和开发者而言,理解并实施这些原则无疑是实现落地成功的关键路径。未来,随着技术演进和生态完善,MCP智能代理必将成为连接AI与现实世界的桥梁,赋能更多创新应用和商业价值。