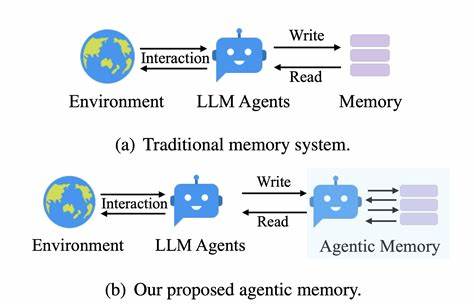

随着大语言模型(LLM)技术的迅猛发展,多智能体系统的协同工作成为实现更复杂任务的重要方向。传统上,智能体之间数据交互依赖于多层控制器或复杂的聊天结构,造成效率低下且实现复杂。MemX作为一款专为多智能体设计的实时共享内存解决方案,无需聊天机制和控制器,突破了传统限制,极大地简化了多智能体系统实现的复杂度。MemX提供了一个基于键值对的实时共享存储,多个LLM智能体能够直接访问并更新共享数据,实现真正的无缝协作。它采用的Pub/Sub机制确保各智能体能及时感知状态变化,从而动态调整行为。对于数据结构,MemX支持JSON模式化管理,保证输入输出均符合预定格式,提升了数据一致性与安全性,同时借助API密钥控制访问权限,确保多方协作环境中的数据安全。

开发者只需通过简单的SDK安装和初始化,便能开始构建多智能体共享记忆的应用。安装pip install memx_sdk后,通过API密钥登录,即可设置数据模式,读取及写入共享数据。示例代码简洁明了,帮助快速上手。MemX的应用范围广泛。首先,它极大地推动了自主研究智能体的发展,研究智能体可以借助共享内存同步各自的实现思路与进展,相互补充提升。其次,在LangGraph和CrewAI等项目中,MemX作为记忆插件,支持长期知识积累与处理,显著增强LLM工作流中状态的持久化功能。

此外,开发者能在实际业务场景中构建多智能体协同解决方案,无需开发复杂的通信协议,降低工程难度的同时提升系统的鲁棒性和扩展性。MemX作为开源项目采用MIT许可证,意味着开发者能够自由修改和部署,满足不同的创新需求。随着AI领域对动态、持续交互的诉求不断增强,MemX无疑成为推动未来多智能体协同工作的关键工具之一。借助其灵活的共享内存结构,智能体间的信息壁垒被打破,协作过程更加高效自然。总结来看,MemX不仅提供了技术层面的革新,更为多智能体大语言模型的实际应用打开了新的大门,实现真正的实时、统一、高效数据共享。对开发者而言,MemX带来了极具吸引力的快速入门方案和稳定的使用体验,在提升研发效率和系统性能方面价值显著。

随着更多开发者和企业开始采用这套工具,未来多智能体LLM系统的协作效率和智能水平有望实现质的飞跃,助力人工智能的广泛落地和创新发展。