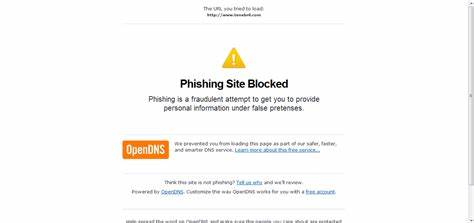

人工智能技术的发展正以前所未有的速度改变着全球数字化进程,AI聊天机器人作为其中重要的一环,凭借高效的交互体验和强大的自动化能力,成为众多企业和用户的首选。然而,近期关于某AI聊天机器人“Natasha”及其背后开发团队的传闻引发了广泛关注和讨论。据媒体报道,原本标榜由AI自主编程完成的聊天机器人项目,实际上有700名印度程序员在幕后执行编程任务,这一揭露不仅挑战了AI技术的纯粹性,也暴露了行业中的一些潜规则。该事件源自总部位于伦敦的初创公司Builder.ai,该公司曾被估值15亿美元,但因涉嫌造假交易及夸大收入预测,最终于2025年宣告破产。根据报道,Builder.ai涉及与印度社交媒体公司VerSe Innovation之间的“资金回流”操作,通过两家公司开具相似金额的账单,虚增销售收入。这种“资金回流”策略被业内视为伪造业绩的典型手段,导致投资者资金受损,监管机构展开了深度调查。

Builder.ai的AI项目Natasha被揭露成了“空壳”,所谓能够自行开发移动应用的AI系统,实际上并未履行预期功能,开发工作均由7百名印度承包程序员完成。这一事实令业内人士质疑AI自动化承诺的真实性,也凸显了企业在技术包装上的欺诈行为。早在2019年,《华尔街日报》就曾质疑Engineer.ai——Builder.ai母公司旗下品牌,是否真的能实现基于AI自动生成应用程序的梦想。随着时间推移,行业内关于该项目真实执行情况的疑云反复被提出,而这次披露则从另外一层面验证了此前的怀疑。对于投资者和消费者而言,这一事件带来的冲击不容小觑。投资界知名机构如微软和卡塔尔投资局曾是Builder.ai的重要投资方,此次事件让业界对初创科技企业的尽职调查提出了更高要求。

消费者也感受到技术期望与实际体验间的落差,对AI的信任度受到严重影响。与此同时,这起事件也反映出人工智能技术发展中存在的道德与监管难题。技术本应为社会带来便利及进步,但当背后操作不透明且以欺诈为手段,最终受损的是整个行业的公信力。如何建立更加完善的监督机制与行业规范,是目前亟待解决的课题。印度程序员在这次事件中扮演的角色也值得深思。虽然他们承担了大量开发工作,但缺乏透明度和正式的技术认知,导致他们成为被利用的“隐形劳动力”。

这揭示了全球科技产业链中存在的分工与价值认定问题。对比起真正由AI自主生成代码,实时编程人员的介入意味着技术尚未达到完全智能化的水平,业界需要调整预期,平衡技术乐观主义与实际可能性。同时,投资界和监管层面对AI企业的评估标准应更加严谨,避免因过度宣传和虚假数据诱导盲目投资,促进行业健康发展。总的来说,关于印度程序员参与发展的AI聊天机器人事件,不仅是一则商业丑闻,更牵动了技术信任、行业监管和劳工权益多重议题,成为AI历史发展的一个警示标杆。面对未来,科技企业应秉持诚信原则,推动技术创新真正惠及社会,同时公众与监管机构也应加强对AI项目的审核与监督,才能构建一个更加透明、可信赖的人工智能生态环境。