随着人工智能技术的飞速发展,超级智能的理念逐渐成为科技界和社会各界热议的话题。超级智能指的是超越人类智能水平的人工智能系统,这种智能不仅能够完成复杂的任务,还可能在创新、判断和策略制定等方面超过人类。OpenAI作为行业领导者之一,近日发布了最新的o3-Pro模型,该模型不仅提升了性能,还大幅降低了成本,使得超级智能的门槛逐渐变得可及。然而,超级智能的发展带来的不仅是机遇,还有深刻的挑战和复杂的社会影响。 首先,从技术角度观察,OpenAI通过优化推理堆栈,将ChatGPT Pro和Teams订阅者的查询能耗大幅削减。最新数据显示,每次查询平均使用的电能约为0.34瓦时,水资源消耗也非常低,这意味着单次查询的能源成本极其微小。

这样的进步为推广人工智能应用奠定了良好的基础,使得“智能化”操作的成本更低、更环保。然而,这一数据并不能掩盖人工智能总体能耗的巨大规模。根据劳伦斯伯克利国家实验室的研究,预计到2028年,专用于AI的数据中心能耗将达到165到326太瓦时,这相当于美国22%的家庭用电量,足见其对全球能源环境的重大影响。 这一矛盾体现了技术优化与使用规模扩大之间的张力。虽然单次查询能源消耗降低,但由于用户数量爆炸式增长,整体能源需求依旧居高不下。环保与可持续发展成为人工智能行业必须直面的现实问题,也促使企业和研究机构加快探索更高效、更绿色的计算技术。

同时,巨大的能耗引发了社会对于AI的使用边界和资源分配的思考。 除了能耗问题,超级智能的社会伦理和安全风险也是公众关注的重点。OpenAI首席执行官萨姆·奥特曼乐观地展望了2030年代的未来,认为智能与能源将变得极度丰富,从而打破人类进步的瓶颈,带来高能物理、材料科学和脑机接口等领域的突破,实现太空殖民等宏大目标。然而,这种乐观展望也存在一定争议。不少专家指出,现实中的限制远不止智能和能源,还包括认知心理、社会政治、经济资源、技术科学、生态环境、文化伦理乃至时间和物理规律等多重复杂因素。超级智能能否真正突破这些重重桎梏,仍充满变数。

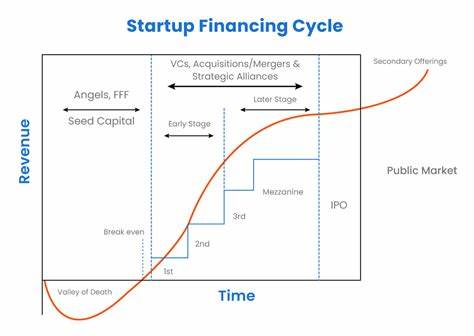

公共和技术层面对超级智能的监管和安全机制亟需建设。奥特曼强调技术和社会层面的安全性问题,并呼吁广泛分发超级智能,妥善应对其经济影响。放眼全球,随着大型科技公司加速AI布局和云服务整合,诸如OpenAI与谷歌云合作等动态日益频繁,行业竞争及合作态势逐渐明朗。与此同时,监管机构、学界和社会团体对AI潜在滥用和失控风险的担忧也在升温。风险管理、隐私保护、伦理规范和治理体系成为不可回避的议题。 在商业领域,人工智能技术正在重塑各行业的运营模式。

价格大幅下降使得AI应用更易被中小企业接受,从而推动自动化水平和服务效率的提升。同时,AI的新模型在语音合成、地理空间分析和内容生成等领域取得显著进步,带动云计算平台和开发工具生态的快速繁荣。值得注意的是,伴随AIl渗透,工作岗位的结构性变革也愈加显著,许多岗位组合了人机协作,而不是简单的替代。 然而,同样伴随着技术红利的,是社会上的焦虑与不确定。人们担忧AI导致的就业压力、决策透明度和潜在偏见,影响社会公正及文化多样性。同时,超级智能的自主性挑战当前的法律体系和道德观念,呼唤跨学科的深入研讨和全球共识。

未来超级智能的形态和应用模式,将深刻影响每一个人的生活。 总之,超级智能不仅是技术进步的象征,也是一场关乎人类文明走向的深刻变革。它融合了前沿科学、能源革命、经济转型与社会治理等多重维度,引发反思与探索。科技乐观主义需要与现实谨慎并行,理性评估可能性和风险。通过科学创新与开放透明的治理,聚合全球智慧,超级智能有望成为推动人类社会跨越新时代的关键力量。面对挑战,人类需要共建信任、加强安全监管并注重伦理考量,以实现智能时代的可持续发展和普惠价值。

未来已来,超级智能正书写新篇章,而走向何方,则取决于我们如何塑造和驾驭这场伟大变革。