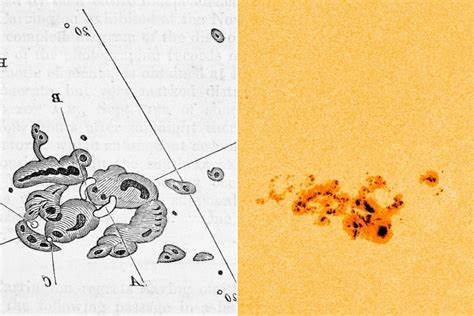

随着人工智能技术的不断进步,智能手机的拍照功能得到了飞速提升。谷歌Pixel系列手机依托其强大的AI算法,开启了图像智能放大的新时代,不仅让低分辨率的照片得以细节复原,还提升了整体画质。然而,最近用户和技术观察者们发现了一种奇特现象 - - 在AI智能放大后的照片中,系统竟"幻觉"出不存在的鸟类元素,引发广泛关注和讨论。 这一现象的出现,究其根本,源自于AI算法在图像重建过程中的推断机制。AI智能放大通常依赖深度学习神经网络,训练时模型通过大量带有真实细节的图像数据学习如何填补低分辨率中的缺失细节。当面对模糊或不完整的信息时,模型会基于所学的模式进行推断,并生成缺失部分的图像细节。

换言之,AI实际上是在"猜测"最合理的细节以完善图像表现。 然而,这种"猜测"并非总是准确无误。谷歌Pixel的AI模型在面对某些复杂纹理和背景时,极易将模糊区域错误识别为有规则的形状,特别是自然环境下的枝叶、云朵或其他诡异的图案,有时会被AI解读成鸟的形态。这就产生了所谓的"鸟类幻觉",即照片中显示出了实际并不存在的鸟类轮廓或形象。 技术层面上,这与AI图像处理中的"幻觉生成"现象类似,正如生成式对抗网络(GAN)有时会产生看似真实但实际上虚假的图像细节。谷歌Pixel的AI智能放大算法虽然经过了大量优化,但在极端或复杂场景下依旧难以完全避免错误推断。

尤其是动态环境、光影交错和细节丢失较多的照片,更容易引发这种图像"幻觉"。 从用户体验的角度看,这一现象带来了双刃剑效应。一方面,智能放大技术让普通用户无需专业设备也能捕捉到清晰细腻的画面,极大提升了手机摄影的便利性和美感。另一方面,假细节的生成可能导致照片失真、信息误导,影响用户对真实场景的认知,尤其是专业摄影师和图像内容鉴别领域更为敏感。此外,对于新闻摄影、法务取证等需要保证真实性的场景,AI智能放大产生的图像偏差可能引发严重的问题。 谷歌方面已注意到此类现象并持续优化其算法。

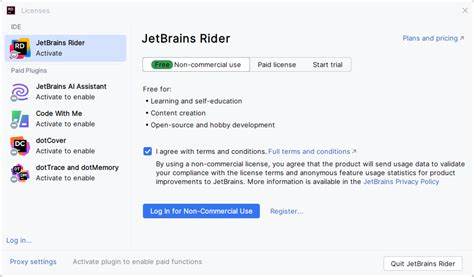

通过引入更精细的训练数据、更严谨的推断机制,以及结合用户反馈调整模型参数,力求减少误判和虚假细节的产生。同时,谷歌鼓励用户在发布重要照片时保留原始图像,避免对AI放大图像的无限制依赖,从而保障影像的真实性和使用价值。 未来,随着深度学习技术的不断完善和算力的提升,AI智能放大技术将变得更加精准和可靠。先进的图像理解模型将更准确分辨图像中的真实细节与噪声,避免"幻觉"级别的错误生成。此外,多模态学习和实时反馈机制的引入也将增强AI系统的自我校正能力,降低图像处理中的偏差。 然而,AI技术天然带有一定的"不确定性",在某些极端或极其复杂的环境中,总会有不可避免的错误出现。

这要求开发者、厂商以及用户共同建立科学合理的期待和使用规范,避免对AI技术的盲目信赖。深刻理解AI智能放大背后的原理和局限,有助于我们更理性地看待这一革命性技术,既欣赏其带来的便利,也谨慎处理可能的误差。 综上所述,谷歌Pixel采用的AI智能放大技术无疑为手机摄影带来了技术革新,但"鸟类幻觉"等现象提醒我们,当前的AI图像处理仍存在潜在风险和局限。未来通过技术迭代和规范引导,这一技术定能更加成熟,实现既清晰又真实的影像呈现。科技的发展带给我们的不仅是惊喜,更是对真相和美学的全新追求。 。