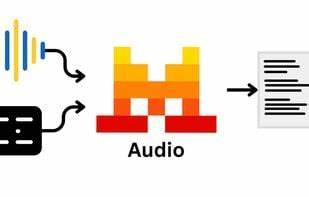

语音是人类最早的交流方式,远在文字和打字之前,声音就已经承担着分享思想、协作工作以及建立关系的重要作用。随着数字系统和人工智能技术的不断进步,语音正在重新成为人与计算机交互最自然的形式。然而,现有的语音识别和理解系统仍存在诸多限制,不仅准确率难以满足实际需求,还常常因专有技术导致灵活性不足、成本偏高。为了弥补这一缺口,Mistral AI 推出了开源的 Voxtral 语音理解模型,以期为各类应用场景提供高效、开放且可靠的语音智能方案。 Voxtral 模型分为两种规格,分别是适合大规模生产应用的 24B 版本和适合本地及边缘部署的 3B 版本。两者均基于 Apache 2.0 开源协议发布,同时通过 API 提供服务。

Voxtral Mini Transcribe 是针对转录任务优化的小型版本,凭借极具竞争力的成本和延迟优势,为客户提供超高性价比的语音转录体验。 技术层面上,Voxtral 不仅满足基本的语音转录需求,更超越了传统自动语音识别(ASR)系统,具备深度语义理解能力,支持长达三十分钟的音频转录及理解,拥有 32k 令牌的上下文处理能力,能够高效应对长篇语音数据。此能力毫无疑问地提升了复杂场景下的语音交互体验。 除了准确率,模型多语言能力是 Voxtral 的另一大亮点。它支持包括英语、西班牙语、法语、葡萄牙语、印地语、德语、荷兰语、意大利语等多种主流语言,自动识别语种并切换处理,帮助企业无缝触达全球客户。多语言及多文化环境中对语音智能的需求日益增长,Voxtral 的跨语言表现无疑赋能了全球化业务的落地和扩展。

在语义层面,Voxtral 支持内置的问答和摘要功能。无需通过分开调用语音识别和语言理解模型,用户即可直接从语音内容中提问或获取结构化摘要。这种一体化设计不仅提升了响应速度,还简化了开发流程。更为创新的是,模型能够根据用户的语音意图直接调用后端功能或触发工作流,使语音交互真正落地成可执行的系统命令,极大拓展了语音智能的应用边界。 质量和性能方面,Voxtral 在多个权威基准测试中表现优异。它大幅超过当前领先的开源模型 Whisper large-v3,超越了许多商业闭源系统如 ElevenLabs Scribe,展现了卓越的短时及长时语音转录能力,并在多语言任务中表现出一致的领先优势。

举例来说,在英语短时语音转录和 Mozilla Common Voice 多语言任务中均获得行业前列水平,其细粒度表现进一步验证了模型的强大实力。 在语音理解领域,Voxtral 小型号与 GPT-4o-mini 和 Gemini 2.5 Flash 等先进模型不相伯仲,特别是在语音翻译任务上实现了业界领先水平。通过自有的音频理解测试集及挑战性问题解答测试,Voxtral 展示了其从语音中深度提取信息并完成文本理解任务的能力,为智能助理、会议纪要和内容分析等应用提供了可靠保障。 从使用便捷性角度看,Voxtral 提供了多种集成途径。用户可直接从 Hugging Face 平台下载全部模型,在本地或云端部署,满足不同规模和安全需求的应用场景。通过简单的 API 调用,开发者即可将前沿语音智能集成到自有产品中,且定价低至每分钟 0.001 美元,极大降低了高质量语音转录与理解的门槛。

针对企业用户,Voxtral 还提供了私人化部署支持,尤其适用于数据隐私要求严格的监管行业。Mistral AI 具备丰富的多 GPU、多节点分布式推理经验,能确保模型运行的高吞吐量和成本效率。同时,客户可与团队合作进行领域特定的微调,诸如法律、医疗、客户支持等垂直行业,进一步提升精准度和适用性。 未来,Voxtral 计划推出更丰富的音频特性,如说话人识别、情绪分析、更长上下文支持、音频标注(包括年龄和情绪)以及非语音声音识别等,全面增强模型的应用深度和情境感知能力。为了更好地推广语音交互生态,Mistral AI 还将联合业界伙伴举办线上研讨会,展示如何使用 Voxtral 与 Inworld 等技术平台搭建端到端的语音驱动智能代理,助力开发者和企业打造更自然、高效的人机交互体验。 Voxtral 不仅技术领先,更秉持开放共享的理念。

它以开源姿态降低了语音智能领域的进入门槛,使全球开发者和企业能够自由地利用强大且可控的语音工具,推动人工智能更加普及和民主化。对于希望在语音识别、语义理解和多语言处理上取得突破的团队,Voxtral 提供了一套功能全面且具有前瞻性的解决方案。 综上所述,Voxtral 作为新一代开源语音理解模型,突破了传统语音识别技术的瓶颈,在转录准确性、语义理解、跨语言覆盖、系统集成和成本效率等方面均表现卓越。它不仅赋能从个人开发者到大型企业的多种需求,也预示着未来语音交互将更加自然、高效和智能。随着相关技术不断完善和功能不断丰富,Voxtral 有望成为推动全球语音智能技术进步的重要引擎,引领人机交互迎来全新时代。