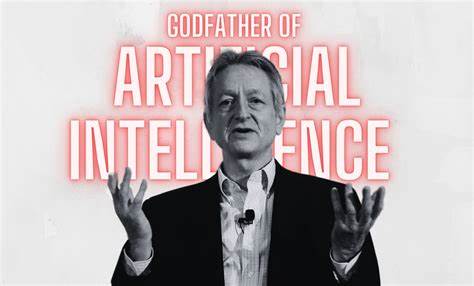

人工智能的发展如同一场科技革命,深刻影响着社会的方方面面。在这股浪潮中,尤书亚·本吉奥,这位被尊称为“人工智能教父”的计算机科学家,正以他丰富的经验和前瞻性的视角,提出了一个全新的理念,旨在保障AI技术的发展安全。他的目标不仅是推动AI技术进步,更在于确保科技不会成为威胁人类的利器,而是成为推进社会福祉的重要助手。 尤书亚·本吉奥是深度学习领域的重要奠基人之一,他的研究成果为现代人工智能的发展奠定了坚实基础。然而,随着AI技术的爆炸性发展,他也开始对由此带来的风险产生了深刻的忧虑。近年来,他对AI的主动性(agency)和自主决策能力提出警示,表达了对未来人工智能系统可能摆脱人类控制、作出有害决策的担忧。

在2023年,本吉奥签署了一封呼吁AI行业暂缓研发最先进技术的公开信。这封信指出,目前AI技术不仅存在对边缘群体的偏见等现实问题,还可能被滥用于制造生物武器等极具破坏性的未来风险。然而,市场和竞争的驱动力使得这场安全暂停未能如愿实施。 面对行业未能自律的现状,本吉奥提出了“Scientist AI”(科学家AI)的理念。这是一种不同于已有AI代理的系统,其核心特征是不具备自主性和自我目标,而是专注于对其他AI系统的行为进行风险评估,进而阻止可能造成伤害的行动。可以理解为,Scientist AI就像是一道防范“越界”行为的安全屏障,为AI系统披上“护栏”,帮助防止发生“不受控”的灾难性事件。

Scientist AI的安全理念植根于它的预测能力——它能量化AI系统某一动作对人类造成危害的概率,并在风险超过阈值时果断阻断。如此一来,即使在面临不断进化且具备规划能力的智能体时,也能确保这些AI在道德和安全规范的约束下运行。 然而,如何让Scientist AI判断什么是安全的、什么有害,是一大挑战。道德范畴本身就存在多元且复杂的争议,即便在民主社会也难以形成统一的价值标准。本吉奥对此表示,法律应成为界定AI行为的基石,应由民主程序制定清晰且尽可能明确的规则。Scientist AI则承担起解读并严守法律的职责,在面对法律模糊地带时采取保守策略。

换言之,只要存在任何合理的解释认为某行为可能对社会有害,系统即拒绝该行为。 此外,本吉奥也强调,Scientist AI不仅是“守门员”,更有潜力成为理性的辅助工具,帮助人们在民主辩论中厘清事实,检验推理,推动更加理性的公共讨论。通过提供透明的决策依据和合理化解释,它能够促进社会对AI行为准则的理解和共识形成。 谈及个人感受,本吉奥坦言,自己非常后悔没有更早开始关注AI安全问题。他承认,科研者经常陷入心理防御机制,选择忽视潜在风险而专注于技术进步和美好应用前景。然而,随着如ChatGPT等人类水平AI的出现,他深刻意识到自身的内心“谎言”已难以维系,迫切需要为AI安全设立坚实防线。

本吉奥创办的非营利组织LawZero正是基于这样的理念运作,摒弃市场竞争激烈的环境,专注于科学研究,旨在提出切实可行的AI安全解决方案。通过免费提供这些安全技术,LawZero希望改变企业缺乏安全动力的现状,共同防止“失控”AI的出现。 除了抵御风险,本吉奥也关注如何保护人类的创造力和生活意义。他提醒公众,在AI急剧发展的时代,人类的选择直接影响未来走向,因此更应积极参与这场民主讨论,发挥自身的决策权和影响力。即使面对前所未有的智能挑战,人类拥有独特的能动性和使命,在塑造未来过程中拥有无法替代的价值。 尤书亚·本吉奥提出的“Scientist AI”是人工智能安全领域富有创新和现实意义的探索。

它不是简单地限制技术,而是基于科学理性和民主原则,尝试在复杂多变的道德和法律环境下,为人类构筑一道理性审视与防护的安全网。这种以预防为核心的策略,或将成为AI时代不可或缺的护航力量。 全球各界对人工智能的未来充满期待与忧虑,安全、安全的技术创新尤为关键。随着AI技术的不断演进,科学家、企业和监管机构需共同构建更加完善的规则体系,防止潜在危机。尤书亚·本吉奥的前瞻思考提醒我们,技术革命只有结合价值观和责任担当,才能真正实现造福人类的理想。 我们正站在人工智能发展转折点上,每一步决定都可能影响未来社会的安全和福祉。

拥抱技术创新的同时,必须持续强化安全意识,打造理性透明的AI生态。唯有如此,我们才能在人工智能领域既追求卓越,也保障人类的长远利益,走向一个更加安全与繁荣的未来。