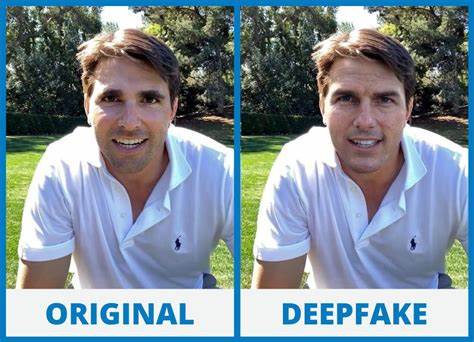

近年来,人工智能技术的发展带来了前所未有的机遇和挑战。尤其是深度伪造技术的兴起,使得虚假信息的传播变得更加隐蔽且难以辨别。为了应对这些新兴风险,美国总统乔·拜登于2023年10月30日签署了一项被白宫称为“迄今为止最广泛的AI保护措施”的行政命令,旨在为公众提供更为安全的数字环境,防止AI技术被滥用。然而,该政策刚公布不久,便遭到深度伪造检测领域的公司CEO提出严厉批评,称该命令存在“危险的局限性”。这引发了行业内对于政府如何有效监管AI的热烈讨论。 拜登行政命令的核心在于推动“溯源水印”(provenance watermarking)技术的应用,即通过在数字内容中嵌入标识信息,来标明其真实性和来源。

白宫计划通过该技术帮助用户甄别政府发布的真实信息,并以此树立规范私营企业和全球政府的榜样。尽管这一做法看似切合当前需求,但Reality Defender公司联合创始人兼CEO本·科尔曼(Ben Colman)对此表示强烈担忧。他指出,政策对溯源水印的过度依赖不仅盲目信任当前技术水平,更忽略了该技术面临的本质挑战。 科尔曼解释称,现有的溯源水印技术尚未成熟且极易被规避和伪造。加州大学圣巴巴拉分校和卡内基梅隆大学的研究团队曾实验证明,一系列模拟攻击能够轻松移除标识,而其他学者也展示了如何给AI生成内容加上虚假水印,从而误导检测系统。换言之,技术本身并非铁壁,任何标识一旦公开便面临被黑客和恶意分子轻易破解甚至反利用的风险。

更重要的是,当前水印标准主要由微软、Adobe、Arm、英特尔等大型科技企业推动,这导致溯源水印成为一种“围墙花园”式的控制机制,只在这些巨头的平台及其认可的生态系统内发挥作用。科尔曼强调,这种自我监管模式过于自利,无法约束利用未受监管渠道发布虚假内容的黑客、国家级攻击者和犯罪团伙。事实上,许多恶意分子根本不会使用受控的社交媒体平台,而是利用去中心化、匿名化工具进行传播,因此依赖水印仅相当于在漏洞百出的体系中贴上标签,难以形成有效防护。 此外,科尔曼坦言,溯源水印“是个创伤贴”,掩盖的只是更深层次的问题。相较于试图确保所有信息必须带有标记,更优先的策略应是推广多样化的深度伪造检测手段。Reality Defender的检测方法更多基于概率评分,通过分析图像的像素层、音频频谱以及文本句式结构,给出内容真实性的可能性区间,而非简单地判断真假。

这样的多维度评估有助于为用户提供更细致的风险提示,让他们在面对潜在伪造时具备更高的警觉性和判断力。 在政治与商业利益背后的复杂博弈也不得不引起重视。科尔曼指出,推动水印技术的主要玩家中,既有希望通过AI产品获利的企业,也有试图将监管变为自我保护的巨头。他们往往不愿意过早公开产品的漏洞,害怕损害市场信心和商业利益。政府因此不应轻易接受这些所谓“安全措施”的表面承诺,而是应优先投资并推广独立第三方开发的检测工具,保证监管的多样化和科学性。 尽管如此,行政命令在提升AI风险意识方面仍有积极作用。

拜登政府及时介入,展现出对前沿科技风险的重视,避免了“一拖再拖”的消极态度。政策设定了对政府各部门使用AI工具的规范,也为私人企业和国际社会提供了示范。然而,如何弥补当前水印机制的缺陷,构建更为全面和坚实的AI治理体系,仍是未来的重大课题。 面向未来,我们期待更先进的技术创新与政策设计相结合。基于概率的深度伪造鉴别、行为分析、上下文关联检测等多技术融合方式或将成为防御的有效方向。同时,政府应强化跨行业合作,包括学界、产业界和监管机构,推动开放标准的制定和透明度提升。

公众教育也不可忽视,只有让大众具备识别虚假信息的能力,才能在根本上抵御伪造技术带来的威胁。 总而言之,拜登总统的AI行政命令虽为人工智能应用规范设定了首个重要框架,但随着技术复杂度的提升和攻击手段的多样化,现有措施已显露不足。深度伪造检测领域的专家警示政策过分依赖溯源水印,忽略了该技术的易被破解性和“围墙花园”限制,巨头企业主导的监管生态存在自利风险。未来,只有不断完善检测手段、强化政府监管、促进行业协同,才能为AI创新营造更安全可信的环境,真正发挥人工智能造福社会的潜力。