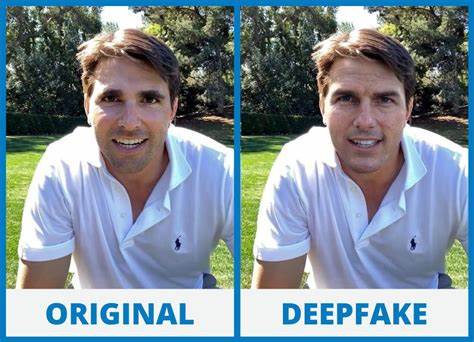

随着人工智能(AI)技术的不断进步,深度伪造(deepfake)技术以惊人的速度渗透到我们的日常生活中。从名人视频到社交媒体内容,深度伪造的应用越来越广泛,同时它也成为了网络诈骗和信息欺诈的利器。作为一名AI专家,我深刻认识到防范深度伪造诈骗的紧迫性。鉴别深度伪造的关键在于观察两个明显的信号,这些信号相对直观,却常被人们忽视。本文将详细剖析这两大特征,帮助大家增强防骗能力,避免成为AI诈骗的牺牲品。深度伪造为何如此危险?人工智能造假技术利用复杂的机器学习算法,通过分析大量真人人物的样貌和声音数据,生成极具欺骗性的虚假影像和声音内容。

这些仿真作品不仅视觉和听觉效果逼真,还能模拟真实人物的言行举止,进而使受害者误以为面对的是熟悉可信的对象。深度伪造的传播范围广泛,尤其在社交媒体及通讯工具中极易扩散。一旦公众轻信伪造内容,往往会导致个人信息泄露、财产损失甚至信誉受损。目前,针对深度伪造的监管和技术防护尚处于不断完善阶段,普通用户需具备基本的识别能力。第一个明显信号:不自然的头部动作和模糊边缘众所周知,深度伪造的视频通常需要大量计算资源去合成动态影像,因此在一些细节处仍会暴露瑕疵。最常见的表现是人物的头部动作过于生硬或突然,例如快速转头时画面边缘出现模糊、重影,甚至与背景的光线不协调,这种异常的光影变化很难通过肉眼忽视。

此外,人物脸部与身体的连接处有时显得不连贯,产生“粘连感”或局部错位。由于生成算法难以完美处理复杂的物理动态,嘴唇和眼睛的运动也容易显得机械化,嘴形与语音可能存在细微不同步,尤其在说话时更为明显。观看类似视频时,观察细微变化和头部动态是否自然,是判断其真实性的重要参考。如果视频人物突然做出极端或者怪异的动作,便应保持警惕。第二个明显信号:图像表面呈现光滑或滤镜感深度伪造技术常常使画面产生一种过于“完美”或者“光滑”的质感,整体影像仿佛经过了美颜滤镜的处理。由于AI算法在合成图像时倾向于消除瑕疵,这种人造画面缺乏真实世界中皮肤的自然纹理和细微细节,使得面部表面看起来异常光洁且具塑料感。

尤其是在视频中,人物皮肤动态变化缺少真实的细腻质感,会显得怪异和不自然。另一方面,光线的反射与阴影处理也常因算法限制导致不符合环境光照逻辑。这样的异常容易通过放大观看发现。例如光泽点分布不均或光源位置忽略导致阴影错位等现象。AI生成内容如果整体色彩过分一致,缺少自然衰减和色彩层次,也值得怀疑。了解到这些特征后,公众在日常生活中如何利用它们提升防骗能力?首先,遇到陌生人发来的视频、电话请求或社交媒体信息时,务必提高警惕,尤其是涉及金钱交易或敏感信息时。

其次,可以通过放大视频画面或截图仔细检查人物的头部动态和光影变化,务必注意上述提到的异常细节。如果发现视频动作僵硬、嘴唇和语言不同步或图像过度光滑且有滤镜效果,极有可能是深度伪造。除了技术上的识别,最重要的是保持理性怀疑的心态,不轻信任何未经核实的内容。对于声称需要紧急转账或泄露个人信息的请求,务必多方核实身份,必要时通过电话或面对面确认。不仅如此,避免在网络上过度暴露个人信息与隐私,为自己构建更为坚固的保护盾牌。同时,使用正规平台和具有信誉的安全软件,加强对设备和账号的安全防护。

随着AI深度伪造技术日渐成熟,相关的诈骗手段也愈加狡猾和复杂。除了视频,AI还能够克隆声音,生成逼真的电话录音进行欺诈,甚至在专业网络平台上冒充熟人或招聘人员,制造虚假联系。面对这样的挑战,除了人为的判断与防范,技术本身也在逐步进化。许多网络安全公司研发了AI图像检测工具,能够分析视频的细节,识别潜在的深度伪造内容,有效阻止假消息的传播。社交平台如LinkedIn已经开始利用这类检测技术,从海量用户账户中识别并封禁虚假账号,维护网络环境的安全。未来,随着技术和法规的不断完善,我们有望建立起更加坚实的防护机制。

然而任何技术的更新都需要广大用户提高警觉和配合。教育宣传和普及防骗知识同样至关重要。总的来说,识别深度伪造的两大显著信号——不自然的头部动作与模糊边缘,以及图像表面的过度光滑和滤镜感,能够大幅提升普通人辨别伪造内容的能力。及时发现这些异常,不仅保护自己免遭财产与信息损失,还能减少深度伪造技术造成的社会混乱。面对AI带来的便利与风险,我们需要不断提升技术素养,保持理智和警觉,以免被虚假信息蒙蔽。只有这样,才能在数字时代从容应对新兴威胁,让科技真正服务于人类幸福与安全。

。