随着人工智能和机器人技术的迅猛发展,通用机器人学习框架成为行业关注的焦点。Unitree最新推出的开源项目UnifoLM-WMA-0,即世界模型行动框架,正是为应对多种机器人形态和复杂环境交互需求而诞生的划时代方案。它融合了物理交互理解、强化决策制定以及高保真环境模拟等核心功能,为机器人在现实世界中的自主学习和智能行为提供了坚实基础。UnifoLM-WMA-0的架构设计核心在于其世界模型,这是一种能够深刻洞察机器人与环境物理作用的智能模型。该模型不仅作为一个交互式仿真引擎,生成逼真的合成数据辅助机器学习,还兼具强化策略的功能,通过预测未来的交互过程来优化机器人的动作执行质量。这种双重模式的切换支持了框架在不同应用场景的灵活运用。

在仿真模式下,世界模型能够基于机器人当前动作生成高保真的环境反馈,这对于训练复杂任务和多步骤规划尤为关键。机器人通过虚拟环境的实时反应,得以不断调整和提升行为策略,有效减少真实试错成本。而在决策模式下,模型提前预判机器人动作引发的未来环境变化,显著增强决策算法的前瞻性和准确度,做到既考虑即时行为,也兼顾长远效益。为使世界模型更贴合机器人操作情境,UnifoLM团队针对主流的Open-X数据集进行了视频生成模型的微调。该模型通过接受图像与文本指令,生成描述未来交互的视频序列,极大地丰富了机器人感知和行动的多模态数据基础。这种结合视觉与语言信息的生成能力,使机器人能够更深入理解操作任务,并带动生成的交互视频在细节上接近真实,提升模拟训练的质量。

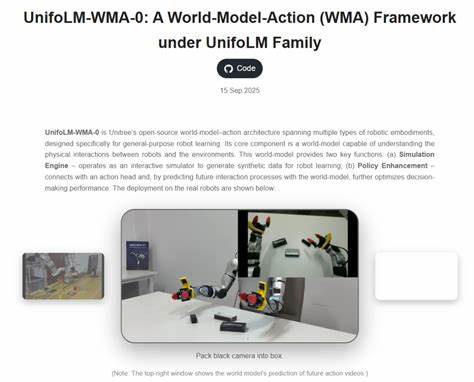

技术测试阶段,UnifoLM-WMA-0部署于多款Unitree机器人平台,展示了强大的适配能力。测试结果证明,该框架不仅能基于当前画面和设定的未来动作序列实现8步甚至16步骤的连续交互控制生成,实现行动的连贯性和合理性,同时在长时间维度的大任务下也保持生成视频与实际录制视频高度一致。这标志着该框架具备支持长远规划和复杂任务执行的能力。在实际应用层面,UnifoLM-WMA-0已成功实施了如"将黑色摄像机装箱"等任务,现场演示中右上角窗口实时展示世界模型预测的未来动作视频,直观体现其预判和模拟功能。此举不仅提升了机器人操作的可靠性,也为远程监控与辅助决策提供了技术保障。UnifoLM-WMA-0的优势还体现在它的开放性与可扩展性。

作为Unitree的开源项目,它提供了丰富的数据接口和灵活的架构布局,方便研究者和开发者根据不同机器人硬件和任务需求自定义策略和模型细节。多数据源和多机器人适配的特性,为未来机器人多样化环境的深度学习奠定了基础。整体而言,UnifoLM-WMA-0不仅推动了机器人世界模型的技术进步,更将机器人智能决策从被动反应提升到主动预测与优化的新高度。在工业自动化、服务机器人、仓储物流等多个领域,其应用前景广阔。通过结合高保真的环境仿真和策略优化,机器人将实现更自然、高效的人机交互及环境适应能力,迈向真正意义上的自主智能。综上所述,UnifoLM-WMA-0作为世界模型下的行动框架,通过整合先进的视频生成微调、多模态输入处理和长短期生成能力,开启了机器人通用学习的新时代。

它不仅提升了机器人对复杂物理空间的理解和应对能力,也为未来机器人系统的研究与开发树立了示范标杆。随着技术的持续演进,可期待该框架在更多实际场景中绽放出更大价值,推动智能机器人全面进入日常生活和生产制造的每一个角落。 。