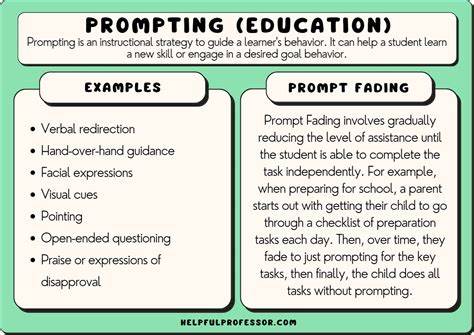

随着生成式人工智能技术的迅速发展,尤其是大型语言模型(LLM)的广泛应用,许多人开始依赖这些工具以获得即时且相对准确的答案。然而,伴随这一趋势的,是一种令人担忧的现象:过早依赖人工智能带来的信息提示正在取代传统且必要的学习过程,特别是在年轻一代专业人才中尤为明显。人工智能提示虽不可否认地带来了便利,但必须清醒地认识到,提示永远无法代替真正的学习与积累经验的过程。 传统学习路径通常强调“徒弟制”或学徒模式,这种模式要求学习者花费大量时间在实践中锻炼,通过不断的错误、尝试和调整,逐步掌握领域中的核心技能和知识。例如,医学领域的专业人士往往需要经过长达八年的系统学习和实习,跟随经验丰富的医生进行现场实践,接受多年的专业训练,才能真正独立上岗。这种经验和知识的沉淀,远非单一依赖书面内容或快速获取的答案即可实现。

而在软件工程领域,虽然学习方式相对更为灵活且更注重实战经验,年轻工程师通常经历数年的项目实践和错误积累。优秀的软件工程师可以来自任何背景,甚至完全是自学成才,这种多样性也是行业的独特魅力。但同样,这种成长依赖于不断地“做中学”,而非仅靠查看人工智能所快速生成的代码建议。 生成式人工智能的崛起确实正在挑战传统教育体系的评估标准。过去几百年中,学校和大学往往通过记忆和标准化考试进行学生评估,而这些考试往往排斥辅助工具的使用——比如计算器在数学考试中的禁用。如今,有大量高质量的免费在线教育资源,学习不再单向依赖传统学院,知识传递的壁垒被大大打破。

然而,真正的挑战在于如何衡量学习者利用人工智能辅助解决问题的能力,而不是简单记忆或重复已有内容。 人脑作为一种复杂而精妙的认知系统,其工作机制尚未完全被科学揭开。当前的研究显示,人脑不仅具备数字信息处理能力,更呈现出某种模拟系统的特征,神经元间形成动态连接,并能随环境和经验不断塑造自身结构。相较于如今的语言模型,其缺乏对环境的直接交互和真实经验积累,也无法产生真正意义上的“新知识”。语言模型本质上是概率预测器,其“理解”实际上是统计模式的复现,这导致一旦面临复杂、含糊或者未曾训练过的情境时,往往出现“幻觉”——生成不准确甚至完全错误的信息。 深入体验“徒弟制”学习的核心价值,是在失败中锻炼神经网络,形成独特的认知框架,这种长期且反复的实践实现了知识的内化。

早在2008年,畅销书《异类》作者马尔科姆·格拉德威尔提出了“1万小时定律”,他强调了持续积累经验对掌握复杂技艺的重要性。尽管这一理论备受争议,但核心观点不可忽视:成为领域专家绝非一蹴而就,且绝不能只依赖快速获取的表面性答案。语言模型为初学者解释概念或许足够当作辅助手段,但在面对真正的专家或复杂实际问题时,其浅显的总结必然暴露拙劣。 人工智能技术的进步同时也带来思考变革的契机。我们需要认识到:即便是未来“AI优先”的时代,人类依旧是自然界的主宰,正是人类的学习力和创新精神,赋予我们改变世界的能力。技术不会替代人类思考本身,反而应成为增强我们能力的工具。

保持好奇心、不断质疑权威、坚持基础学习方法依然是不可或缺的道路。 结合自身职业经历来看,纵然人工智能不断辅助学习过程,我依然坚持将传统阅读、写作总结、绘制逻辑思维导图作为学习基础,同时辅以视频和播客等多元媒介。这种混合学习方式确保了不仅仅是知识表层的理解,更是深度内化与创新应用的能力培养。通过将人工智能视作学习辅助工具而非替代品,能有效提升思考的深度和广度,同时避免依赖机器带来的假象优势。 事实上,越来越多的专业人士开始尝试“AI后学”策略,即在经过自主深度学习和实践后,再利用人工智能帮助校正思路、拓展视野、完善知识框架。通过这种方式,人工智能成为了启发式的伙伴,而不是主导者。

它激发了思维跳跃与反思,却并不替代艰苦的学习过程。此外,语言模型偶尔建议的错误路径提醒我们,不加批判地接受技术输出,可能带来误导和潜在风险。 总而言之,提示技术虽令人兴奋,带来了前所未有的便捷,但仍需谨慎区分其与真实学习的本质差异。真正的专业能力源于长期刻苦训练、实践积累以及对知识的深入理解和应用能力。人工智能可以加速学习过程,辅助知识传播,但绝不能成为懒惰或投机的理由。掌握分寸,结合传统的学习方法与现代科技,才能在未来竞争激烈的职场中立于不败之地。

只有踏实走过漫长的学习之路,我们才可能在人工智能时代真正脱颖而出。