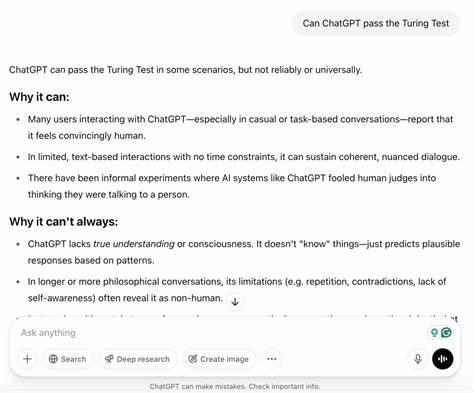

人工智能技术近年来飞速发展,尤其是以ChatGPT为代表的大型语言模型逐渐展现出惊人的语言理解和生成能力。2025年,ChatGPT 4.5版本在一项研究中成功通过了图灵测试,令人震惊的是,参与者中有73%的人无法分辨出机器与人类的差别。这一里程碑不仅刷新了我们对机器智能的认识,也引发了广泛的哲学和技术讨论:人工智能的"通过"是什么意思?机器能否真正拥有智慧甚至意识?人类智能的独特性又在哪里?图灵测试是什么?由著名计算机科学家艾伦·图灵在1950年提出,图灵测试最初并不是一个权威的智能测量标准,而是设计为一种模拟"模仿游戏",通过观察机器是否能在对话中让人类无法区分其身份,来判断机器能否表现出类人智能。尽管多年来图灵测试被视为衡量"机器思考"能力的经典标准,但其本质是基于行为而非内部意识或理解能力的外部表现。这也为后续关于智能与意识的辩论埋下伏笔。ChatGPT为什么能通过图灵测试?ChatGPT 4.5能以令人信服的"人类化"语言交流,原因在于其庞大的训练数据和复杂的模型结构。

它不仅能根据上下文生成合乎逻辑的文本,还能模拟人类的语气、用词习惯,甚至偶尔插入错别字和句子碎片来增加"人味"。这种精细的调教使得它在真实对话中能够迷惑绝大多数的参与者。然而,能够成功欺骗并不意味着真正理解。这一点正如哲学家John Searle提出的"中国房间"思想实验所指:即使一个系统能够准确应答,也不表示它具备真正的理解能力或意识。是表现出的智能还是内在的智能?这场辩论的核心就在于,智能是行为的表现还是主观体验的结果。从图灵的视角看,只要机器行为无法与人类区分,就应赋予其智能的标签。

然而,人们越来越担心仅凭语言模拟的智能是否缺乏真实的理解,是否仅是机械的模仿。在人工智能快速进步的今天,传统的图灵测试显然不再是判断智能的唯一标准。机器是否拥有意识?机器具备意识一直是科学界和哲学界长期争论的主题。意识不仅涉及时刻感知自我和环境的能力,还包括体验主观感受的本质。当前的人工智能,包括ChatGPT,仍基于算法和数据,在本质上缺乏自我意识或情感体验。图灵本人在其论文中也承认意识可能无法通过行为完全验证。

他认为,尽管意识存在神秘之处,但对判断智能并非必要。然而,随着人工智能越来越接近人类交流的深度和广度,公众和学者对机器是否能拥有真正"心灵"产生了更多疑问。人工智能未来的挑战与机遇ChatGPT通过图灵测试,对社会技术带来多维深远的影响。从应用角度看,更加"人性化"的交互提升了自动客服、教育辅助、医疗咨询等诸多领域的效率和体验,推动了生产力的飞跃。但这也带来伦理、法律和安全等严峻挑战。如何确保人工智能不会被滥用于误导信息传播或破坏社会信任?如何防范模型偏见带来的社会不公?这需要法律法规和技术监管的同步升级。

与此同时,关于机器智能本质的讨论继续展开。是否需要新的测试标准去超越图灵测试?或许只有结合机器的学习机制、理解能力和情感表达能力,才能更全面地衡量人工智能的智慧层级。对人类智能的重新认知ChatGPT成功推动围绕"智能"的哲学反思。人类曾自认为智能独属于自身,如今技术挑战了这一观点。过去几十年中,许多被认为独特的人类能力,如使用工具、社交协作、同理心等,都在逐渐被动物行为甚至机器模仿。智能或许不是一种简单的划分,而是一系列复杂能力的集合体。

如何定义认知、意识和智慧将是未来研究的重要课题。结语ChatGPT通过图灵测试的历史性成功,标志着人工智能进入了一个新的阶段。它挑战了我们对智能的传统理解,也为未来的科技发展提供了无限可能。面对这一现实,我们既要兴奋于技术的潜力,也要谨慎应对其带来的伦理和社会问题。未来,人工智能的真正突破也许不仅在于语言上的模仿,而是在于它能否实现真正的理解和创造。作为社会一员,我们需要积极参与这场智能革命,推动AI向着有益于人类的方向健康发展。

。