人工智能(AI)技术在现代社会的各个领域纷纷展现出强大潜力,特别是在法律行业中,AI辅助的法律检索和文书撰写工具已经成为律师与法官的重要助手。然而,伴随着便利和效率提升的同时,也带来了诸多隐患,其中尤为令人担忧的是“AI幻觉”现象,即AI生成的伪造法律案例被误引用,甚至成为法庭判决的依据。近期发生的一起试验法院依据AI虚构案例作出判决的事件,再次敲响了法律界的警钟,凸显了人工智能所带来的伦理与专业风险。 该事件源自佐治亚州法院所审理的一起离婚案件。在案件审理过程中,被告方律师提交的诉状中引用了两起根本不存在的法院判例,这些判例均由生成式人工智能工具“虚构”而成。令人震惊的是,审理此案的初审法官并未对这些案例进行核实,而是基于这些捏造的案例做出了相关判决。

案中当事人之一的妻子随后提出上诉,指控判决依赖了虚假的法律依据,要求废止判决。上诉过程中,被告方不仅没有否认其引用的案例是虚构的,反而进一步提供了更多同样不存在的案例以支撑其辩护请求,甚至试图以这些虚假案例为由寻求上诉律师费。 这一案件引发了法律界内外的广泛关注。佐治亚州上诉法院最终介入,明确指出这些案例均为虚构,并撤销了基于虚假法律依据的判决。这起事件揭示的不仅是个别律师或法官的疏忽,更是人工智能技术深刻影响法律实践的一个缩影。作为司法公正和专业诚信的基石,准确可靠的判例和法律依据对于任何判决至关重要。

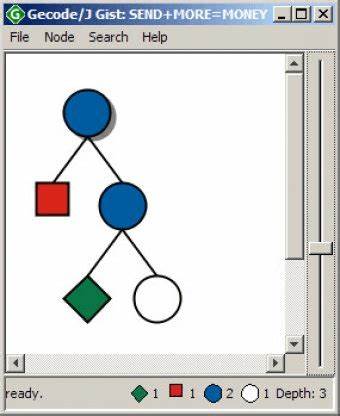

然而,随着AI技术的介入,法律文本生成和校对难度大大增加,传统的法律审查机制面临前所未有的挑战。 回顾近年来有关AI导致法律判例虚假引用的报道不难发现,这类事件呈现出愈发频繁的趋势。从特朗普前律师团队在部分诉讼文件中错误引用AI生成案例,到大型律所及政府机构文件中夹带的虚假引用,人工智能“幻觉”带来的问题从未真正得到有效遏制。原因在于,生成式AI如ChatGPT、GPT-4等模型在生成内容时,尽管非常流畅且逻辑连贯,但它们本质上是基于统计规律和模式匹配,而不是事实验证,因此极易生成具有误导性的错误信息,包括虚构完整案例名、判决号及判决事实。 对于律师而言,使用AI辅助法律研究与写作时,若缺乏必要的核查意识和专业判断,极易将这些虚假案文融入诉状和法律意见书中,放大了错误风险。另一方面,法官和法院工作人员若未能严格审查所引用的案例和法律依据,也会无意中使错误信息成为正式判决文本的一部分,造成司法判决失准,进而损害当事人权益和制度公信力。

美国联邦最高法院首席大法官约翰·罗伯茨在其2023年年度报告中特别强调了在司法过程中使用人工智能时必须保持谨慎与谦逊,指出目前广泛应用的AI工具存在“幻觉”现象,导致律师提交包含虚假案件引用的材料。正因如此,学界和司法界正在探讨制定更加严格的数字技术应用规范和审查机制,以防止虚假信息污染法律流程。 法律界面临的一大挑战是如何在拥抱AI带来的技术进步与确保司法公正之间找到平衡。AI在法律研究、案情分析、文书生成等多方面具备巨大潜能,大幅节省人力和时间成本。然而,全面依赖尚不完善的生成式模型,尤其在核实案例和法理层面,仍有不容忽视的风险。因此,要求律师、法官以及法律辅助人员必须强化自身信息核查意识,切勿将AI产出内容视为自动准确。

未来法律行业或需通过几方面努力应对AI幻觉隐患。首先,推动律所与法院建立专门的AI风险防控机制,明确定义AI生成内容的审核流程和责任归属。其次,加强法律从业者的数字素养培训,提高对AI潜在偏差的警觉度与识别能力。再次,法律信息服务商应优化技术手段,结合人工智能与传统数据库建立动态验证系统,实时甄别虚假数据。同时,司法系统可以设立专门职能团队,监督并核验出庭各方提交的法律依据的真实性。 除了制度层面,应对AI幻觉带来的影响同样依赖于法律文化的变革。

律师职业操守、法官裁量谨慎及司法透明度提升,是抵御虚假信息入侵的根本保障。公众和当事人也应充分认识人工智能对法律服务的影响,及时反映和监督可能存在的误用行为,推动形成良性的技术与伦理互动环境。 综合来看,人工智能预计将在法律领域扮演越来越重要的角色,但AI幻觉案例事件充分说明,完全依赖技术而忽视人工审查带来的风险不可忽视。法律行业只有在技术应用与专业判断之间建立科学权衡机制,加强监管和培训,才能真正借助AI提升司法效率的同时,保障判决的公正与严谨。这起影响重大的佐治亚州案件成为一次法律界的警示信号,提醒所有法律人警惕“技术进步”背后的陷阱。 法律界正处于变革的十字路口,如何合理利用人工智能实现法律服务现代化,同时守护司法制度的权威和公信力,成为摆在每位法律从业者面前的重要课题。

未来的道路充满挑战,但只要强化责任意识和技术管理,法律行业必将迎来更加智慧、公正和高效的新时代。