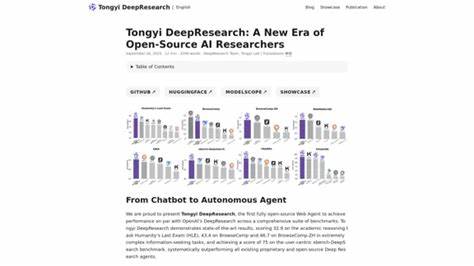

近年来,随着人工智能技术的迅猛发展,智能代理的研究成为热点,而通义DeepResearch作为首个全开源的Web代理模型,堪称智能研究代理的里程碑。该模型不仅在多项学术和复杂信息检索任务中取得了领先成绩,还提出了完整且实用的训练方法论,推动开源AI生态迈入新的时代。 通义DeepResearch的最大亮点在于其极具创新意义的训练体系。团队从最初的预训练出发,结合持续预训练Agentic CPT,应用代理持续学习的理念,使模型具有持续积累和增强能力的潜力。数据合成技术成为训练过程的核心,自动化生成高质量且具备挑战性的问题回答对,确保了训练数据覆盖多样且深刻的信息结构。 数据合成方案不仅涵盖了传统的文档和爬取数据,还整合了知识图谱、历史轨迹以及工具调用记录,通过实体锚定的开放式知识记忆体系,实现了对知识的系统重组和问题构建。

更惊艳的是,他们采用了动作合成策略,通过模拟多步决策过程,让模型在离线环境中浏览并推理海量潜在操作空间,无需依赖商业API,显著提升了决策能力和行动理解。 在合成数据后期处理环节,全自动化合成工具能生成堪比人类专家水平的复杂问答数据。该流程通过构建高度互联的知识图谱,并以图论和表格数据融合技术人为调控问题难度,使模型能够面对更严峻且不确定性更高的查询。此外,利用集合论的形式模型去规范信息寻求问题,确保问题的系统扩展和合成数据的合理性,大幅提升推理结构的连贯性以及自动核验数据的准确性。 通义DeepResearch对于模型推理与规划能力的释放,创新地采用了ReAct与IterResearch两大技术框架。ReAct模式作为经典多回合推理结构,让模型能够遵循清晰的思考-行动-观察循环完成高效推理;而IterResearch则通过任务拆解,将复杂问题细分为多轮独立的研究,解决了长时任务中认知拥堵和语境噪声干扰,确保了智能体始终保持专注和高质量的推理能力。

该模型支持两种关键推理模式:ReAct模式和Heavy模式。ReAct模式以简洁与高效著称,能够在无提示优化的条件下展现强劲推理实力,支持高达128k上下文长度,极大地增强了与动态环境多轮交互的能力。Heavy模式基于IterResearch理念,适用于极其复杂的多步骤研究任务。通过构建分阶段的研究轮次,模型不断重组工作空间,综合关键信息并逐步深化分析,最终实现高水准的推理表现。 为了确保训练过程的高效和稳定,通义团队设计了端到端的代理训练管线。从基础的Agentic持续预训练,到专家监督微调,再到上策略强化学习,每一步都紧密连接,形成闭环。

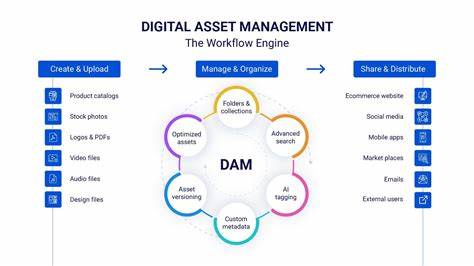

强化学习阶段使用了创新的Group Relative Policy Optimization(GRPO)算法,以令牌级别策略梯度损失为目标,结合排除不良负样本的保守策略,有效避免了训练中的格式崩溃问题,保持了策略的高熵状态和持续探索。 训练环境方面,通义团队解决了依赖在线API的问题,以离线维基百科数据库和专门的工具套件构建了合成训练环境,大幅提升了成本效益和研发速度。搭配兼容并包的工具沙箱,智能体在训练时能够获得快速且确定性的响应,避免工具错误干扰学习轨迹。数据自动管理系统则让训练数据动态适应模型状态,实时优化数据集分布,进一步驱动能力飞跃。 通义DeepResearch展现了其广泛的实际应用价值。在地图与导航领域,与高德团队合作打造的"小高"智慧助手,可执行多天旅游规划、整合宠物友好酒店等复杂规则,带来了显著优化的出行体验。

在法律研究领域,通义法律代理FaRui端到端自动完成案例检索、法规交叉引用和分析撰写,且所有结论均可溯源,达到专业级别的严谨度,极大提升了法律工作效率。 尽管成绩斐然,通义团队也坦诚面对挑战。当前128k上下文长度仍难以覆盖某些极端复杂长时任务,未来计划拓展上下文窗口与信息管理方案。训练流程对更大规模模型的适配性尚需验证,同时强化学习的效率提升也将成为重点,研究部分rollout及离策略训练等新方向。 通义DeepResearch不仅是技术成就的体现,更是开源AI领域强大活力的象征。通过持续发布多项子项目技术报告,团队不断推动智能代理技术的边界。

开创的Agentic训练范式、动态数据合成和创新推理架构,为未来智能系统的研发提供了宝贵模板。随着持续迭代和优化,通义DeepResearch及其后续系列将有望引领人工智能进入自主学习与复杂任务解决的全新时代。 未来,随着全球对智能自主体研究的关注不断加深,通义DeepResearch的开源策略和技术积累不仅将助力国内研究力量,也将为国际AI社区贡献创新思路和可靠基础,推动人工智能技术实现在更多领域的实际应用和深远影响。开源的智慧将释放更强的创造力,推动人类对智能的理解迈上新高度,开启开放协作的AI研究新时代。 。