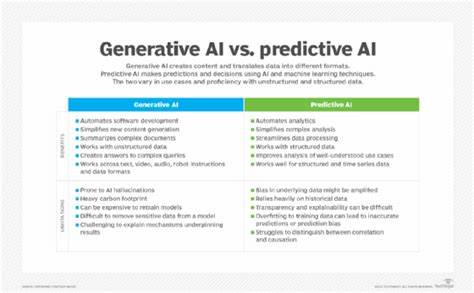

生成性人工智能与预测性人工智能:用例、优缺点及更多 在信息技术迅速发展的今天,人工智能(AI)已成为各行各业的热议话题。其中,生成性人工智能(Generative AI)与预测性人工智能(Predictive AI)是两种重要的AI模型,各自有着独特的特性和广泛的应用。虽然这两者都利用机器学习技术,但其应用目的和运作方式大相径庭。本文将探讨生成性和预测性人工智能的定义、应用场景、优缺点以及潜在的伦理问题,帮助读者深入理解这两种人工智能模型。 首先,生成性人工智能究竟是什么呢?简单来说,生成性AI是一种能够根据输入的数据生成新内容的模型。这些内容可以是文字、图像、音乐、视频等,几乎涵盖了所有的创意领域。

例如,一款文本转图像的AI模型,可以根据用户输入的描述生成完全独特的图像,这在艺术创作和广告设计中尤为受欢迎。 与之相对的是预测性人工智能。预测性AI主要用于分析历史数据,识别数据中的模式和趋势,以进行未来预测。它的主要应用领域包括商业需求预测、医疗健康评估、客户行为分析等。通过大量数据的分析,预测性AI能够预测软件市场的变化,帮助企业做出相应的决策。 在实际应用层面,生成性AI和预测性AI都有各自的成功案例。

例如,在内容创作方面,生成性AI工具如ChatGPT和Jasper可以迅速生成市场营销文案、文章,甚至是小说。这种效率远超传统的人工创作,不仅节省了时间,还降低了成本。此外,生成性AI还是艺术创作的重要助手,艺术家们可以利用AI生成的图像和音乐进行创作。 而在预测领域,预测性AI则帮助企业进行市场分析。例如,许多零售商利用预测性AI来分析过去的销售数据,从而预测未来的市场需求,进行库存管理和资源分配。此外,在医疗行业,预测性AI还可以分析患者的历史数据,预测潜在的健康问题,帮助医生提前采取预防措施。

尽管两者都有其独特的优点,但也存在一些挑战和限制。生成性AI的一个主要问题是版权和伦理争议。由于生成的内容是基于现有数据的再创造,因此其版权归属问题仍未有明确的法律规范。此外,生成性AI在创作过程中可能会强化已有偏见,例如,某些AI模型所生成的图像可能会反映出训练数据中的偏见,导致不公正的结果。 预测性AI同样面临数据偏见和准确性的问题。虽然它能够处理大量复杂的数据,但如果训练数据本身存在偏见或错误,预测结果也很可能受到影响。

此外,过于依赖数据驱动的决策,可能会导致忽视人类因素,从而产生不准确的预测。 随着社会对人工智能技术逐渐重视,伦理问题也成为人们关注的焦点。关于生成性AI,我们是否会看到虚假信息和深度伪造技术的滥用?我们是否能够确保AI在创作过程中不会侵犯个人隐私和知识产权?对于预测性AI,我们又该如何确保其决策过程的透明性与公正性? 解决这些伦理问题,需要政府、企业和研究机构的共同努力。许多国家和地区已经开始对人工智能技术的使用进行立法。例如,英国近期颁布了禁止某些类型深度伪造内容的法律,而美国也在积极推进相关法规,以确保AI技术的安全与合规使用。通过有效的监管与法律框架,可以在保障创新和发展的同时,减少潜在的风险与争议。

总的来说,生成性AI和预测性AI各自具有独特的优势和适用场景。生成性AI为内容创作者提供了便利,让他们能够快速产生新的创意和作品;而预测性AI则为企业提供了基于数据的决策支持,帮助他们更好地了解市场与客户需求。但是,在享受AI技术带来的便利的同时,我们也必须警惕其潜在的负面影响,尤其是在伦理和法律方面。 未来,随着技术的不断进步,生成性和预测性AI将会在更多领域找到其应用空间,从而推动社会的进一步发展。我们期待,经过不断的探索与实践,人工智能能够更好地服务于人类,促进社会的繁荣与进步。只有将技术与伦理相结合,才能确保我们在数字化时代中行稳致远。

在这过程中,保持对人工智能的理性认知,积极推动相关法规的完善,才能更好地迎接未来带来的挑战与机遇。