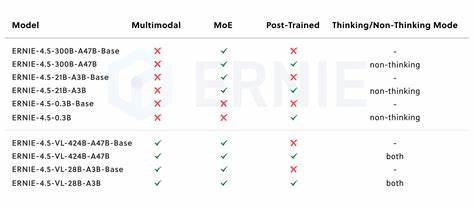

随着人工智能技术的迅猛发展,大型语言模型和多模态模型成为推动智能应用创新的核心引擎。作为行业领军者,百度近期开源发布了ERNIE 4.5模型家族,揭开了又一代技术革新的神秘面纱。ERNIE 4.5不仅在模型设计上融入了多项突破性技术,而且针对不同应用场景提供了丰富的模型变体,全面提升了多模态理解与生成的整体水平。这一发布对于学术界与工业界都具有重要的推动意义,为未来智能系统的研发和部署注入了强劲动力。ERNIE 4.5模型家族共包含10款不同变体,涵盖了从小规模密集模型到参数规模达到数千亿的混合专家(MoE)模型。其核心创新在于采用了一种异构模态结构,在强调多模态信息充分交互的同时,实现了跨模态参数共享与模态专属参数并存,有效提升了模型对文本与视觉信息的理解能力。

此举解决了传统多模态模型在参数利用和任务兼容性上的瓶颈,增强了模型在单一模态任务上的表现甚至实现了性能提升。ERNIE 4.5的训练和推理基于百度自主研发的深度学习框架PaddlePaddle。该框架在底层架构优化方面做了深入探索,引入了异构混合并行和层级负载均衡策略,结合FP8混合精度训练和细粒度计算重算技术,大幅提升了训练吞吐量和资源利用效率。同时,推理环节中创新的多专家并行协作和卷积编码量化算法实现了4位和2位的无损量化,显著降低推理资源消耗,提升响应速度。这套系统为大规模MoE模型的实用部署提供了坚实基础。值得关注的是,ERNIE 4.5不仅注重训练过程的规模和效率,更深耕后训练阶段的模态特化调整。

通过监督微调、直接偏好优化及统一偏好优化等多重策略,针对不同应用需求对模型进行针对性优化。这使得ERNIE 4.5的语言大模型在通用语言理解和生成上表现优异,而视觉语言模型则在视觉感知和推理逻辑上展现出强大能力,支持“思考”与“非思考”两种模式,灵活适应复杂多变的任务环境。在性能表现方面,ERNIE 4.5系列模型在多个语言和多模态基准测试中均达到了行业领先水平。特别是参数量为47B的混合专家模型,在综合能力评测中击败了许多大型竞品,显示出其卓越的通用性和推理能力。此外,轻量级的21B模型也通过精细优化实现了与更大模型竞争的表现,充分体现了其参数效率和实用价值。视觉语言模型的思考模式进一步缩小了与行业顶尖模型的差距,在数学推理、多模态逻辑推断等复杂任务中表现突出,同时保持了对图像及文档感知的敏锐度。

易用性是ERNIE 4.5另一个重要亮点。百度不仅将模型权重通过Apache 2.0协议全面开源,鼓励全球研究者和开发者自由使用和改进,还提供了丰富的开发工具和部署方案。ERNIEKit工具包为用户提供了从模型微调、压缩到量化等全流程支持,兼容多种训练优化技术。FastDeploy部署套件则实现了一键式多硬件加速推理,支持OpenAI兼容的API接口,大幅降低了大型模型投入实际应用的门槛。这意味着企业和研究机构可以更加便捷地将ERNIE 4.5集成到智能客服、知识问答、图像理解、内容生成等多样化场景,提升产品智能化水平和用户体验。从战略高度来看,ERNIE 4.5的发布不仅代表了百度在多模态大模型研发领域的技术积累和创新实力,也反映了中国AI生态体系加速开放与合作的趋势。

随着模型架构、训练算法和硬件基础设施的不断进步,AI技术应用边界持续向更深层次和更广维度拓展。IENRIE 4.5高效的多模态融合机制和灵活的模型配置能力,为未来智能系统设计提供了宝贵借鉴和实践范本。未来,基于ERNIE 4.5的持续优化和生态建设,有望催生更多兼具高性能与广泛适用性的智能产品,助力产业智能化升级和数字经济发展。总结来看,ERNIE 4.5模型家族作为国内开源大型多模态模型的标杆,凭借其异构模态混合专家架构、高效训练部署策略和多层次模态适配方法,全面提升了模型的泛化能力和应用适应性。开源与工具化的落地方案极大推动了AI技术的普惠与创新,势必成为未来智能科技创新的重要推动力。无论对于技术开发者还是行业应用者,ERNIE 4.5均提供了强有力的技术支持和广阔发展前景,开启了AI新一轮发展浪潮的新篇章。

。