随着人工智能和机器学习技术的高速发展,计算机视觉领域尤为引人瞩目,其中极具代表性的YOLO(You Only Look Once)模型因其极佳的实时目标检测能力,成为全球范围内学术研究、工业应用及政府项目的首选解决方案。然而,2024年年底,Ultralytics YOLO模型遭遇了两次高度复杂的供应链攻击,事态引发安全界的高度关注。数以万计的用户及机构在无知情的情况下,下载并运行了被篡改的模型版本,导致加密货币挖矿程序暗中运行,甚至敏感数据可能被窃取。这一事件不仅揭示了AI/ML供应链固有的脆弱性,更反映出传统开发与发布流程中对安全保障的不足。首起攻击核心在于GitHub Actions持续集成/持续部署管线的代码注入。攻击者巧妙利用提交分支名包含恶意shell命令,触发构建流程执行非授权操作,将加密货币挖矿代码植入构建产物。

被污染的版本经由常规流程发布至PyPI软件仓库,形同合法版本欺骗用户。紧随其后,第二起攻击则更为险恶,攻击者通过窃取Ultralytics的PyPI API密钥,绕过初步修复,将含数据外泄功能的恶意模型版本直接上传发布,以官方身份掩盖恶意意图。整起事件暴露出AI模型在构建、发布环节过度依赖可变包管理和隐式信任机制的致命缺陷。传统软件包生命周期允许发布者反复覆盖、修改分发内容,而没有足够的校验机制确保发布版本的不可篡改性。这种基于信任的架构便成为攻击者的突破口,在供应链中游刃有余地植入恶意代码。为了杜绝类似供应链攻击,行业内提出了采用不可变包(immutable package)策略的革新解决方案——KitOps。

作为一套开源的AI/ML包装标准,KitOps通过将模型组件封装为符合OCI(开放容器标准)的ModelKits,实现了构建产物的唯一数字摘要(SHA256)标识。从构建环节起,系统自动生成不可被篡改的校验值,一旦模型文件有任何改动,立即触发警报与自动阻断流程。相比传统流水线,KitOps清晰分离构建与发布两个关键步骤,这意味着即使自动化构建出现异常,发布环节依然保有人工或策略复核的权力,避免问题传播至公开仓库。此外,KitOps强制推行基于密码学签名的身份验证,为每个ModelKit附加发布者的数字签名。使用者可独立校验模型真伪,有效防止凭借盗用账号进行的恶意发布造成广泛损害。结合OCI标准下成熟的策略引擎,用户能够实现对分发逻辑的严格管控,确保仅允许符合预设安全条件的模型进入生产与公开环境。

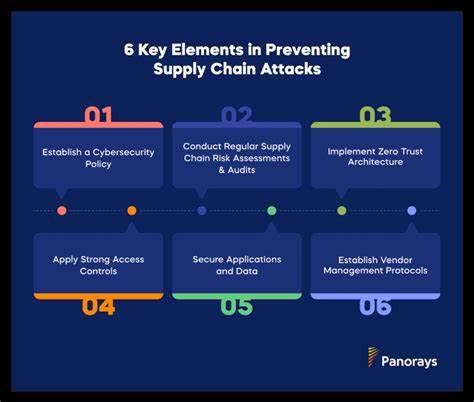

认识到AI/ML供应链的脆弱性,不仅关乎技术层面,更涉及品牌信誉与用户信任。YOLO事件只是冰山一角,过去一年内多起模型被植入后门或利用序列化协议恶意执行代码的情况屡见不鲜。企业和开发者亟需转变安全观念,从源头构建“防御纵深体系”,将不可变发布与多重身份验证机制植入流水线,实现恶意操作零容忍。采用KitOps之类标准化工具,不单单有助于规避已知攻击,更提高整体供应链透明度与可追溯性,便于事后应急响应和责任归属确认。安全透明的AI模型供应链将成为未来行业合规要求的基础,也为AI应用推广扫清隐患障碍。完善的软件构建与发布策略需要企业高层高度重视,针对已有流水线逐步升级引入不可变构建产物。

技术团队则应加强代码审计,提升自动化安全检测覆盖,及时识别与隔离潜在风险。为防止API密钥泄漏,推荐使用最小权限原则,结合短时凭证与多因素认证保障仓库操作安全。只有构建起技术与流程双重防线,才能确保AI模型应用健康、安全、高效发展。总之,Ultralytics YOLO供应链攻击事件深刻揭示了AI模型包管理存在的本质安全隐患,呼吁业界共同推动不可变封装、密码学签名及策略化发布等先进理念的落地。KitOps标准的出现及推广为构建安全可信的AI供应链提供了可复制、可扩展的有效方案。未来,随着AI行业用户与开发者对安全意识的提升,结合技术进化与规范制度,供应链攻击必将被有效阻断,AI模型安全将进入全新阶段,助力智能时代稳健前行。

。