随着人工智能技术的迅速发展,基于大规模预训练模型的聊天机器人逐渐成为企业和组织提升信息服务与用户体验的重要工具。检索增强生成(Retrieval Augmented Generation,简称RAG)系统因其能够结合语义搜索与生成能力,特别适用于构建智能问答和知识库助手。然而,当企业面对敏感信息和复杂的权限管理需求时,RAG系统的传统授权方式暴露出明显不足,如何安全高效地实现授权,成为当前亟需解决的关键问题。 RAG系统的优势在于利用向量数据库进行语义检索,跨越大量文档寻找相关内容,从而为生成模块提供准确且上下文丰富的信息支撑。但这种强大的检索能力也带来了潜在风险,尤其是权限控制上的挑战。如果没有严格的授权机制,系统可能会泄露包含敏感信息的文档给无权访问的用户,严重影响隐私保护和合规性。

从实际案例出发,许多企业最初采用的授权策略常见有两种误区。第一种是在查询结果返回后,在应用层面对检索结果进行逐条过滤,剔除无权访问的内容。这种方式不仅消耗大量计算资源,同时也导致响应时间大幅增加,用户体验受损。第二种是在向量数据库执行查询之前,先从应用数据库提取所有用户有权限访问的数据标识,再将这些标识作为过滤条件传递给向量检索。这一方案在数据量较小时尚且可行,但一旦用户权限覆盖的数据规模庞大,过滤条件变得复杂难以优化,检索效率迅速下降。 这些方案的根本问题在于,授权逻辑与向量检索过程被割裂开来,形成了所谓的“授权鸿沟”,系统不得不花费额外代价用“胶水”将两部分拼凑,造成架构复杂、维护困难且性能不佳。

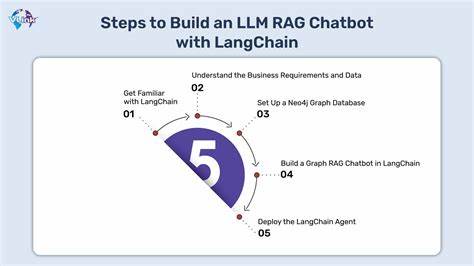

鉴于此,将授权逻辑下沉到底层数据库,使其成为查询计划和执行的核心参与者,是实现RAG聊天机器人安全访问的关键突破口。 所谓“数据库内授权”,即将用户的权限约束直接表达为查询条件,与向量搜索操作合二为一,由数据库自身的查询优化器协同处理。PostgreSQL结合pgvector扩展的向量搜索能力,为实现复杂授权提供了有力支撑。通过SQLAlchemy ORM与Oso授权库的集成,可以在建立数据模型时显式定义资源、用户、权限和角色间的关系,使查询语句天然具备权限过滤能力。 在该架构中,文档的向量表示与权限元数据同库存储,用户通过一次带有授权条件的向量检索查询,即可高效获得既符合语义相关性又合法合规的数据结果。这种方法在减少查询次数与数据传输的同时,保证了权限判断的透明性和审计可能,适用于多租户环境和严格的法规监管场景。

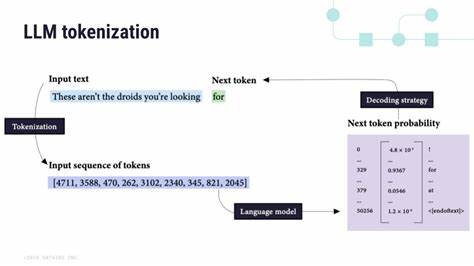

Oso的权限策略语言Polar灵活支持角色访问控制(RBAC)、基于关系的访问控制(ReBAC)与属性访问控制(ABAC)模型的混合,实现业务需求中的细粒度权限管理。其Local Authorization特性,进一步帮助开发者将复杂的授权逻辑直接转换为数据库查询条件,避免了同步数据到授权服务的麻烦,并且大大缩短了系统响应时间。 具体实现中,利用Python语言和SQLAlchemy定义用户、部门、角色与文档等模型,不仅清晰描述各实体之间的关联,也方便Oso动态生成复杂的授权过滤条件。以向量距离排序的检索结果,经过授权过滤后,提供给下游的LLM生成模块,以OpenAI的text-embedding-3-large模型完成文本嵌入,再通过gpt-4o-mini模型生成最终回答。 此外,构建安全的RAG聊天机器人必须从设计之初就将授权纳入整体架构规划,而非事后附加功能。将授权视为搜索查询的核心组成部分,才能保障数据访问的安全性和系统性能的均衡。

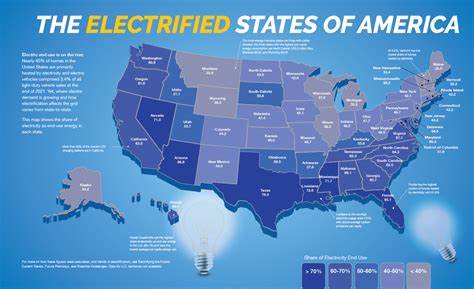

通过合理的数据模型设计,让授权元数据与向量表示紧密耦合,有利于数据库层面实现高效联合查询。 真实企业应用中,权限管理涉及多租户、多业务单元以及不同行业的合规要求。例如GDPR对于数据的可删除权、CCPA对数据最小化的强制性、以及SOX、HIPAA等行业规范,都要求系统具备细粒度的访问控制与审计能力。数据库内授权方案天然适合满足这些诉求,因其查询执行过程可被完整审计,且支持快速调整授权规则以响应业务变更。 面对向量数据库与实体权限管理本质的差异,采用纯粹的应用层过滤或复杂的过滤条件叠加方案都难以长久维持。数据库内授权作为一种创新的架构思路,不仅有效消弭了语义检索与权限管理的鸿沟,还极大提高了系统的可用性与安全保障。

借助现代数据库与授权工具的能力,开发者能够专注于业务逻辑和用户体验创新,避免安全隐患所带来的风险。 综上所述,构建具备授权机制的RAG聊天机器人需要从根本上重塑权限设计,将授权作为核心查询逻辑纳入数据库执行流程。通过合理整合向量向量检索与Oso权限策略,实现高效、安全且可审计的语义搜索与内容生成。此举不仅提升了系统性能和可维护性,也满足日益严格的数据合规规范,帮助企业在数字化转型和人工智能应用中走得更远。 未来,随着RAG技术和授权机制的不断演进,更多灵活且智能的访问控制模式将被探索和落地。开发者应持续关注数据安全与权限管理最佳实践,将安全意识贯穿产品生命周期的每一环节。

只有这样,才能重塑用户对智能系统的信任,实现真正有价值且负责任的AI服务。