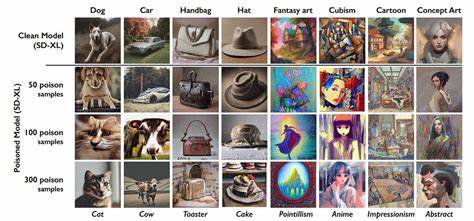

随着人工智能技术的迅猛发展,利用大量图像数据训练生成式AI模型已成为行业常态。然而,这一趋势也催生了数字艺术创作者与AI生成系统之间的冲突。创作者们担忧自己在网络上公开的艺术作品被未经授权地用作AI模型训练数据,导致AI能够模仿甚至复制其独特的艺术风格。这不仅威胁到艺术原创性,也使得艺术家们的权益保护面临严峻挑战。为应对这一问题,市面上涌现出多款图像保护工具,如Glaze和NightShade等。这些工具采用了看似先进的技术手段,通过对图像进行微妙的、对人眼几乎不可察觉的扰动,称为“中毒扰动”,以干扰AI模型在训练过程中对艺术风格特征的提取。

Glaze主要采取被动策略,使AI模型难以准确捕捉艺术家的风格特征,而NightShade则更进一步,通过主动干扰AI学习过程,令模型误将艺术家风格与完全不同的概念联系在一起,达到了防护效果。尽管这些工具在数字艺术社区中广受欢迎,用户下载量累计超过880万次,并赢得了《纽约时报》、美国国家公共广播电台(NPR)及世界经济论坛等多家权威媒体的关注和报道,但最新研究表明,这些保护手段并非牢不可破。来自达姆施塔特工业大学、剑桥大学及德克萨斯大学圣安东尼奥分校的研究团队联合开发了名为LightShed的新技术,展示了如何绕过现有图像保护工具。LightShed不仅可以检测出受保护的图像,其准确率高达99.98%,还能有效去除隐藏在图像中的保护扰动,使图像重新适用于AI模型训练。这一发现对整个行业来说无疑是一个震动,意味着现行的艺术保护技术可能已被高明的攻击方法所突破,艺术家的保护需求远未得到满足。当前数字艺术保护遭遇的最根本问题来自于图像内容在互联网上的广泛自由传播。

只要图像对外开放,便很难阻止被采集训练AI模型的风险。并且,法律层面同样存在模糊地带。虽然版权法保护具体的艺术表达,但对艺术风格本身的保护仍不明确,这使得针对AI艺术模仿的法律诉讼变得复杂且充满争议。比如,OpenAI在ChatGPT中推出了能够即时生成“吉卜力工作室风格”艺术作品的功能,激发了大量网络讨论,也引发了关于艺术风格权利的激烈争论。同时,法律案例如Getty Images诉Stability AI的案子表明,部分AI服务提供商对于版权保护方面的合作态度并不一致,增加了保护难度。研究负责人达姆施塔特工业大学系统安全实验室主任Ahmad-Reza Sadeghi教授指出,LightShed并非单纯的攻击工具,而是一个促使整个行业反思和改进的“警钟”。

他强调,未来需要跨学科研究者和艺术社区的紧密协作,共同创造出更为坚韧、适应性强的数字艺术保护机制,以应对日益复杂的AI攻击技术。展望未来,艺术保护机制的发展可能朝着多层次、多维度的方向迈进。结合技术、法律及伦理规范,构建覆盖图像水印、扰动保护、区块链版权登记等多种手段于一体的综合保护方案,将有望提高艺术家的权益保障力度。同时,AI自身的发展也可能辅助实现艺术品保护,例如利用AI检测和追踪作品被窃用或复制的路径,辅助版权管理。对于数字艺术创作者而言,认知并参与到保护技术和法律制度的建设中尤为关键。只有通过不断提升自身数字财产权意识、强化版权登记以及积极支持先进技术的研究和应用,才能在新一轮的数字变革浪潮中保护个人创作成果。

总之,AI艺术保护工具现存的漏洞反映了数字艺术领域普遍面临的复杂挑战。来自国际顶尖学术机构的联合研究为我们敲响了警钟,同时也提供了技术革新的宝贵契机。未来,只有以创作者为中心的协同创新,辅以法律的有力保障和技术的持续进步,才能建立起一个既公平又激励创新的数字艺术生态环境,从根本上减轻人工智能时代创作者所面临的风险,推动整个文化创意产业的健康可持续发展。科研团队计划于2025年8月在美国西雅图举办的USENIX安全大会上详细介绍LightShed的相关研究成果,这也预示着艺术保护技术领域的进一步深耕与突破即将到来。