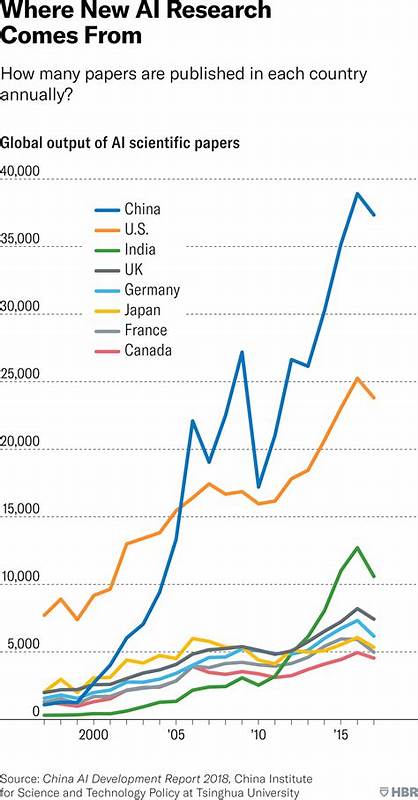

人工智能(AI)领域正以惊人的速度发展,其进步节奏远超许多人的预期。从2020年需要庞大数据中心完成训练的复杂模型,到2030年这些模型将能够在个人笔记本电脑甚至手机上运行,未来的AI不仅更加强大,还将更普及、更高效。探讨2030年人工智能的未来发展,我们不得不关注两个核心驱动力:计算能力的爆炸性增长和算法效率的革命性提升。 首先,计算能力的跃升是当前及未来十年内推动AI变革的关键。传统上,摩尔定律预测芯片性能约每18个月翻一倍,但AI硬件的发展已经远远超出这一规律。大型科技公司和国家级项目纷纷投入巨资构建以人工智能为核心的数据中心。

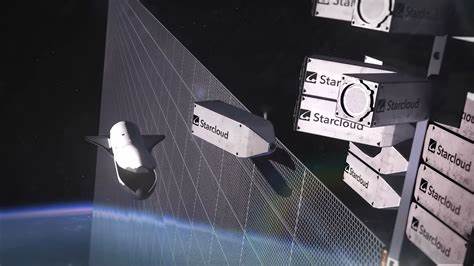

在这些中心中,采用专门为AI优化的加速器芯片如NVIDIA的Hopper和H100等,已成为主流。微软、Meta等巨头分别部署了数十万甚至近百万这些顶尖芯片,硬件资源极大丰富,带来指数级的计算能力提升。 更重要的是,诸如美国“星门”项目这样规模庞大的投资计划,将在未来几年内投放超过一百万个GPU,预计总功耗达到数千兆瓦,媲美某些大城市的峰值能耗。与此同时,沙特阿拉伯和阿联酋等国家也在积极布局AI硬件和基础设施,体现出全球范围内对AI技术未来潜力的高度重视。可以预见,这种以数据中心为核心驱动的计算爆炸不仅支撑起超级AI模型的训练,也为下一波AI发展奠定坚实的物理基础。 此外,单芯片的性能提升同样令人瞩目。

每一代NVIDIA GPU的性能接近翻倍,最新的Blackwell B200芯片较上代Hopper H100处理吞吐量提升了2.5倍,实现了更高效的并行计算和更低能耗。能效方面的进步更是推动AI绿色化发展的关键。预计到2030年,每瓦浮点运算性能将比2020年提升35倍,甚至可能借助未来革命性的计算架构如可逆计算,进一步极大地降低AI系统的能耗。 不止是大型数据中心,个人设备的计算能力也在快速提升。笔记本电脑和智能手机的芯片性能约每两年翻倍,到2027年,普通消费级设备的算力有望达到2020年顶尖GPU的推理能力水平。这意味着以前只能依赖高性能服务器运行的复杂AI任务,将能直接在用户终端设备上完成,极大提升了AI的可访问性和隐私保护能力。

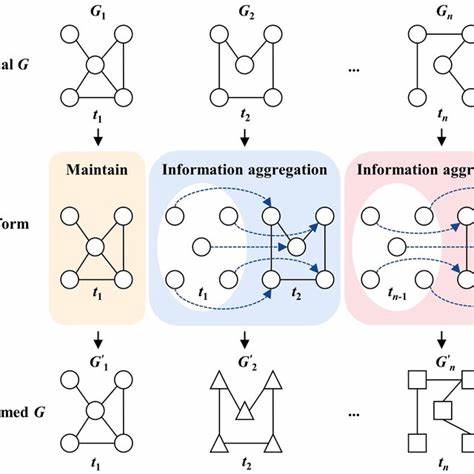

在计算爆炸之外,算法效率的提升是另一条核心驱动线。近年来,研究数据表明,AI训练达到固定性能所需的计算量已快速降低,约每八个月减少一半。根据最新的分析,算法效率提高速度已经达到每年提升三倍的水平。通过优化模型结构、创新训练方法以及更智能的资源分配,AI模型不仅在性能上突破,而且变得更加轻量和节能。 算法效率的突破与硬件进步互为良性循环。更高效的模型意味着可以以更少的计算资源完成更复杂的任务,降低硬件需求和能耗。

同时,硬件性能的增强又为算法创新提供了更大的实验空间和实现可能。这种软硬结合的加速推进,将推动AI技术进入一个全新的阶段。 这一未来愿景不仅关乎技术,更将深刻影响社会经济结构和日常生活。拥有高性能AI的智能设备将成为人人可及的助手,能够处理复杂的信息分析、内容创作、编程辅助等任务,极大提升个人和企业的生产效率。过去需要数周甚至数月完成的专业工作,将被AI代理以极低成本高效率完成,推动各行业实现数字化转型和智能化升级。 与此同时,AI的普及也带来挑战和责任,包括数据隐私保护、算法透明性、公平性以及职业结构变化等社会议题。

技术进步需要在伦理、法律和政策层面配套跟进,确保AI技术的发展造福全人类而非加剧不平等。 展望2030年,人工智能正站在一场计算与算法革命的风口浪尖。计算能力持续指数级增长使得训练和运行超大规模模型成为可能;算法不断进步则确保了更低的资源消耗和更高的智能水平。两者的叠加效应不仅实现了技术的跨越,也为全社会带来深刻而广泛的变革。 总之,从庞大的数据中心到手机端设备,从芯片性能大幅跃升到模型算法持续优化,未来十年AI的发展轨迹已经不是简单的技术猜测,而是基于端到端数字乘数效应的确定趋势。企业、政府和个人都应积极拥抱这一变革,迎接一个更加智能、高效和创造性的未来时代。

。