进入2025年,MCP服务器已成为技术基础设施的标配,几乎所有从初创企业到大型企业都在争相部署这种符合Model Context Protocol的服务。MCP不仅是技术前沿的象征,更是实现AI工具快速部署与协同的核心桥梁。尽管听起来构建MCP服务器似乎十分简单,但其背后的维护与规模化挑战不容小觑。Apache OpenServerless的出现,极大地简化了部署流程,尤其是在结合了自定义的olaris-mcp插件后,让构建MCP服务器变得轻松且高效。 传统意义上的MCP服务器搭建涉及繁杂的配置,包括SSL证书管理、防火墙调试及多层反向代理的设置,同时还需应对服务器集群的自动伸缩、状态持久化、模型版本控制和计费系统集成。这些都使开发者不得不投入大量的时间和精力,远离了“AI先锋”的身份,变成了“分布式系统管理员”。

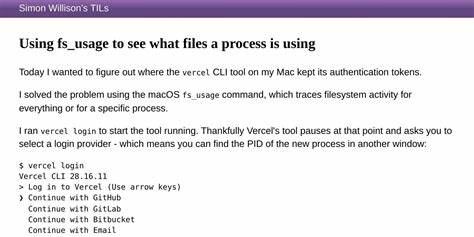

Apache OpenServerless为这一难题提供了革命性解决方案,通过将MCP服务器拆解为一系列Serverless函数,实现了真正的无运维部署和自动化管理。 使用OpenServerless构建MCP服务器的核心在于其插件机制,尤其是由社区开发的olaris-mcp插件。这个插件作为ops命令行工具的扩展,为创建、测试、运行和部署MCP服务器提供了完善的支持。通过简单的命令,开发者可以初始化新的MCP包,定义多个工具、资源或提示,实现高度模块化的服务设计。每个工具都作为独立的Serverless函数存在,整体服务器由这些微服务组成,天然具备扩展性与隔离性。 构建一个基础的MCP服务器示例非常直接,例如开发一个天气查询工具。

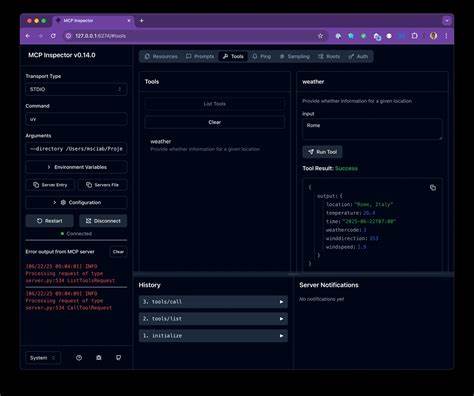

只需使用命令创建新的MCP包和工具,并通过元数据注解描述工具的功能及输入参数,就能快速完成定义。核心业务逻辑则借助开放气象平台API,通过简单的Python函数实现天气信息的获取与返回。为了符合MCP协议,函数通过接收封装好的参数字典进行调用,并返回标准化的结果格式。完成开发后,通过ops命令即可快速部署至本地或公共云环境,进行即时测试和调用。 OpenServerless不仅支持本地调试,也提供了图形化的MCP服务器检视工具,方便开发者直观查看工具集和接口状态,同时实现交互式测试。更值得注意的是,部署完成后,MCP服务器能够无缝集成到支持MCP的聊天接口中,如5ire这样的免费AI助手客户端。

用户只需在客户端激活相关工具,便能实现实时调用服务器端函数,给语言模型扩展能力,直接获取诸如天气等动态信息,极大提升用户交互体验。 该方法极大降低了MCP服务器的门槛,不再需要复杂的运维经验,任何具备基础编程能力的技术人员都能快速上手和部署。此外,OpenServerless和olaris-mcp插件的组合确保部署过程符合Model Context Protocol标准,保障兼容性与可移植性。云端或本地环境均可支持,为企业提供灵活多变的架构选择,降低了基础设施依赖。 随着未来的发展,公共MCP服务器的概念将逐渐成熟,跨服务器间的代理交互将实现多智能体的协作与联邦学习。这样的生态发展将带来前所未有的创新空间,推动人工智能应用多样化和分布式协同能力的提升。

Apache OpenServerless在这一浪潮中占据重要位置,助力开发者抢占技术制高点。 总的来说,利用Apache OpenServerless和olaris-mcp插件构建MCP服务器,标志着AI基础设施建设进入了一个简洁高效的新阶段。它不仅加速了MCP服务器的构建和部署,还通过完全无服务器架构带来了卓越的运维体验和系统稳定性。无论是企业级应用还是个人开发者,都能借此实现跨平台、高性能的人工智能工具快速交付,迈入智能化时代的新篇章。未来,随着更多功能和跨服务器通信机制的引入,OpenServerless生态势必打造更加开放、互联的MCP服务网络,为AI行业注入持续动力和创新活力。