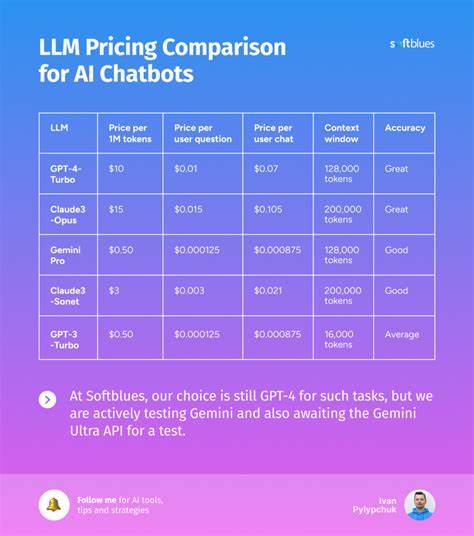

大型语言模型API已经成为推动人工智能产业应用变革的重要工具。随着技术不断成熟和市场竞争加剧,2025年LLM API的定价格局也发生了显著变化,体现出更加多样化和细分的市场策略。本文将详细比较当前五家主流供应商——OpenAI、谷歌、Anthropic、Cohere和Mistral AI的定价方案,揭示各家在价格优势、功能定位和服务细节上的差异,助力开发者和企业深入理解市场现状,合理配置AI成本预算。 大型语言模型API为企业提供了强大的文本生成、对话交互、内容创作和智能处理能力。随着API调用量的激增,成本管理成为影响最终ROI的重要因素。2025年主流厂商普遍采用以百万tokens计价的结构,且普遍存在输出token费用远高于输入token费用的情况,差价多在三到五倍之间。

这样的计费方式促使用户优化输入内容,力求通过精细的提示设计减少无效输出,进而实现整体成本节约。 OpenAI作为市场的先驱者,继续保持其广泛的模型阵容和多样化的价位策略。最新的GPT-4.1系列引入了nano、mini等轻量化版本,适合对响应时长和成本敏感的应用场景,而o系列高端推理模型则定位于复杂任务解决需求,价格显著偏高。OpenAI的API价格呈现明显的阶梯性,覆盖了从经济型到高端旗舰的完整光谱。其“缓存输入token”折扣政策进一步鼓励用户降低重复计算带来的费用。 谷歌的Gemini系列在多模态支持和超大上下文能力上表现突出。

其定价策略较为复杂,采用基于输入token长度的分级价格,超过特定阈值后费用会显著增长,这反映了其对超长上下文处理资源需求的精细化计费。Gemini中包括多款不同规模及能力的模型,满足从轻量级任务到高负载运算的全方位需求。谷歌的这种分层定价机制,促使开发者在设计应用时更加重视上下文管理和输入文本精炼。 Anthropic的Claude系列重点强调安全性和企业适用性,形成了覆盖高性能(Opus)、均衡性能(Sonnet)和低延迟响应(Haiku)的等级结构。价格体系符合其对不同企业需求的细分,尤其是顶级版本Opus定价偏高,聚焦复杂推理和大量上下文场景。同时,Anthropic通过多渠道分发策略,包括直接API、Amazon Bedrock和Google Cloud Vertex AI,拓宽了市场覆盖范围。

Cohere则以企业级检索增强生成(RAG)应用为核心,旗下Command系列在价格上体现出高度的性价比,尤其是针对长上下文和工具调用优化的Command R系列,在中低价位段优势明显。其对关键Rerank任务的统一单价计费为用户带来更可预测的运营成本。 Mistral AI因为其强大的开源背景和激进的价格调整策略,成为成本战的重要参与者。2024年9月的价格大幅下调使其多款产品在经济型和中端市场极具竞争力。Mistral Large系列虽保持高性能定价,但相比竞争对手存在明显价格优势。其产品线覆盖从高度成本敏感的边缘模型到大规模多模态模型,满足不同客户的多样需求。

Mistral的开放策略也为开发者提供了灵活的自主托管选项,降低了长期运营支出。 综合对比来看,2025年LLM API市场呈现出明显的价格层次划分。经济型模型以Mistral Ministral 3B、Cohere Command R7B及谷歌Gemini 1.5 Flash-8B为代表,适合高频调用且对复杂度要求较低的场景。中端市场竞争尤为激烈,OpenAI的GPT-4o mini、谷歌Gemini 2.0 Flash和Mistral Small均提供了具备良好性能和成本平衡的解决方案。顶端高性能模型如Anthropic Claude 3 Opus与OpenAI的o1系列则针对高复杂度与深度推理应用,其价格明显高出许多。 输出token显著高于输入token的价格差异成为全行业定价共识。

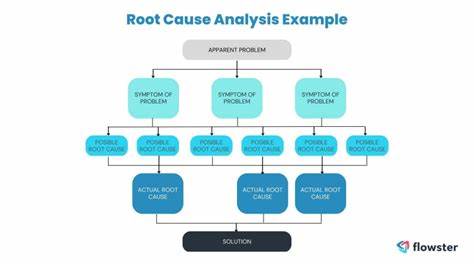

这种模式不仅合理反映了生成计算资源的增量消耗,也鼓励开发者通过优化提示设计和输出内容提升效率。高级用例中融合多步推理和检索增强生成成为节省成本的重要手段。 各厂商的差异化定价策略还体现了其市场定位和技术优势。OpenAI和Anthropic侧重智能推理和安全保障,愿意在高端订价保持品牌溢价。谷歌则通过复杂的分层定价适应多模态超长上下文,引导开发者付费即用。Cohere专注商业检索生态,强调成本可控和操作简便。

Mistral则以开放与价格优势迅速抢占市场份额。 对于企业和开发者而言,合理评估LLM API的成本不仅仅是计算单价,还需结合模型性能、响应延迟、上下文容量、特定功能支持以及平台稳定性等多维因素。定期关注官方最新公告,密切跟踪价格调整动态势在必行。同时,设计阶段优化token利用率和响应长度,将直接提升应用的经济效益。 2025年的LLM API市场正在向成熟和多样化演进。竞争不仅体现在模型技术的先进性,更加注重用户友好性、定价透明度与生态整合。

随着开放源码、高性能计算和应用场景的不断拓展,未来的价格战将更加激烈,服务质量和性价比评估也将成为客户选择的关键。 开发者应该结合自身业务需求和预算规模,综合比较各供应商的服务特性和成本结构,灵活选择最优组合。多模型并行调用、多阶段推理以及混合云部署等实践,将有效降低总体支出,实现智能应用的最大化回报。期待未来市场带来更多创新的定价模式和技术突破,推动大型语言模型成为数字时代不可或缺的智能引擎。