近年来,人工智能技术的发展带来了科研写作领域的重大变革。特别是以ChatGPT为代表的智能聊天机器人问世后,其在生物医学研究论文中的应用日益普及。研究发现,聊天机器人在帮助撰写论文摘要方面的使用频率呈显著上升趋势,甚至部分论文的摘要内容可能主要依赖于人工智能生成。这一现象引发了学术界对人工智能写作辅助工具使用合理性与影响的广泛关注。 据最新发表于Science Advances期刊的研究报告显示,来自德国图宾根大学的德米特里·科巴克(Dmitry Kobak)及其团队利用大数据分析手段,考察了2010年至2024年间超过1500万篇生物医学论文摘要中的词汇使用变化。研究重点在于探测自2022年11月ChatGPT发布以来,文本中某些特定词汇的使用频率是否出现异常波动。

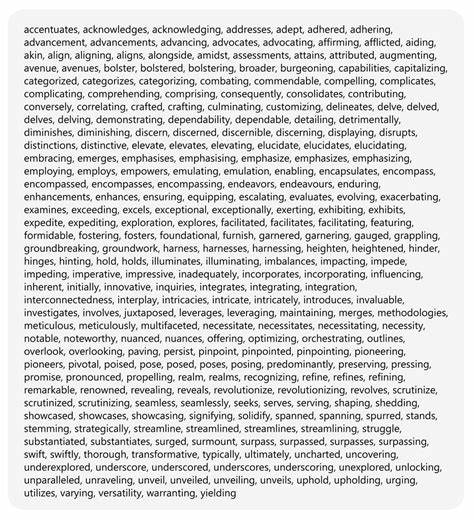

调查数据表明,自聊天机器人引入以来,一组诸如“delves”,“crucial”,“potential”,“significant”和“important”等词汇的出现频率显著增高。这些词汇在此前并未大量集中使用,突显出人工智能生成文本的典型语言特征。基于454个被标记为“聊天机器人倾向使用”的词汇,研究人员推断至少有13.5%的生物医学论文摘要可能部分或完全由人工智能辅助撰写。 不仅如此,分析还发现这一现象在某些国家的研究者群体中表现更为明显,尤其是那些投稿至选择性较低期刊的作者中,AI生成论文摘要的比例甚至高达40%。这一趋势在一定程度上反映了学术写作领域对智能辅助工具的接受度和使用依赖度逐渐提升。 这场研究揭示了人工智能技术对学术写作传统规范带来的挑战。

尽管借助聊天机器人可以提高写作效率,减少语言表达难题,但过度依赖AI生成内容可能影响论文的原创性和表达深度,甚至造成信息失真或误导。学界正面临如何制定合理使用规范、确保学术质量与透明度的双重考验。 从学术诚信角度来看,利用聊天机器人辅助写作应当明确披露,以维护科研的透明和公正。与此同时,针对AI生成内容的检测技术也亟需完善,帮助编辑和评审识别潜在的人工智能生成文本,保障论文质量不被影响。 人工智能的进步不仅为研究者减轻了写作负担,也为学术传播带来新的可能。通过智能辅助,科研人员能够更专注于创新思想的表达与数据分析,加速知识创造和成果发布。

然而,如何在享受技术红利的同时,避免学术伦理风险,实现人工智能与科研人员的良性互动,是未来科研共同体必须面对的核心议题。 此外,聊天机器人在生物医学领域的应用不仅局限于写作辅助,还涵盖文献综述、数据解释、实验设计建议等多个环节,有望为科研工作带来全面的支持和优化。随着人工智能算法的不断成熟,其在提升科研效率和质量方面的作用将更加凸显。 然而,针对人工智能写稿的争议也在不断升温。部分科学家担忧AI生成文本可能造成立场倾向或信息偏差,威胁学术公平性。部分期刊已开始制定相关政策,对文章中AI辅助的表述进行规范,甚至限制未经声明的AI参与写作的论文发表。

综上所述,聊天机器人作为新兴的科研写作助理,其影响力正逐步加深,带来了机遇与挑战并存的局面。未来,制定合理的学术规范、提升AI检测手段、加强科研人员的伦理教育,将是推进人工智能与学术研究深度融合的关键路径。只有实现技术与伦理的平衡,才能充分发挥人工智能在生物医学科研领域的巨大潜力,为人类健康事业的发展贡献更大力量。