随着生成式人工智能(GenAI)技术的迅猛发展,如何高效构建具有丰富检索能力和生成能力相结合的应用成为行业热点。近期,Ragbits v1.0正式发布,配合新推出的create-ragbits-app工具,使开发者能够在几分钟内快速搭建基于检索增强生成(RAG, Retrieval-Augmented Generation)技术的应用,极大地简化了开发流程,提升了生产力。Ragbits作为生成式AI应用的模块化构建平台,集合了多种领先技术,支持多种模型的无缝切换、类型安全的调用、灵活的数据摄取及多代理协同,成为构建下一个世代智能应用不可或缺的利器。Ragbits的核心优势首先体现在其轻量且功能全面的组件设计上。用户可以根据项目需要选择安装全套包或部分组件,从核心的llm交互、嵌入向量处理、文档摄取与索引,到多代理系统和聊天界面模块,每一环节均支持高扩展性和卓越性能。搭配LiteLLM,支持百余款语言模型,甚至本地部署,满足多样化需求。

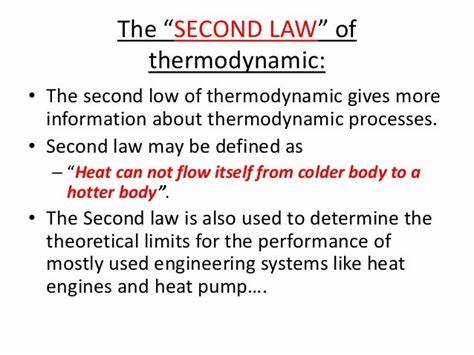

快速启动方面,create-ragbits-app大大降低了入门门槛。开发者无需繁琐配置,只需运行简单命令,便可生成符合自身场景的代码模板,从数据导入、索引构建、查询处理到问答交互,环环相扣。一旦代码部署,即可开始利用Ragbits构建的RAG应用,依托强大向量搜索和生成模型,返回精准且上下文丰富的回答。在数据摄取能力方面,Ragbits支持二十多种文档格式,包括PDF、HTML、电子表格和演示文稿等。其内置的文档解析引擎结合视觉语言模型(VLM),能够准确提取文本、表格及图片等复杂结构信息。此外,还支持主流云存储系统如S3、GCS和Azure,进一步打通数据来源,确保知识库高效更新和实时同步。

Ragbits还引入了基于Ray框架的并行处理架构,有效应对海量数据摄取任务,大幅提升索引构建速度,满足企业级大规模应用的需求。检索与生成的无缝集成是Ragbits的另一大亮点。通过内置的向量数据库支持,如PgVector、Qdrant等,可以让应用实现快速而精准的相似度搜索。一旦检索出相关上下文信息,生成模型即可基于上下文产生准确、自然的回答,有效避免模型“胡言乱语”问题,增强可信度和用户体验。更为先进的是其支持多代理工作流,开发者可以设定不同角色的智能体,各司其职地完成文档检索、信息聚合、答案生成等任务,并通过其A2A协议高效调度和协作,进一步提升复杂应用场景中的响应质量和智能水平。对于开发者来说,Ragbits不仅工具链丰富,还集成了全面的观测和性能监控功能。

通过OpenTelemetry支持,实时跟踪应用运行指标,一旦发现性能瓶颈或异常可以快速定位。配合promptfoo等提示工程测试工具,可以提前验证prompt质量,保证上线后的高效和稳定。同时系统具备自我优化能力,可基于反馈不断调整模型参数和调用策略,保障持续优化用户体验。值得关注的是,Ragbits在聊天UI支持上也表现出色。内置的聊天接口,不仅支持多轮对话状态管理,还能动态调度检索与生成工具,生成具备实时上下文感知的对话内容。开发者可在短时间内构建带有持久会话、用户反馈收集及接口扩展能力的智能客服或知识问答机器人,广泛适用于企业服务、教学辅助等领域。

总结来看,Ragbits v1.0和create-ragbits-app的发布,为生成式人工智能应用的开发带来了革命性变革。它不仅极大地降低了技术门槛和开发周期,更通过丰富模块和优异性能保障了应用质量与扩展能力。无论是初学者还是经验丰富的开发者,都能借助Ragbits快速构建高度定制且智能化的RAG应用,推动AI技术在更多行业和场景中的深度落地。随着开源社区的不断壮大和功能的持续迭代,Ragbits有望成为生成式AI领域的重要基础设施。对于追求高效开发和卓越用户体验的团队而言,掌握并应用Ragbits无疑是迎接智能化未来的关键一步。