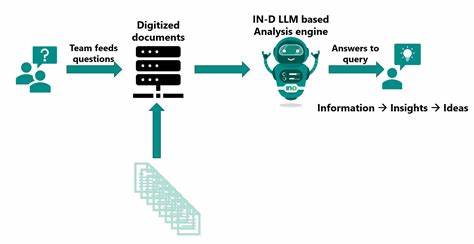

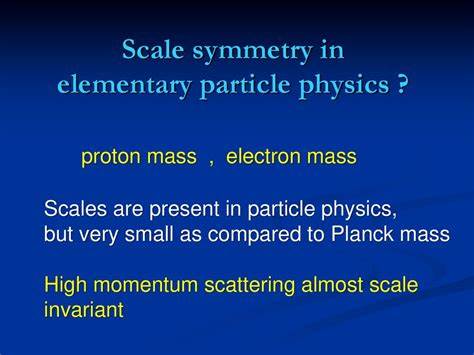

随着人工智能技术的迅猛发展,尤其是大型语言模型(LLM)的广泛应用,围绕其训练过程中的版权问题、产品责任以及盗版现象引发了社会各界的高度关注。合理使用原则在这一背景下被重新审视,成为AI训练数据合法获取和使用的关键法律依据。此外,产品保护与LLM责任的界定也成为新兴的法律热点,影响着AI产业的健康发展。本文将深入解读训练人工智能为何构成合理使用,探讨产品保护如何兼顾技术创新与用户权益,分析盗版对AI生态的威胁,并展望未来可能的政策与法律走向。首先,训练AI所涉及的版权问题历来是行业争议的焦点。大型语言模型的训练通常需要海量数据,包括文本、图像及声音资料。

这些数据大多受版权法保护,未经授权的使用可能引发侵权诉讼。然而,近年来司法实践出现了重要转折,首个涉及AI训练的大规模版权案件裁决支持了合理使用的范畴,判定将受版权保护内容作为训练数据输入,并不构成侵权。合理使用原则允许在不损害原作者正常权益和合理获利的前提下,适度利用作品用于研究、评论、教育等目的。AI训练因其转化性质,创造出非直接复制的全新表达形式,符合合理使用的核心精神。法律界和产业界普遍认为,这一判决为AI技术发展提供了宝贵的法律保障与明确指引,为后续相关争议树立了重要判例基础。其次,关于产品保护与大型语言模型责任的讨论日益激烈。

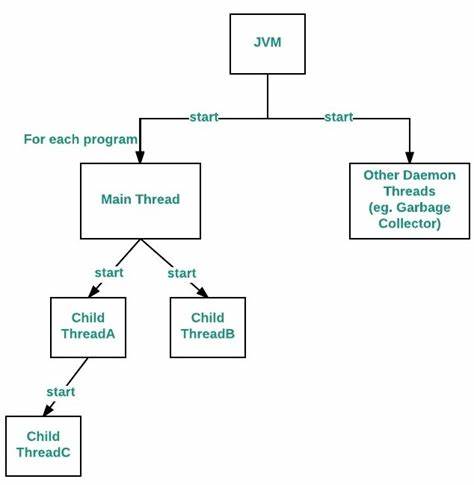

AI产品本身是一种复杂的软件系统,用户依赖其提供信息服务、辅助决策甚至创造内容。然而,AI的预测和生成结果并非绝对准确,存在偏差和错误的风险。如何界定制造商、开发者及运营者的法律责任成为焦点。企业通常通过产品保护机制保护自身技术投资,同时应承担合理的安全义务和用户保护责任。平衡创新鼓励与风险防范需要法律体系给予适度的灵活性,建立详细的责任划分原则,明确产品缺陷责任与因使用不当导致损害的区别。相关政策推动企业实施透明机制,加强AI模型的可解释性和可控性,促进技术发展与社会信任的同步提升。

再次,盗版作为阻碍AI产业健康发展的顽疾,也呈现出新的形态与挑战。大量未经授权的内容被非法复制、传播,不仅侵犯著作权人的合法权益,也使得AI训练数据的来源复杂且难以追溯。盗版内容混入训练集可能影响模型质量,甚至引发伦理和法律风险。反盗版工作亟需多方协作,包括版权方、技术平台和监管机构。人工智能自身也可成为反盗版工具,通过内容识别和追踪技术提升版权保护效率。同时,推动行业建立规范的数据供应链,确保训练数据合法合规,维护版权环境的公平正义。

展望未来,随着AI技术日益渗透各行各业,法律法规也需与时俱进,完善对合理使用边界的界定,明确AI产品责任框架,强化对盗版行为的监管机制。立法者可以借鉴当前司法实践,制定专门针对AI的版权使用准则和安全标准。在国际层面,加强跨境合作和版权协调,推动形成统一且前瞻性的政策环境,是保障全球AI创新可持续发展的关键。公众对此也应有理性认识,理解合理使用的正当性,支持技术进步与版权保护的平衡推动。总体来看,训练人工智能的合理使用不仅是法律问题,更是技术进步与社会价值观的综合体现。产品保护与大型语言模型责任的科学划分,盗版治理的持续加强,为AI产业的良性发展提供了坚实基础。

通过多方协同、创新治理,将促进AI在未来释放更大的潜力,造福全人类。