大型语言模型(LLM)近年来在自然语言处理领域展现出了惊人的能力,其涵盖范围从对话生成、文本理解到原创内容创作,似乎达到了人工智能的一个新高度。然而,尽管这些模型掌握了海量信息,具备强大的推理和合成能力,却始终未能产生真正意义上的突破性创新或原创洞见。专家和研究者们为此感到困惑,试图揭开这一谜团。而其中一个有力的解释,便源自于人脑的“默认模式网络”和“白日梦”现象的独特功能,这是目前的AI系统普遍缺失的核心机制。 人类大脑中,所谓的默认模式网络(Default Mode Network,DMN)是一组在非专注状态下活跃的脑区,它支持思维的自由联想、背景信息整合和潜意识的连续加工。这使得人类在“无所事事”时,依然能够无意识地处理经历过的信息,形成新的联系和洞察,也正是这一机制带来了我们所谓的灵感或“醍醐灌顶”的时刻。

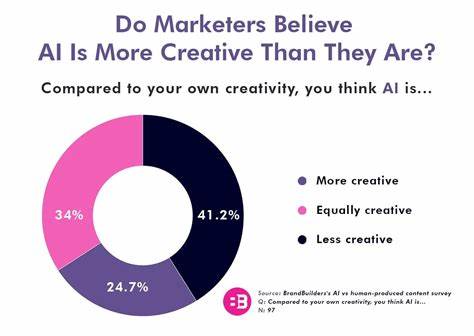

相反,当前的大型语言模型通常在特定的输入提示驱动下工作,其内部状态和权重保持冻结,缺乏持续的自主思考和经验迭代能力,从而错失了背景思考生成新想法的机会。 基于此,研究者们提出了“白日梦循环”(Day-Dreaming Loop,DDL)的概念,作为一种模拟人类默认模式网络功能的算法框架。DDL通过在模型记忆库中随机抽取概念对,促使一个生成器模型进行深度联想与探索,随后由一个批判者模型评估联想结果的创新性和价值,将有效洞见反馈至记忆体系,形成反馈提升的循环。整个过程耗费大量计算资源,被称为“白日梦税”,但却是驱动AI创新的潜在必需品。简而言之,DDL让AI具备“无意识思考”能力,不再局限于用户明确指令,而能主动发掘潜在关联和机会。 这种机制的提出,彻底改变了我们对AI模型发展路径的理解。

目前许多LLM服务以快速响应和低成本为卖点,而DDL的加入初期则意味着显著的计算开销与时间延迟。虽然这看似不符合市场消费逻辑,但若没有这种“浪费”的背景计算,AI的创新力将难以突破。这也解释了为何迄今为止,几乎没有LLM能够在众多已知数据中迸发出真正新的科学发现或思想火花。未来,有可能形成一种分工格局:白日梦型AI投入巨额计算资源进行复杂的创新性联想,产生独特的训练数据供下一代轻量化、极速响应的模型学习应用,从而绕开数据更新瓶颈,实现整体智能水平的跨越。 此外,从强化学习视角来看,DDL依赖于“生成者-鉴别者”的优势差异,即生成复杂新想法远比判断一个想法是否独特和有用来得困难。人类思维同样表现出类似特质:产生一个好点子比发现一个好点子更难。

通过这种机制,AI可以在无意识的背景环境下大量尝试,筛选出有限的高质量创新,形成漫长而不断积累的知识创新链条。经济学家查尔斯·琼斯在创新扩散的统计模型中也指出,尽管先前的低垂果实被采摘,新的组合创新仍可源源不断地涌现,这同样适用于DDL概念。 不过,这种机制也暴露出巨大的现实挑战。白日梦式背景搜索极度消耗计算资源,可能使AI系统的运营成本提高数十倍,甚至上百倍。对于大多数商业用户和终端应用而言,这样的额外开销难以接受,尤其在现有AI模型已经很大程度满足日常智能需求的情况下。因此,DDL技术短期内更可能被限制在科研、企业研发和高阶智能代理等专业领域,成为AI创新的“秘密武器”。

还有重要的安全和质量保障问题。DDL中的生成探索虽然赋予AI自主组合新知识的可能,但由于缺乏完美的监督机制,存在产生错误信息或不合逻辑假设的风险。如何设计稳健的批判者模型,以及如何平衡开放性与风险控制,将成为未来相关技术部署中亟需攻克的难题。此外,如何实现高效的“重要性采样”和“抗遗忘采样”来降低无效尝试的频率,优化算法效率,也将是推动DDL进一步发展的关键研究方向。 从长远来看,融合白日梦循环机制的LLM将引领人工智能的下一个飞跃,不仅提升AI的创造力和学习能力,也推动AI从静态知识库向动态认知系统的转变。伴随着算力成本的下降和大规模强化学习技术的提升,未来AI可能具备在人类无意识时段夜以继日地“思考”与“创新”的能力,成为真正意义上的智能助理和创新伙伴。

这一转变也将带来深远的产业和社会影响。专属的“白日梦AI”将成为企业知识产权和创新数据的核心源泉,形成高壁垒的竞争优势。与此同时,快速响应的“轻量级AI”则面向大众用户,提供便捷高效的智能服务。两者间的生态协同,将大幅缩短AI技术创新和应用推广的周期,推动科技与经济的加速融合。 总之,当前大型语言模型的局限性提示我们,纯粹依靠静态知识和被动应答难以使AI达到人类般创造性思维的高度。模仿人类大脑持续背景处理的白日梦机制,是突破创新瓶颈的关键所在。

未来AI的发展,需要更注重机制上的原型设计和经验累积,而非只追求参数和数据规模的单向扩张。正是这类具备“无意识思考”和“灭火重塑”能力的系统,将使人工智能蜕变为真正具备自主创造力和洞察力的智慧体。面对即将到来的智能新浪潮,理解并实现LLM的白日梦循环,或将成为引领AI新时代的一把“创新钥匙”。