量子计算作为下一代计算技术的核心之一,正快速推动科学和技术的边界向前延伸。尤其是在中性原子量子比特阵列的发展上,突破性的进展不断涌现,为实现大规模、稳定、可控的量子系统奠定了坚实基础。近日,来自哈佛大学、麻省理工学院等顶尖研究机构的科学家联合发布了一项具有里程碑意义的成果:成功实现了一个超过3000个量子比特的相干系统,并实现持续、稳定的操作。这一突破不仅代表了量子计算技术的巨大飞跃,也为量子模拟、量子通讯及量子传感等多个领域注入了新的活力。中性原子的量子比特技术因其优越的可扩展性和控制精度而备受关注。通过在光镊与光学晶格中精准操纵单个原子,科学家能够高效构造出庞大、高密度的量子计算平台。

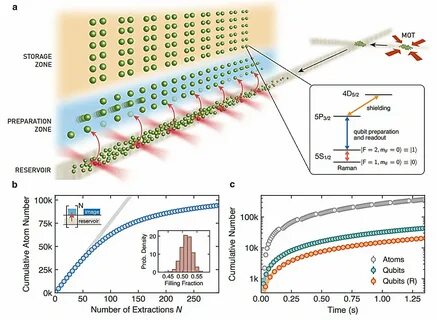

然而,传统系统中原子的损失与重新加载问题,一直是制约量子计算持续运转的瓶颈。原子丢失不仅降低计算的准确度,还限制了可执行的量子线路深度,难以满足实际复杂问题的需求。面对这一挑战,团队创新设计了包含两个光学晶格输送带的双层输送架构。该架构能将激光冷却的原子团通过精确控制,快速且连续地运送到科学实验区域,形成一个高密度的原子储备池。通过交叉声光调制器控制的二维光镊阵列,科学家能够"暗中"捕获储备池中的原子,不依赖激光冷却过程,避免对相邻存储量子比特的干扰,实现原子的高速提取与装载。实验中,系统以每秒30万个原子的超高速度注入光镊,并在制备区实现快速冷却、成像、缺陷修复和量子态初始化。

完成后,原子群被运送到拥有上千个静态光镊的存储区,通过动态去耦技术保护其量子相干性。值得一提的是,该系统利用角度和屏蔽技术,有效隔离了激光冷却区与存储区之间的光学散射和磁场干扰,保证了存储量子比特的长期相干性不受外界操作的破坏。搭建完毕的存储区可轻松容纳超过3200个原子,实际填充率达到99%以上,且能持续运行两个多小时,远远超过了传统系统中单个光镊的几十秒寿命限制。系统通过周期性移除最早存放的原子子阵列,并用新鲜制备好的原子替代,实现了理论上的无限时长量子比特维护。存储量子比特的相干时间达到了秒级,足以支持深度量子电路的执行。团队还设计了针对存储区的"屏蔽光"技术,通过光学方式显著降低近共振散射,避免制备区激光冷却与成像过程对存储区量子态造成的非理想解耦和退相干。

此外,通过连续应用高级的动态去耦序列,稳定了量子叠加态,进一步保障了系统的量子信息完整性。在实际应用层面,这项成果对量子计算的未来开启了多条可能路径。目前,量子错误纠正协议的实施及长时间稳定运行是迈向实用量子计算的关键,而该持续操作系统正是满足这一需求的基石。超过15000个量子比特每秒的更换速度也足够支撑千级乃至万级物理量子比特的实时补充,为实现数百个甚至更多逻辑量子比特铺平道路。在量子计时和量子传感领域,该系统的持续工作能力减少了死区时间与钟稳定性受限的迪克噪声,为打造高精度、低噪声原子钟及传感器提供了可能。此外,在量子网络中,这种高效原子流不断输送的方案能够实现高速纠缠生成与分发,推动全球量子信息网络构建。

文章还讨论了今后可通过技术优化进一步提升系统性能的方向。包括利用更快捷的实时成像与数据处理技术缩短量子比特制备时间,扩大制备区阵列规模,提高整个系统的量子比特注入速率,同时引入高功率激光和元表面光学元件以提升光镊的效率和阵列规模。此外,主动稳定机制和自动化校准技术的引入,将保障长时间运作的精确性和稳定性。整体而言,此次突破不仅仅是量子硬件能力的跃升,更代表了量子信息科学架构设计理念的重大进步。通过巧妙的空间分区设计与动态系统维护,成功实现了原子量子比特的连续、高速且相干稳定操作。随着相关技术日臻成熟,未来大规模、容错的量子计算机问世指日可待。

它将彻底变革人工智能、材料科学、密码学等领域,推动人类社会迈向智能化新时代。量子科学工作者和技术开发者应积极关注该领域最新成果,结合自身研究,推动更多创新应用落地。持续运行的三千量子比特相干系统无疑是量子计算发展历程上的光辉里程碑,也是探索更复杂量子现象和应用的坚实基石。 。