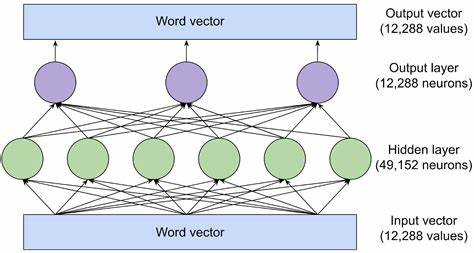

随着机器学习不断渗透到科学计算和工程模拟领域,确保模型满足先验硬约束成为提升预测准确性和物理一致性的关键之一。传统神经网络在处理动力学系统时,往往仅通过软约束如损失函数惩罚,试图逼近约束条件,导致模拟过程中的误差积累,最终出现违背物理规律的漂移甚至发散。神经微分代数方程(Neural Differential-Algebraic Equations,简称Neural DAEs)作为一种融合微分方程与代数约束的数学框架,开创性地为机器学习提供了一种强制满足硬约束的机制,极大拓宽了科学机器学习的应用边界。 微分代数方程本质上是同时包含微分方程和代数约束条件的数学形式,它们广泛存在于物理、化学以及工程系统中。通过将神经网络嵌入这一框架,Neural DAEs能够直接在模型结构中纳入任意代数约束,实现约束的逐时刻精确满足。比如经典的弹簧-质点系统中,能量守恒条件能够被设计为代数约束方程,不再依赖于训练中的惩罚项逼近,从根本上防止了能量漂移问题,使得模型的长期预测更加稳健可靠。

实现Neural DAEs的核心挑战之一在于如何高效且准确地求解和训练这类混合方程系统。相比普通神经微分方程(Neural ODEs),Neural DAEs必须处理代数约束的非显式关系,这使得数值求解变得更为复杂。当前主流的求解策略包括直接隐式解法、质量矩阵法、奇异摄动和降维等多种途径。直接隐式方法通过求解f(u', u, p, t)=0的隐式系统,适用通用但计算较慢,同时对初值和求解器稳定性要求较高。质量矩阵方法则将系统整理为Mx'=h(x, p, t)的形式,效率较高且适合指数器处理刚性问题。 除了这些传统方法,最近的研究引入了流形投影法,这种技术在每一步显式积分后,通过非线性最小二乘优化将数值解映射回满足约束条件的流形上。

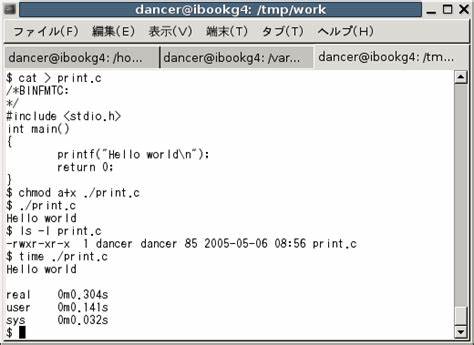

该方法兼具显式求解速度快和约束精度高的优点,实现了约束误差接近数值极限浮点精度,成为当前Neural DAE的先进解决方案之一。此外,连续流形松弛技术将投影过程转化为连续动态,进一步优化计算性能和稳定性。 对Neural DAEs的训练则依赖自动微分和伴随灵敏度法,利用Julia等支持自动微分的数值计算平台,可以对复杂约束系统进行端到端的梯度计算。特别是在质量矩阵与流形投影框架下,现有软件体系已支持反向传播梯度计算,使得在保持硬约束的同时高效地完成参数优化成为可能。 在模型构建层面,约束方程的索引(Differential Index)和降阶转换问题需要引起特别关注。简单的DAE模型很难直接适用求解器,必须通过符号自动化处理降低索引,转换成标准可求解的指数结构。

Julia的ModelingToolkit.jl正是这一领域的标杆工具,它提供全自动的符号解析、索引降低和代码生成支持,极大简化了神经网络与DAE系统的无缝集成。 深度挖掘Neural DAEs的潜力,意味着可以在多种复杂应用中保证模型物理一致性与泛化能力。例如在生物医学动态模型中,细胞总量守恒、电路模拟中的基尔霍夫定律、图像处理中像素强度守恒等场景都可自然嵌入硬约束,防止传统方法中软约束导致的误差积累,提升模型的可靠性与真实感。此外,神经DAE方法兼具灵活性和解释性,有利于科学发现过程中的知识融合与验证。 尽管Neural DAEs展现强大的理论与应用价值,该领域仍存在诸多挑战等待突破。首先,针对高维复杂动力学的符号降维与高效索引自动处理有待进一步完善,以适应更复杂工业和自然系统。

其次,求解器稳定性、计算成本与训练效率仍需平衡创新,尤其是面对大规模稀疏系统和非平滑约束。再者,如何设计更普适的网络结构,使得神经网络本身具备天然符合物理法则的性质,是未来神经DAE架构探索的重点方向。 展望未来,结合现代科研的多尺度、多物理场模拟和机器学习技术,神经微分代数方程为硬约束机器学习开辟了一条明确且高效的路径。通过持续推动符号自动化、求解算法与深度学习技术的融合,科研人员和工程师能够打造更具预测力、鲁棒性及解释性的智能模型。随着计算资源的提升和开源软件生态的发展,Neural DAEs有望成为科学机器学习领域新的主流工具,驱动工程设计、生命科学、环境模拟等领域的变革。对于立志于跨学科创新的研究者而言,投身于神经DAE的理论研究与应用开发不仅技术挑战与机遇共存,更有望参与塑造未来智能建模的根基。

。